- Gilbert Hyatt concibió y patentó una microcomputadora en un solo chip antes de la aparición comercial del Intel 4004, aunque su patente acabó siendo anulada tras décadas de disputas.

- En paralelo a Hyatt surgieron proyectos clave como el CADC del F-14, el AL1 de Four-Phase y los chips de Pico/General Instrument, que ampliaron el concepto de microprocesador más allá de la versión oficial centrada en Intel.

- El Intel 4004 y sus sucesores (8008, 8080, 8086, 8088…) se beneficiaron del ecosistema de Silicon Valley y del empuje del IBM PC, consolidando la arquitectura x86 como estándar de los ordenadores personales.

- La evolución de la arquitectura de microprocesadores, desde CISC a RISC y diseños híbridos, ha permitido extender su uso desde calculadoras y ordenadores hasta todo tipo de dispositivos electrónicos y sistemas embebidos.

La historia del microprocesador es mucho más enrevesada de lo que suele contarse en los libros de texto. Detrás del famoso Intel 4004 y de los grandes nombres de Silicon Valley hay patentes discutidas, proyectos secretos militares, prototipos olvidados y una dura batalla legal encabezada por Gilbert Hyatt, un ingeniero que durante décadas defendió haber sido el verdadero pionero del microprocesador en un solo chip.

Si nos quedamos únicamente con la versión oficial, parece que todo empezó con Intel en 1971, pero al tirar un poco del hilo aparecen otros candidatos al “primer microprocesador”: el CADC para el caza F-14, el AL1 de Four-Phase Systems, los desarrollos de Texas Instruments, el trabajo conjunto de Pico y General Instrument, además de la propia visión de Hyatt sobre una microcomputadora completa en un chip. Vamos a ordenar todas estas piezas para entender cómo se construyó este invento clave de la informática moderna.

Gilbert Hyatt y la microcomputadora en un solo chip

Mucho antes de que Intel o Texas Instruments anunciaran procesadores comerciales, Gilbert Hyatt tenía en mente una computadora completa integrada en un único chip. Su idea no consistía en crear una tecnología exótica desde cero, sino en aprovechar los componentes y procesos de fabricación que ya existían en el mercado y combinarlos con una arquitectura novedosa que permitiera empaquetar todo en un solo circuito integrado.

Hyatt planteó un sistema sin gran memoria principal externa, usando una pequeña memoria de solo lectura programable una única vez, que almacenaría instrucciones básicas para controlar distintos tipos de tareas. Gracias a esta aproximación, su microcomputadora era de propósito general y no requería modificar el hardware para ejecutar programas distintos: bastaba con cambiar el contenido de esa ROM y usar una memoria no permanente para los datos variables de cada cálculo.

El corazón de su propuesta exigía un procesador de unas 2000 puertas lógicas o transistores, capaz de trabajar con datos de 16 bits. Todo el conjunto —CPU, memorias y lógica de soporte— debía caber en un chip compacto, algo extremadamente ambicioso para la tecnología de finales de los años sesenta. El diseño de Hyatt contemplaba una circuitería muy compleja, con un layout lleno de detalles finos y miles de interconexiones cuidadosamente calculadas.

Uno de los grandes obstáculos era el número de conexiones físicas necesarias. Un chip tan completo requeriría muchos pines para intercambiar datos con el exterior, pero Hyatt ideó una arquitectura en la que la información se transmitía en serie por un número reducido de pines mediante técnicas de tiempo compartido. Esta solución, adelantada a su época, permitía reducir costes de encapsulado y facilitaba la fabricación en masa.

Además de la visión técnica, Hyatt tenía clara la vertiente de negocio: su objetivo era que el chip pudiera producirse en serie a bajo coste y convertirse en la base de toda una nueva generación de sistemas de control y pequeñas computadoras. En julio de 1968 registró el término “microcomputadora” y en noviembre ya tenía una placa de pruebas cableada a mano, que depuró pacientemente con un osciloscopio, revisando circuito a circuito.

De la idea al negocio: Micro Computer Inc. y la batalla por la patente

Cuando Hyatt demostró su prototipo, llamó la atención de inversores locales. El consultor de gestión John Salzer quedó tan impresionado que invirtió 5.000 dólares en la empresa que Hyatt quería fundar. Salzer, a su vez, contactó con Richard Petritz, exresponsable tecnológico de Texas Instruments, que había creado la firma de capital riesgo New Business Resources. Petritz vio potencial en el proyecto, aunque finalmente no llegó a cerrar una inversión.

Hyatt y sus apoyos financieros pensaban que la nueva microcomputadora podría venderse por entre 1.000 y 2.000 dólares, abriendo la puerta a numerosas aplicaciones industriales y comerciales. En 1969, el abogado Stuart Lubitz se ocupó de buscar más capital y de registrar la sociedad Micro Computer Inc., que sería el vehículo empresarial para explotar la tecnología de Hyatt.

Al proyecto se sumó Irving Hirsch, un gerente con experiencia en pequeñas compañías tecnológicas, que invirtió 60.000 dólares de capital inicial y asumió la presidencia de Micro Computer. Con la empresa instalada en Reseda, Hirsch empezó a contratar personal y a organizar el desarrollo. Según él mismo contaría después, Hyatt era un trabajador incansable y un ingeniero brillantísimo, capaz de pasar noches enteras perfeccionando el diseño y discutiendo detalles técnicos hasta altas horas de la madrugada.

La estrategia inicial de Hirsch y Hyatt era utilizar la tecnología de chip para construir pequeñas computadoras de control industrial, de manera muy similar a lo que hoy hacen los microcontroladores en máquinas y procesos automatizados. A partir de ahí, preveían expandirse a otros mercados, incluyendo sistemas comerciales para pequeñas empresas, con un plan de desarrollo bastante ambicioso.

Pronto se dieron cuenta de que la empresa necesitaría alrededor de 1,5 millones de dólares de financiación, así que pidieron a Lubitz que localizara nuevos inversores. Entre los potenciales socios se encontraban nada menos que Robert Noyce y Gordon Moore, fundadores de Intel, a quienes Hyatt veía como candidatos para fabricar físicamente los chips de su microcomputadora.

En la ronda de financiación también apareció Hale Bros. Associates Inc., que se comprometió a invertir 500.000 dólares a cambio del 20% de la compañía. La junta directiva de Micro Computer quedó formada por Lubitz, Hirsch, el propio Hyatt, Joseph Chulick Jr. de Hambrecht & Quist y un representante de Hale, además de otros participantes vinculados al capital riesgo.

Con este respaldo, la empresa se trasladó a unas oficinas en Van Nuys en 1970 y llegó a contratar unos 25 empleados. En ese contexto, Hyatt presentó la famosa solicitud de patente el 28 de diciembre de 1970, describiendo una arquitectura de “microcontrolador” que, según él, precedía a los diseños que luego popularizarían Intel y Texas Instruments.

Sin embargo, las relaciones internas se torcieron. A través de Lubitz, los inversores intentaron que Hyatt renunciara a sus derechos sobre la tecnología si la empresa era vendida o cerraba. El 17 de julio de 1971 se produjo un enfrentamiento directo en una reunión de la junta: tanto Lubitz como Chulick presionaron a Hyatt para que cediera el control de su invento. Ante su negativa, los inversores cortaron la financiación, dejando el proyecto al borde del abismo.

Para Hyatt, había claros intereses en quitarle la propiedad intelectual de su diseño. No deja de ser llamativo que, años más tarde, Lubitz acabara trabajando como abogado de patentes para Intel, una coincidencia que alimenta la versión de Hyatt de que su idea fue “filtrada” a la industria por medio de los mismos inversores que primero la apoyaron.

La compañía terminó por cerrar en septiembre de 1971 y, según Hyatt, los inversores divulgaron detalles clave del chip a otras empresas del sector. Mientras su sueño empresarial se desmoronaba, Intel y Texas Instruments lanzaban al mercado el Intel 4004 y el TMS0100, los productos que pasarían a la historia como los primeros microprocesadores comerciales.

El resultado fue radicalmente desigual: Intel y TI se transformaron con el tiempo en gigantes multimillonarios de la electrónica, mientras que Hyatt apenas llegó a fabricar una microcomputadora para un único cliente. El propio Hyatt reconocería que fue muy duro ver cómo otros explotaban tecnologías que él consideraba derivadas de su trabajo, haciéndose ricos mientras él quedaba fuera del juego.

Ante la falta de financiación, Hyatt se recicló como consultor en el sector aeroespacial y continuó inventando por su cuenta, acumulando más de cincuenta patentes a lo largo de su vida profesional. Nunca perdió de vista la patente del microprocesador: sabía que no necesitaba haber fabricado el chip para que se la concedieran, sino demostrar de forma razonable que el dispositivo era viable técnicamente a partir de su diseño.

Con la ayuda de su abogado Gregory L. Roth, Hyatt inició una larguísima batalla legal, sacando partido a la prioridad de su fecha de presentación, anterior a la de sus rivales. Tras múltiples recursos y revisiones —se habla de hasta 16 fases legales—, la oficina de patentes demoró más de 20 años en otorgarle el reconocimiento. Hyatt insistía en que el examen de la patente había sido tan exhaustivo precisamente por lo delicado del asunto y por las enormes implicaciones económicas.

Su patente, que describía un “microcontrolador” que anticipaba arquitecturas posteriores, acabaría siendo finalmente invalidada después de haber generado cuantiosos pagos de regalías, pero el debate sobre quién fue realmente el primero en concebir el microprocesador en un solo chip sigue abierto en círculos históricos y técnicos.

Proyectos paralelos: CADC, AL1, Pico/GI y el entorno previo al 4004

Mientras Hyatt luchaba por sacar adelante su empresa, otros equipos de ingeniería trabajaban en soluciones muy cercanas al concepto de microprocesador. De hecho, tres proyectos distintos entregaron procesadores integrados casi al mismo tiempo: el CADC de Garrett AiResearch, el TMS1000 de Texas Instruments y el 4004 de Intel, todos ellos en la franja de 1971, además del chip AL1 de Four-Phase Systems, que ya operaba en 1969.

El CADC (Central Air Data Computer) fue desarrollado por Garrett AiResearch para equipar el caza F-14 Tomcat de la Marina estadounidense. En 1968, la empresa recibió el encargo de diseñar un ordenador digital que compitiese con los sistemas electromecánicos destinados al control de vuelo del nuevo avión. Los ingenieros Ray Holt y Steve Geller concibieron un chipset MOS que actuaba como CPU central, mucho más pequeño y fiable que las soluciones mecánicas que pretendía sustituir.

El diseño del CADC quedó listo hacia 1970 y se basaba en un conjunto de chips MP944 que formaban un multiprocesador paralelo de 20 bits con arquitectura en pipeline. Aunque no se trataba de un microprocesador de un solo chip, integraba CPU, RAM, ROM y otros dos circuitos de soporte de manera muy similar al enfoque de Intel para el 4004, utilizando también tecnología MOS de canal P y cumpliendo especificaciones militares muy exigentes.

Este sistema voló realmente en los primeros modelos del F-14 y, según diversos estudios publicados décadas después, podría considerarse el primer procesador digital que cumple los criterios modernos de microprocesador, aun sin ser monolítico. El problema es que la Marina de los EE. UU. mantuvo el diseño en secreto hasta finales de los noventa, de modo que la industria y la literatura técnica de la época apenas pudieron reconocer su importancia.

Ray Holt se graduó en 1968 en la California Polytechnic State University y comenzó su carrera precisamente con el CADC. Sus memorias, recogidas en el libro “The Accidental Engineer”, detallan un proyecto que solo se hizo público en 1998, cuando la Marina autorizó la liberación de la documentación. Desde entonces, varios autores han discutido si el MP944 debería figurar por derecho propio en el podio de los primeros microprocesadores, subrayando que su diseño supuso un avance notable respecto a lo que Intel publicaría dos años después.

En paralelo, la empresa Four-Phase Systems desarrolló en 1969 el chip AL1, un recorte de bits de 8 bits con ocho registros y una unidad aritmético-lógica (ALU), diseñado por Lee Boysel. En su momento formaba parte de una CPU más amplia de 24 bits construida con nueve chips, de los cuales tres eran AL1. Años más tarde, durante litigios legales en los noventa, se montó un sistema demostrativo en el que un único AL1, junto con RAM, ROM y un dispositivo de entrada/salida, se presentó como un ordenador funcional basado en un solo microprocesador, reforzando la candidatura del AL1 como antecesor directo de los procesadores comerciales.

Por otra parte, en 1971 la pequeña Pico Electronics y General Instrument (GI) anunciaron un circuito integrado completo de un solo chip para la calculadora Monroe/Litton Royal Digital III. Este IC de calculadora podía considerarse uno de los primeros microprocesadores o microcontroladores de un solo chip, dado que integraba ROM, RAM y un conjunto de instrucciones tipo RISC en el propio circuito. El diseño PMOS, de cuatro capas, se trazó a mano sobre film de mylar a escala 500:1, una hazaña notable para la complejidad que presentaba aquel chip.

Pico era un spin-out de cinco ingenieros de GI con amplia experiencia en conjuntos de chips de calculadora para GI y Marconi-Elliott. De hecho, Elliott Automation había encargado previamente a algunos de ellos una computadora de 8 bits en tecnología MOS, creando incluso un laboratorio MOS en Glenrothes, Escocia, en 1967. El auge de las calculadoras electrónicas, que se convirtieron en el mayor mercado de semiconductores de la época, permitió a Pico y GI tener un éxito considerable.

General Instrument siguió innovando con microprocesadores y microcontroladores, entre ellos el CP1600, el IOB1680 y el PIC1650. En 1987, el negocio de microelectrónica de GI se escindió y terminaría dando lugar a la conocida familia de microcontroladores PIC de Microchip, muy influyente en el mercado de sistemas embebidos.

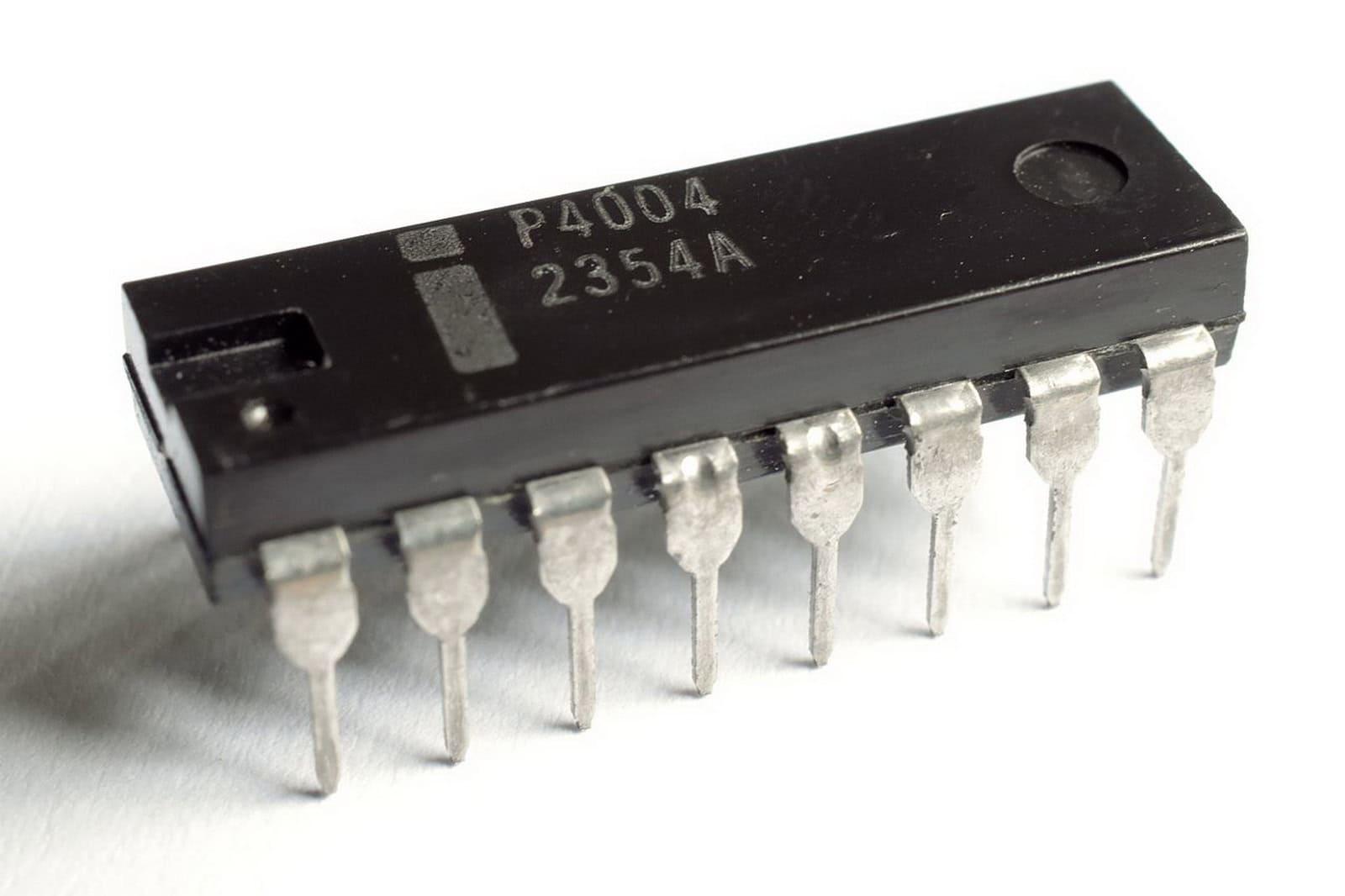

En ese caldo de cultivo se gestó también el archiconocido Intel 4004, generalmente reconocido como el primer microprocesador disponible comercialmente. Intel lo anunció en noviembre de 1971 a un precio de unos 60 dólares de la época y lo presentó como parte de la familia MCS-4. El equipo de diseño incluía a Federico Faggin, Marcian (Ted) Hoff, Stanley Mazor y Masatoshi Shima, combinando talento europeo, estadounidense y japonés.

El proyecto nació en 1969 cuando Busicom, un fabricante japonés de calculadoras, pidió a Intel un conjunto de chips para calculadoras de sobremesa de alto rendimiento. El diseño original de Busicom contemplaba siete chips, de los cuales tres formaban una CPU de propósito especial que almacenaba el programa en ROM y usaba registros de desplazamiento como memoria de trabajo. Hoff, encargado de evaluar la propuesta, pensó que se podía simplificar recurriendo a RAM dinámica y a una arquitectura de CPU de propósito general.

De esas ideas surgió una propuesta de cuatro chips: ROM para programa, RAM para datos, un circuito de E/S y una CPU de 4 bits. Aunque Hoff no era diseñador de circuitos integrados y solo podía plantear la arquitectura, estaba convencido de que la CPU podía integrarse en un solo chip. En 1970, Intel fichó a Federico Faggin para liderar el proyecto y convertir esa arquitectura en un producto real.

Faggin traía bajo el brazo la tecnología de puerta de silicio (SGT), que había desarrollado en 1968 en Fairchild Semiconductor y que ya había aplicado en el circuito 3708, el primer integrado comercial con SGT. Gracias a esa tecnología y a nuevas metodologías de diseño para lógica aleatoria, fue posible implementar la CPU de un solo chip con la velocidad, consumo y coste adecuados. Shima, por su parte, desarrolló el firmware de las calculadoras Busicom y apoyó a Faggin durante los primeros meses de implementación.

Aunque Leslie L. Vadász dirigía el departamento de diseño MOS de Intel, su foco principal estaba en el negocio de memorias, de modo que delegó la responsabilidad práctica del MCS-4 en Faggin. Las primeras unidades del 4004 se entregaron a Busicom en marzo de 1971 y empezaron a enviarse a otros clientes a finales de ese mismo año, marcando el inicio de la era comercial del microprocesador.

Silicon Valley, el contexto perfecto para el nacimiento del microprocesador

Todo este hervidero de proyectos no se produjo en el vacío. La gestación del microprocesador estuvo ligada al auge de la industria de semiconductores en Silicon Valley, un entorno en el que la investigación universitaria, el capital riesgo y el espíritu emprendedor se mezclaron de forma explosiva desde finales de los años cuarenta.

La Universidad de Stanford, buscando nuevas vías de financiación, impulsó la creación del Parque Industrial de Stanford alquilando terrenos de la propia institución a empresas tecnológicas emergentes. En ese ecosistema se formaron figuras como William R. Hewlett y David Packard, que empezaron con un humilde taller de electrónica en un garaje alentados por el profesor Terman. Aquel experimento acabaría convirtiéndose en Hewlett-Packard, que pasaría de unos pocos empleados a decenas de miles en unas pocas décadas.

El crecimiento de la zona no se debió solo a la genialidad de estos “chicos del garaje”, sino también a un ambiente industrial y tecnológico excepcional, con inversores dispuestos a arriesgar, universidades activas y un flujo constante de talento. En 1971, el periodista Don Hoefler popularizó el término “Silicon Valley” en su boletín Microelectronics News, reflejando la importancia del silicio como materia prima de la revolución electrónica.

En ese mismo entorno nació en 1957 Fairchild Semiconductor, la primera compañía dedicada exclusivamente al silicio, donde en 1959 se desarrolló uno de los primeros circuitos integrados prácticos. De Fairchild saldrían, directa o indirectamente, casi todas las grandes empresas de semiconductores de la región, incluida Intel. Muchos de sus fundadores provenían del laboratorio de William Shockley, codescubridor del transistor y pieza clave de la electrónica moderna.

A comienzos de los años setenta, Silicon Valley estaba plagado de firmas que producían chips de memoria, lógica y componentes para ordenadores, la mayoría también radicados en la zona. Ese ecosistema fue el caldo de cultivo ideal para que surgiera el microprocesador, al combinar tecnología de vanguardia, necesidades reales de mercado y acceso a capital dispuesto a financiar proyectos arriesgados como los de Hyatt, Intel o Texas Instruments.

De los primeros procesadores al auge de los ordenadores personales

Aunque el 4004 suele considerarse el punto de partida, lo cierto es que en pocos años se produjo una explosión de nuevos modelos de microprocesadores. En 1972, Intel lanzó el 8008, con bus de datos de 8 bits, 66 instrucciones y capacidad de direccionar hasta 16 KB de memoria, mejorando de forma notable las prestaciones del 4004.

En 1974 llegó el Intel 8080, considerado a menudo el primer microprocesador de propósito general. Su repertorio de 111 instrucciones y su espacio de direccionamiento de 64 KB permitieron imaginar usos mucho más ambiciosos que las calculadoras, desde pequeños sistemas de desarrollo hasta ordenadores personales primitivos. En paralelo, Motorola presentó el M6800, otro chip de 8 bits muy influyente que alimentaría, por ejemplo, al célebre ordenador Altair 8800.

La revista Popular Electronics publicó una sección sobre el Altair, una computadora basada en el 8080 que MITS vendía en forma de kit por menos de 400 dólares. A pesar de que arrancó sin teclado, monitor, memoria permanente ni software de serie, llegó a recibir alrededor de 4.000 pedidos en los tres primeros meses, demostrando que existía una comunidad de aficionados dispuesta a montar y programar sus propios sistemas personales.

Estos primeros ordenadores con microprocesador cambiaron radicalmente el panorama. Hasta entonces, los equipos de computación eran mainframes y minicomputadoras grandes y carísimas, reservadas para gobiernos y grandes empresas, donde los usuarios interactuaban mediante tarjetas perforadas y jamás tocaban directamente la máquina. Los microprocesadores permitieron diseñar ordenadores de sobremesa, inicialmente vendidos como kits, que cabían en un despacho y podían ser manejados por una sola persona.

A mediados de los setenta, revistas como Radio-Electronics y Popular Electronics describían con detalle cómo construir ordenadores caseros basados en chips como el 8008 o el 8080. Estos kits, dirigidos sobre todo a aficionados, fueron el germen de la industria del ordenador personal, allanando el camino a máquinas más acabadas como el Apple II, el TRS-80 o el Commodore PET 2001, que aparecerían alrededor de 1977.

A finales de los setenta y principios de los ochenta, microprocesadores como el MOS 6502 y el Zilog Z80 se convirtieron en auténticas estrellas. El Apple II y los primeros modelos de Commodore montaban el 6502, mientras que sistemas como el TRS-80, el Commodore PET 2001, el ZX Spectrum o los Amstrad CPC aprovechaban el Z80. Se vendieron millones de unidades de estos ordenadores, acercando por primera vez la informática al usuario doméstico.

En 1978, Intel presentó el 8086, con bus de datos interno de 16 bits y capacidad de direccionar hasta 1 MB, dando origen a la famosa arquitectura x86. Le sucedieron otros procesadores importantes como el Z8000 de Zilog, el NS16000 de National Semiconductor, el TI9900 de Texas Instruments o el 68000 de Motorola, que equiparía los primeros Apple Macintosh. La rivalidad entre estas familias marcó la evolución de los ordenadores personales y de las estaciones de trabajo durante los años ochenta.

Qué es y cómo funciona un microprocesador

En esencia, un microprocesador es un chip capaz de leer un programa y ejecutar las instrucciones que contiene, comunicándose al mismo tiempo con el mundo exterior mediante líneas de entrada y salida. A pesar de su aparente complejidad, sus bloques internos básicos son relativamente sencillos de entender.

En el interior encontramos la unidad aritmético-lógica (ALU), encargada de realizar las operaciones matemáticas y lógicas; la unidad de control, que interpreta cada instrucción y coordina el resto de bloques; y un conjunto de registros internos donde se guardan de forma temporal datos, direcciones y estados intermedios de la ejecución.

Todo el funcionamiento del microprocesador se sincroniza mediante un reloj, un circuito que genera pulsos a una frecuencia determinada. Por cada pulso, o por cada cierto número de pulsos, la CPU avanza una parte del ciclo de ejecución de una instrucción. Las frecuencias de reloj pasaron de unos pocos megahercios en los primeros diseños a varios gigahercios en los modelos actuales, lo que se traduce en un número enorme de operaciones por segundo.

Las distintas partes internas del procesador se comunican a través de buses internos, que son grupos de líneas por las que circulan varios bits simultáneamente. Cuantos más bits tenga el bus, mayor cantidad de información puede transferirse en cada ciclo. De forma análoga, el microprocesador se relaciona con el resto del sistema —memoria, periféricos, pantalla, etc.— a través de un bus externo, cuyo ancho en bits condiciona la velocidad global del equipo.

Todos estos bloques se construyen a partir de un componente elemental: el transistor. Un microprocesador moderno puede integrar millones o incluso miles de millones de transistores en una sola pastilla de silicio. La forma en que se organizan estos transistores, las unidades funcionales que se definen y la manera en que se conectan entre sí forman lo que se conoce como la arquitectura del microprocesador.

La arquitectura es clave para el rendimiento: no solo importa el número de transistores, sino cómo se reparten en bloques funcionales, qué tipo de instrucciones se soportan, cuántas operaciones pueden ejecutarse en paralelo, cómo se manejan las interrupciones o qué jerarquía de cachés se emplea. Desde los primeros diseños, los fabricantes han perseguido siempre que un mismo trabajo se complete en menos tiempo, ya sea aumentando la frecuencia de reloj, ampliando el ancho de los buses o introduciendo mejoras en la unidad de control y en la paralelización interna.

En los inicios predominaban arquitecturas denominadas CISC (Complex Instruction Set Computer), con juegos de instrucciones muy amplios y potentes, pensados para facilitar la vida a los programadores. Sin embargo, a mediados de los años setenta estudios estadísticos revelaron que muchas de esas instrucciones apenas se utilizaban. Esto llevó al concepto de RISC (Reduced Instruction Set Computer), en el que se reduce drásticamente el número de instrucciones, pero se optimiza su ejecución para que, en general, se completen en un solo ciclo de reloj.

A partir de ahí se fueron desarrollando múltiples arquitecturas con distintos equilibrios entre complejidad de instrucciones y velocidad de ejecución. Diseños como Banias (que dio lugar a los Intel Core 2) o, más recientemente, la arquitectura Zen de AMD, han marcado hitos importantes en la competencia por el liderazgo en rendimiento, demostrando que la organización interna es tan decisiva como el mero aumento de la frecuencia de reloj.

El papel de Intel y otros fabricantes en la evolución del microprocesador

A lo largo de las décadas, Intel ha tenido un papel protagonista en la historia del microprocesador, desde el 4004 hasta las familias x86 modernas. La trayectoria de los ordenadores personales está íntimamente ligada a la evolución de sus chips, especialmente a partir del momento en que IBM decidió entrar en el mercado del PC.

IBM, fundada en 1911, dominaba el sector de los grandes ordenadores, pero a finales de los setenta vio una oportunidad clara en el ámbito doméstico y de pequeñas empresas. Para acelerar el proyecto, optó por utilizar componentes estándar de otros fabricantes en lugar de desarrollar cada parte por su cuenta, como había hecho tradicionalmente. Gracias a esta decisión, el primer IBM PC se completó en alrededor de un año.

En agosto de 1981, IBM lanzó su IBM PC con microprocesador Intel 8088, un chip con bus interno de 16 bits pero bus externo de 8 bits, lo que permitía emplear componentes de 8 bits más baratos y abundantes. Se cuenta que Bill Gates, fundador de Microsoft, convenció a IBM para que el PC fuese una máquina de 16 bits, lo que impulsó el uso de este procesador y consolidó la arquitectura x86 como estándar de facto.

IBM apostó por una arquitectura relativamente abierta, permitiendo que otros fabricantes desarrollaran periféricos y software compatibles sin necesidad de pagar costosas licencias. De ahí surgieron los famosos “clónicos” del PC, equipos de numerosos fabricantes que seguían el mismo estándar y que, en todos los casos, necesitaban un microprocesador compatible con x86, donde Intel era el proveedor de referencia.

El éxito fue tan grande que la evolución de los PC acabó girando en torno a las nuevas generaciones de procesadores Intel. Los modelos 286, 386 y 486 marcaron hitos sucesivos en potencia y capacidades, y durante un tiempo Intel otorgó licencias a otros fabricantes para que pudieran producir chips compatibles, con el objetivo de asegurar el suministro ante una demanda disparada.

Empresas como AMD comenzaron fabricando procesadores bajo licencia de Intel, pero con el tiempo desarrollaron diseños propios compatibles con x86, hasta convertirse en competidores de primer nivel. Cuando Intel percibió que estos socios empezaban a ganar demasiado peso, dejó de conceder licencias en sus líneas más modernas, a partir de la familia Pentium, reforzando aún más el carácter estratégico de su propiedad intelectual.

Aunque el gran público suele fijarse en los microprocesadores para ordenadores personales, estos solo representan una pequeña parte del volumen total de chips. Hoy prácticamente cualquier dispositivo electrónico —desde una lavadora hasta un coche moderno— integra uno o varios microcontroladores o microprocesadores adaptados a tareas concretas. Fabricantes como MediaTek, Qualcomm, Samsung, Huawei o Apple han desarrollado soluciones altamente especializadas para móviles y tabletas, mientras que otros como Freescale, Nvidia o Texas Instruments destacan en segmentos como la automoción, la industria o el procesamiento de señales.

Visto con perspectiva, el microprocesador ha recorrido un camino vertiginoso desde los primeros diseños de Hyatt, el MP944 del F-14, el AL1 de Four-Phase, los chips de calculadora de Pico/GI o el Intel 4004, hasta los complejos sistemas actuales que combinan núcleos de propósito general, unidades gráficas, aceleradores de IA y grandes cantidades de memoria integrada. Detrás de esa evolución hay una combinación de ideas visionarias, como la microcomputadora monolítica de Gilbert Hyatt, y de desarrollos industriales que transformaron aquellas intuiciones en productos masivos. Esa mezcla de innovación individual, competencia feroz y ecosistema tecnológico es la que ha hecho posible que hoy vivamos rodeados de procesadores invisibles pero fundamentales en casi todos los aspectos de nuestra vida cotidiana.