- Las CXL Add-in Card (AIC) son tarjetas PCIe basadas en el estándar CXL que aportan memoria adicional coherente sin ocupar ranuras DIMM.

- Se apoyan en CXL 2.0/3.0 y protocolos como CXL.mem y CXL.cache para habilitar memory pooling, baja latencia y acceso compartido entre CPU y aceleradores.

- Ejemplos como las tarjetas de Innodisk (hasta 256 GB) y SMART CXA-8F2W (hasta 1 TB) muestran cómo escalar memoria para IA, 5G, edge y trading.

- Estas soluciones reducen la complejidad y el coste de rediseñar placas base, mejorando el aprovechamiento global de memoria en centros de datos y sistemas edge.

Si te mueves en el mundo de los servidores, centros de datos o estaciones de trabajo potentes, seguro que últimamente te suena una sigla por todas partes: CXL y, más en concreto, CXL Add-in Card (AIC). No es una moda pasajera, sino una de las claves para afrontar el problema que tienen hoy día casi todos los sistemas de alto rendimiento: la memoria se queda corta muy rápido y las placas base no escalan tan fácil como quisiéramos.

En este contexto aparecen las tarjetas CXL AIC, unas tarjetas de expansión que se pinchan en ranuras PCIe y que permiten sumar memoria al sistema sin tocar los zócalos DIMM. Además, gracias al estándar Compute Express Link, esa memoria extra no es un simple “almacén lejano”, sino que se integra con coherencia de memoria y puede compartirse entre varios hosts y aceleradores como GPUs o FPGAs. Vamos a ver con calma qué es CXL, qué pinta tiene una CXL Add-in Card y para qué escenarios merece la pena.

Qué es CXL (Compute Express Link) y por qué importa

Compute Express Link, o CXL, es un estándar de interconexión pensado para resolver un problema de fondo: que cada componente de un sistema (CPU, GPU, aceleradores, dispositivos de red, etc.) suele tener su propia memoria, con diferentes latencias y capacidades, y coordinar todo eso de forma eficiente es un dolor.

En los PC tradicionales estamos acostumbrados a que la CPU tenga la RAM del sistema como memoria principal y, por otro lado, la GPU cuente con su propia VRAM. Es un esquema de tipo NUMA (Non-Uniform Memory Access): cada dispositivo tiene su “pozo” de memoria local, al que accede más rápido, y el resto de memorias externas resultan más lentas y complicadas de gestionar. Esto se vuelve crítico cuando entran en juego cargas de IA, análisis de datos masivos o virtualización intensiva, donde cualquier cuello de botella de memoria se paga muy caro.

CXL se define como una extensión de PCI Express que usa la misma interfaz física, pero añade un ingrediente clave: la coherencia de memoria entre dispositivos. Es decir, aunque cada uno tenga su memoria local, todos comparten una visión coherente del espacio de direcciones, de forma que los datos no se duplican ni se desactualizan en cada caché sin control.

Esta coherencia se apoya en un diseño donde CPU, GPU u otros aceleradores pueden localizar y actualizar datos en memoria de forma coordinada. Tradicionalmente esto se lograba dentro de un mismo chip (por ejemplo varios núcleos compartiendo una caché L3), pero CXL permite extender ese concepto más allá del propio SoC, hasta dispositivos conectados por PCIe.

Cuando hablamos de versiones, CXL 1.0 y 2.0 se apoyan en PCIe 5.0, mientras que CXL 3.0 se basa en PCIe 6.0. No hay soporte CXL oficial sobre generaciones anteriores de PCIe, así que hace falta hardware relativamente moderno tanto en la CPU/placa base como en los dispositivos conectados. Por eso, de momento, lo veremos sobre todo en servidores, estaciones de trabajo y centros de datos, y no en placas para PC doméstico, aunque todo apunta a que acabará bajando a gamas más “terrenales”.

Protocolos y tipos de dispositivos CXL

El estándar CXL se sustenta en tres protocolos básicos que todo dispositivo compatible debe implementar, al menos en parte:

- CXL.io: reutiliza la lógica de PCI Express para la comunicación básica de entrada/salida. Gracias a este protocolo, un enlace CXL puede comportarse como un enlace PCIe tradicional en cuanto a configuración, gestión y transferencia de datos de control.

- CXL.cache: permite que un dispositivo, como una GPU o un acelerador, use una caché coherente frente a la memoria de otro dispositivo (por ejemplo, la RAM de la CPU). Con esto, se reduce la necesidad de copiar datos explícitamente entre memorias, ya que los dispositivos pueden ver y cachear datos remotos de manera coordinada.

- CXL.memory (CXL.mem): habilita el acceso directo a memorias externas, de forma que un dispositivo pueda leer y escribir en una memoria que no es la suya local. Aquí entra en juego la expansión de memoria y el uso de pozos de memoria adicionales más allá del controlador integrado en la CPU.

Sobre estos protocolos se definen tres tipos principales de dispositivos CXL que ayudan a entender dónde encajan las CXL Add-in Cards:

- Dispositivos Tipo 1: no disponen de memoria propia. Se apoyan en la RAM del sistema a través de CXL.io y CXL.cache. Pueden ser, por ejemplo, tarjetas de red inteligentes u otros aceleradores ligeros que necesitan acceso coherente a la memoria principal.

- Dispositivos Tipo 2: integran cómputo y memoria local (como GPUs, FPGAs u otros aceleradores en tarjeta de expansión) y utilizan CXL para que tanto la CPU como el propio dispositivo puedan ver de forma coherente sus memorias respectivas.

- Dispositivos Tipo 3: son dispositivos de memoria pura, sin cómputo. Actúan como una especie de “módulos de RAM externos” conectados por CXL, que se pueden añadir para ampliar la capacidad total o para servir como memoria compartida entre varios hosts y aceleradores.

Las CXL Add-in Card (AIC) de las que hablamos aquí encajan precisamente en esta tercera categoría: dispositivos Tipo 3 orientados a expansión de memoria. Su función es ofrecer capacidad de memoria adicional, con baja latencia y coherente, utilizando una ranura PCIe en lugar de los zócalos DIMM estándar de la placa base.

CXL 2.0 y el concepto de memory pooling

Con la llegada de CXL 2.0 se introduce una función clave llamada memory pooling, que permite agrupar memorias de distintos dispositivos en un gran “pool” o conjunto lógico que después se reparte dinámicamente entre hosts y aceleradores.

En vez de que cada servidor o cada GPU viva aislado con su propia memoria fija, los sistemas CXL 2.0 pueden centralizar grandes bancos de RAM CXL Tipo 3 (como las CXL AIC o módulos en formato EDSFF) y asignarles trozos concretos a cada dispositivo según sus necesidades. Esto se hace para evitar conflictos y contención de acceso, pero a la vez aprovechar mucho mejor la capacidad total de memoria disponible.

Aquí entra en juego de nuevo CXL.cache, que actúa como una especie de caché de último nivel frente a estas memorias remotas. De este modo, una GPU, por ejemplo, puede trabajar con datos almacenados más allá de su propia VRAM local, cacheándolos con coherencia y reduciendo la penalización de latencia.

Piensa en el caso típico de entrenar una IA en una GPU donde la VRAM se queda corta: con CXL 2.0, el acelerador podría ir más allá de su memoria local y tirar de RAM del sistema o de memoria CXL Tipo 3 alojada en una tarjeta AIC, sin tener que rediseñar toda la placa base ni cambiar el servidor entero.

Esto resulta vital en entornos donde la memoria está físicamente limitada (por ejemplo, tarjetas gráficas con memoria soldada, CPUs integradas en SoC compactos o servidores edge muy pequeños). Con CXL, las restricciones físicas de zócalos y módulos empiezan a ser menos críticas, y se abre la puerta a arquitecturas mucho más flexibles.

Qué es una CXL Add-in Card (AIC) y cómo funciona

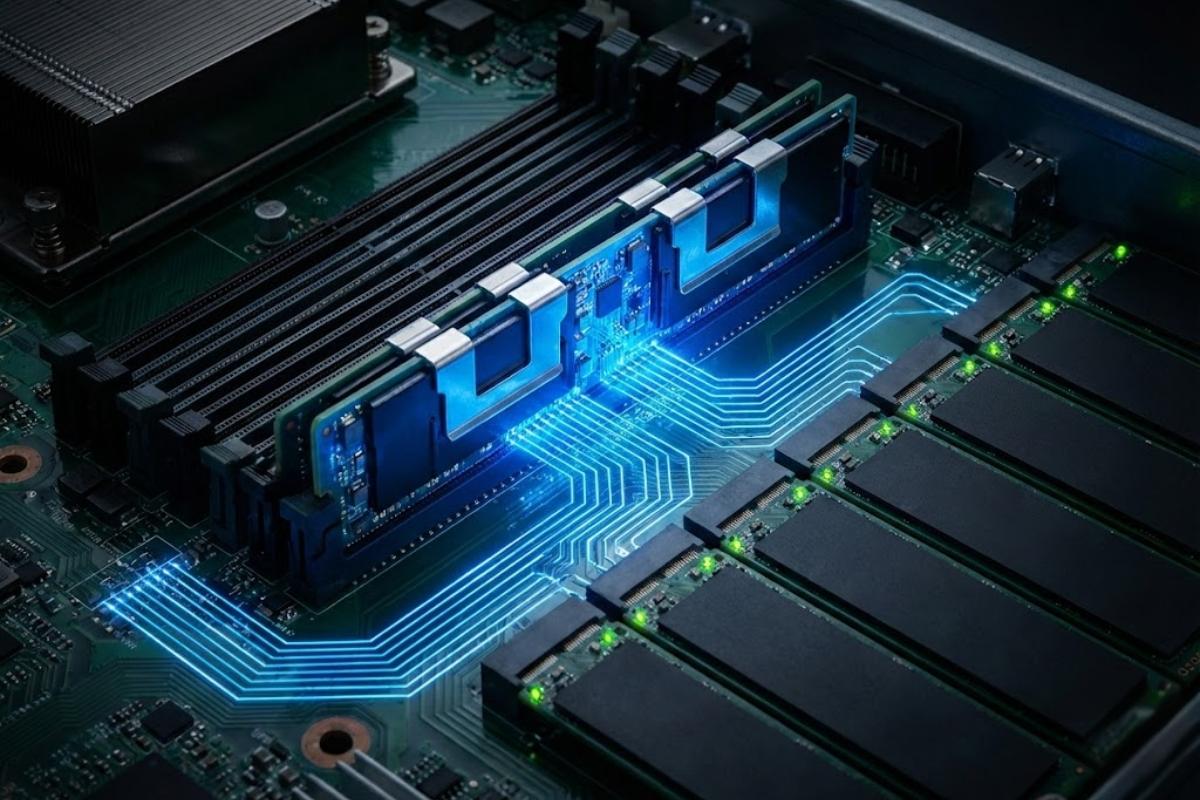

Una CXL Add-in Card (AIC) es, en esencia, una tarjeta de expansión que se inserta en una ranura PCI Express del sistema y que actúa como dispositivo CXL Tipo 3 de memoria. Desde fuera se parece a una tarjeta PCIe más, pero en lugar de montar una GPU o una controladora RAID, lo que lleva son zócalos RDIMM DDR5 con soporte ECC en DDR5 y controladores CXL especializados.

Su principal ventaja es que permiten aumentar la memoria del sistema sin “comerse” ranuras DIMM de la placa base. Esto es especialmente útil cuando la placa ya va llena de módulos o cuando el diseño simplemente no admite más zócalos. En lugar de rediseñar la placa o cambiar de plataforma, se recurre a una CXL AIC, se pincha en un slot PCIe Gen5 y listo, tenemos un nuevo banco de memoria accesible por CXL.

Al trabajar sobre PCIe Gen5 x8 o x16, estas tarjetas pueden ofrecer anchos de banda muy altos. Un ejemplo típico es una CXL AIC con interfaz PCIe Gen5 x8 capaz de proporcionar hasta 32 GB/s de ancho de banda adicional hacia esa memoria, más que suficiente para alimentar cargas de trabajo intensivas como inferencia de IA o análisis en tiempo real en el edge.

Además, estas tarjetas no solo amplían capacidad: gracias a CXL.mem y a la coherencia de memoria, la CPU y otros dispositivos pueden ver esa memoria como parte de un espacio común. Eso permite que la memoria CXL se utilice para compartir datos entre varios hosts, para buffers de alta capacidad o para extender de forma transparente la memoria visible por el sistema operativo, según cómo se configure.

Ejemplo real: Innodisk CXL Add-in Card para expansión de memoria PCIe

Un caso muy representativo es la tarjeta CXL Add-in Card presentada por Innodisk, proveedor de soluciones de memoria industrial. Esta AIC basada en CXL nace para responder al aumento de consumo de memoria en la computación de nueva generación y a las limitaciones de escalado de las placas base actuales.

La tarjeta de Innodisk se conecta mediante una interfaz PCIe Gen5 x8, lo que le permite ofrecer hasta 32 GB/s de ancho de banda dedicado a la memoria que aloja. Lo interesante es que, al hacerlo a través de la ranura PCIe, no ocupa ninguna de las ranuras DIMM nativas del sistema, que pueden seguir usándose para la RAM principal, mientras la CXL AIC actúa como memoria adicional especializada.

En cuanto a formato físico, Innodisk ha optado por un diseño HHHL (half-height, half-length) compacto, muy adecuado para servidores edge y micro centros de datos donde el espacio interno es oro. Además, se suministra con un soporte FHHL adicional para garantizar la compatibilidad con distintos chasis, desde servidores 1U a cajas más altas.

Sobre la tarjeta se montan dos zócalos RDIMM DDR5, que permiten instalar módulos de hasta 128 GB cada uno, para una capacidad total de hasta 256 GB (128 GB x2) de memoria CXL. Basta con cambiar los RDIMM para ajustar la capacidad a las necesidades del sistema, sin tocar la placa base ni el procesador.

Cuando esta CXL AIC trabaja como dispositivo CXL 2.0 Tipo 3 compatible con CXL.mem y CXL.io, no solo aporta capacidad extra; además reduce la latencia y la complejidad de la arquitectura, al facilitar la agrupación de memoria (memory pooling) entre varios hosts. De esta forma se mejora el aprovechamiento global de los recursos de memoria, algo especialmente valioso en entornos multi-nodo.

El enfoque de Innodisk está claramente pensado para cargas donde la latencia y el ancho de banda son críticos, como redes 5G, trading de alta frecuencia, edge AI e imagen médica inteligente. En todos estos casos, la capacidad de disponer de más memoria próxima al cómputo, sin rediseñar la placa base y manteniendo una latencia baja, marca la diferencia entre un sistema que rinde bien y uno que se queda corto.

Otro ejemplo: SMART CXA-8F2W, AIC CXL con hasta 1 TB de memoria

Otro fabricante que se ha lanzado de lleno a este terreno es SMART, con su AIC CXA-8F2W, una tarjeta CXL Tipo 3 de 8 DIMM pensada para ampliar al máximo la memoria disponible por núcleo de procesador.

Esta tarjeta se presenta como una CXL AIC de tipo 3 basada en PCIe Gen5, en formato de altura completa y longitud media, que integra hasta ocho RDIMM DDR5 montados sobre el propio PCB. Para gestionar semejante capacidad, la CXA-8F2W utiliza dos controladores CXL x16 que implementan dos puertos CXL x8, sumando un ancho de banda total de 64 GB/s.

Cada uno de los ocho zócalos RDIMM admite módulos de hasta 128 GB de capacidad, lo que permite alcanzar un impresionante máximo de 1 TB de memoria en una sola tarjeta. Esta memoria se presenta al sistema como memoria CXL Tipo 3, accesible vía CXL.mem, ideal para entornos donde se busca aumentar dramáticamente la memoria por núcleo de CPU sin multiplicar el número de placas base o servidores.

SMART ha puesto bastante énfasis en las características de confiabilidad, disponibilidad y capacidad de servicio (RAS) de la tarjeta. Los controladores CXL integran detección y corrección de errores, monitorización avanzada y diagnóstico de memoria RAM y funcionalidades de mantenimiento que resultan cruciales en aplicaciones críticas.

En el apartado de seguridad, la CXA-8F2W incorpora IDE (Integrity and Data Encryption) a nivel de enlace CXL, interfaz de memoria DDR cifrada con AES-256 y autenticación de firmware con comprobación de integridad. Esto asegura que tanto el tráfico en el enlace CXL como el acceso a la propia DRAM se realizan de forma protegida frente a ataques o corrupciones.

En cuanto a RAS, incluye corrección de errores de un solo bit y detección de errores dobles, EDC avanzado, duplicación de memoria, ahorro de rango, scrubbing, migración de memoria bajo demanda, así como monitorización térmica y limitación de la DRAM. También ofrece aislamiento de fallos, registro detallado de errores y capacidades de informe, con posibilidad de monitorización tanto en banda como por canal lateral (SMBus).

Aplicaciones prácticas de las CXL Add-in Card (AIC)

La combinación de CXL y tarjetas AIC de memoria abre un abanico de casos de uso muy interesante, sobre todo donde el crecimiento de la memoria no puede seguir el ritmo del crecimiento del cómputo. Algunos ejemplos representativos serían:

- Micro centros de datos y edge computing: en estas instalaciones suele haber muy poco espacio físico, pero se demandan cargas de IA, análisis de datos o servicios 5G con latencias muy bajas. Una CXL AIC HHHL permite incorporar memoria adicional sin ocupar demasiadas U en el rack y sin rehacer todo el diseño de la placa.

- Redes 5G: las funciones de red virtualizadas (vRAN, O-RAN) y el procesamiento cerca del usuario requieren buffers de memoria grandes y flexibles. Con CXL AIC se puede escalar la memoria en función de los despliegues, sin sobredimensionar de inicio todos los nodos.

- Trading de alta frecuencia: aquí cada microsegundo cuenta. Disponer de memoria muy rápida y próxima al cómputo para mantener libros de órdenes, modelos y datos de mercado en caliente es clave. La baja latencia de la memoria CXL accesible por PCIe Gen5 marca la diferencia.

- Imagen médica inteligente: aplicaciones como reconstrucción 3D, análisis de imágenes de resonancia o TAC con IA necesitan enormes volúmenes de datos en memoria. Las CXL AIC permiten ampliar la memoria disponible para estas cargas sin rediseñar las plataformas clínicas ya instaladas.

- IA y procesamiento de datos en el edge: inferencia de modelos grandes, analítica de vídeo en tiempo real o sistemas de recomendación cercanos al usuario se benefician de espacios de memoria escalables donde las GPUs o aceleradores pueden ir más allá de su VRAM local.

Ventajas frente a soluciones tradicionales de ampliación de memoria

Frente a la ampliación clásica basada en añadir más módulos DIMM a la placa base, las CXL Add-in Card aportan una serie de ventajas claras cuando el sistema ya va al límite o se quiere evitar un rediseño completo:

Por un lado, preservan las ranuras DIMM nativas del sistema. Puedes tener todas las ranuras de la placa base ocupadas con la máxima capacidad soportada y, aun así, seguir ampliando memoria mediante una o varias CXL AIC conectadas a los slots PCIe libres.

Por otro, estas tarjetas introducen ancho de banda adicional dedicado. En el caso de la Innodisk CXL AIC, el enlace PCIe Gen5 x8 aporta 32 GB/s extra, que se suman al ancho de banda ya disponible hacia la RAM principal. Esto ayuda a reducir la latencia efectiva cuando la CPU accede a memoria compartida y mejora el flujo de datos para aplicaciones con un consumo masivo de ancho de banda.

Además, al ser dispositivos CXL 2.0 Tipo 3, estas AIC encajan muy bien en arquitecturas de memory pooling multi-host. Un mismo pool de memoria CXL puede repartirse dinámicamente entre distintos servidores, lo que reduce la fragmentación y mejora la utilización global, algo que resulta complicado con memoria “pegada” físicamente a cada placa.

También son una opción más rentable y rápida de desplegar que rediseñar placas base a medida o cambiar de generación de servidor para ganar unos cuantos zócalos DIMM extra. Fabricantes como Innodisk ofrecen especificaciones RDIMM configurables, lo que permite ajustar capacidad, velocidad y características industriales sin tener que empezar de cero con el hardware.

En entornos industriales y edge, donde el rediseño implica certificaciones, validaciones de largo plazo y costes significativos, incorporar una CXL Add-in Card se convierte en una solución muy atractiva para crecer en memoria al ritmo que lo hagan las aplicaciones.

En conjunto, todo este ecosistema de CXL, dispositivos Tipo 3 y CXL Add-in Card apunta hacia una forma distinta de pensar la memoria: menos ligada físicamente a la placa base y más vista como un recurso compartido, escalable y coherente, accesible por CPU, GPU y otros aceleradores casi como si fuese una única gran RAM distribuida.

Con la madurez de PCIe Gen5 y la llegada de PCIe Gen6, el despliegue de CXL 2.0 y 3.0 y las propuestas de fabricantes como Innodisk o SMART, el escenario que se está dibujando es el de sistemas donde sumar cientos de gigabytes o incluso terabytes de memoria vía CXL AIC será algo tan normal como hoy lo es añadir una tarjeta gráfica, favoreciendo arquitecturas más flexibles, con mejor aprovechamiento de recursos y preparadas para las cargas de IA, 5G y análisis de datos que ya están marcando el futuro del cómputo de alto rendimiento.