- Las NPU priorizan la inferencia de IA en el edge con bajo consumo, mientras que las TPU se enfocan en cómputo tensorial masivo en la nube.

- CPU y GPU siguen siendo la base: orquestan el sistema y aceleran deep learning, pero los aceleradores (NPU, TPU, DSP, VPU) optimizan tareas concretas.

- Móviles, portátiles, NAS, coches y cámaras ya integran NPU, DSP y VPU para ejecutar IA localmente sin depender siempre de la nube.

- Elegir entre NPU, TPU, GPU o DSP depende del entorno: nube o edge, entrenamiento o inferencia, volumen de datos y restricciones de energía.

La explosión de la inteligencia artificial ha traído un montón de siglas nuevas al mundo del hardware: CPU, GPU, NPU, TPU, DSP, VPU… y la cosa puede hacerse bola muy rápido. Si te estás preguntando qué pintan todas estas piezas en tu PC, tu móvil o en la nube, y sobre todo qué diferencia hay entre NPU y TPU, aquí vas a salir de dudas con calma y sin tecnicismos innecesarios.

En las próximas líneas vamos a desgranar qué es cada tipo de procesador, para qué sirve y en qué escenarios brilla. Verás cómo se usan en servidores, en el edge, en NAS como los de QNAP, en portátiles con Windows, en móviles y hasta en coches autónomos. La idea es que, cuando termines, tengas claro qué elegir o qué exigir cuando te hablen de IA, aceleradores y rendimiento.

CPU, GPU, NPU y TPU: el mapa general de procesadores

Antes de meternos a fondo con NPU y TPU, conviene poner orden y recordar qué hace cada pieza: la CPU como cerebro generalista, la GPU como bestia del paralelismo, y los aceleradores de IA (NPU, TPU, DSP, VPU) como especialistas ultraoptimizados.

La CPU (Central Processing Unit) es la unidad de procesamiento central, el «cerebro» clásico de cualquier ordenador, servidor o NAS. Está formada por núcleos relativamente pocos pero muy potentes, capaces de ejecutar instrucciones de propósito general de forma secuencial o con paralelismo limitado, ideal para sistemas operativos, aplicaciones de oficina, servidores web, bases de datos y lógica compleja que no se puede dividir fácilmente en miles de trocitos independientes.

Dentro de una CPU encontramos componentes clave como la unidad de control (CU), que dirige el tráfico de instrucciones y datos, la unidad aritmético-lógica (ALU), que realiza las operaciones matemáticas y lógicas, y la memoria caché, que almacena de manera temporal los datos más usados para que todo vaya mucho más rápido. Esta combinación hace que la CPU sea extremadamente versátil, aunque no tan eficiente cuando hablamos de cálculos masivos en paralelo, típicos del deep learning.

La GPU (Graphics Processing Unit) nació para acelerar gráficos 3D, vídeos y animaciones, pero hoy es la reina del cómputo paralelo de propósito masivo. Una GPU moderna agrupa cientos o miles de pequeñas unidades de cálculo (ALU o núcleos), capaces de ejecutar la misma operación sobre muchos datos a la vez. Esto la hace perfecta para renderizar escenas 3D, editar vídeo, hacer streaming, minar criptomonedas y entrenar redes neuronales profundas.

A diferencia de la CPU, la GPU suele incorporar su propia memoria de alta velocidad (por ejemplo GDDR o HBM), con un ancho de banda brutal en comparación con la RAM del sistema. Gracias a ello puede mover grandes volúmenes de datos (imágenes, tensores, matrices) con mucha eficiencia, acelerando de forma notable tanto gráficos como cargas de trabajo de IA y análisis científico.

La NPU (Neural Processing Unit) es un tipo de procesador relativamente reciente, diseñado expresamente para acelerar redes neuronales y tareas de IA. En lugar de buscar versatilidad como una CPU o un equilibrio como una GPU, la NPU se centra en un conjunto de operaciones muy concreto (multiplicaciones de matrices, acumulaciones, convoluciones, inferencia en redes profundas) y en hacerlas de forma masiva, paralela y con muy poco consumo.

La TPU (Tensor Processing Unit), creada por Google, es también un acelerador especializado, pero con un foco clarísimo en cómputo de tensores a gran escala. Está pensada para entrenar y ejecutar modelos de machine learning de forma extremadamente rápida, sobre todo en la nube de Google Cloud. En muchas tareas de inferencia con redes neuronales, estudios de Google han mostrado que una TPU puede ofrecer entre 15 y 30 veces más rendimiento que CPUs y GPUs de la misma generación, aunque a cambio hablamos de hardware muy específico y caro, con oferta limitada.

Cómo se usan CPU, GPU, NPU y TPU en inteligencia artificial

En IA no hay una única pieza mágica; lo que hay es una combinación de procesadores, cada uno haciendo lo que mejor sabe. Según el tamaño de los datos, la fase del proyecto (entrenamiento o inferencia) y el entorno (nube, edge, móvil, NAS…), te interesará uno u otro.

En machine learning, la CPU sigue siendo la base del sistema. Ejecuta el sistema operativo, coordina dispositivos, lanza los procesos de entrenamiento y orquesta el uso de GPU, NPU o TPU. Para tareas de IA sencillas, conjuntos de datos pequeños o algoritmos difíciles de paralelizar (por ejemplo, algunas inferencias en tiempo real o modelos altamente secuenciales), una CPU potente puede bastar, aunque no sea la opción más eficiente en coste o energía.

Las GPU se utilizan masivamente para el deep learning porque las redes neuronales profundas están llenas de operaciones matriciales repetitivas, ideales para su arquitectura paralela. Entrenar modelos de visión artificial, reconocimiento de voz, LLM de tamaño medio o análisis masivo de datos es un terreno donde la GPU sigue siendo casi el estándar, sobre todo en entornos domésticos y de desarrollo, ya que es el acelerador más accesible.

Las TPU entran en juego cuando necesitas entrenar o ejecutar modelos enormes, especialmente dentro del ecosistema de Google. Son brutales para cálculos tensoriales: entrenar grandes LLM, sistemas de recomendación, motores de búsqueda o aplicaciones complejas de visión y voz sobre volúmenes gigantescos de datos. Su punto clave es que están diseñadas para soportar esas cargas a gran escala con muchísimo rendimiento por vatio.

Las NPU brillan sobre todo en la inferencia en tiempo real y en dispositivos con limitaciones de energía: móviles, tablets, portátiles, IoT, sistemas de videovigilancia, coches conectados, etc. Permiten ejecutar redes neuronales ya entrenadas directamente en el dispositivo, sin depender de la nube, manteniendo el consumo bajo y liberando a la CPU y la GPU de carga.

Arquitectura y funcionamiento de una NPU

La arquitectura de una NPU está pensada para parecerse, en cierto modo, a un cerebro: muchos pequeños elementos trabajando en paralelo sobre datos conectados entre sí. No es que replique el cerebro humano, pero sí copia la idea de procesamiento masivo distribuido y eficiente.

Una de las claves son las unidades de cómputo especializadas para MAC (Multiply-Accumulate): bloques hardware dedicados a realizar multiplicaciones y sumas de forma continua. Estas operaciones son la base del entrenamiento y la inferencia de redes neuronales: cada neurona calcula combinaciones ponderadas de sus entradas, y eso se traduce en miles o millones de operaciones MAC por segundo.

Otro pilar es la memoria en chip de alta velocidad. Las NPU integran SRAM o memorias rápidas cercanas a las unidades de cómputo para almacenar pesos y activaciones, reduciendo al máximo los accesos a la RAM externa, que son más lentos y gastan más energía. Esto minimiza los cuellos de botella y mantiene un flujo de datos continuo.

Además, el diseño interno es una arquitectura altamente paralela, capaz de ejecutar miles de operaciones simultáneas sobre lotes de datos (batches). Algunas NPU utilizan estructuras como matrices sistólicas, donde los datos fluyen por una malla de unidades de cálculo realizando operaciones en cadena, lo que permite un aprovechamiento extremo del paralelismo.

Para ahorrar aún más energía, muchas NPU trabajan con formatos de baja precisión (por ejemplo, 8 bits o menos) en vez de usar coma flotante de 32 bits. En IA suele ser suficiente para mantener la calidad de los resultados, y el ahorro de recursos es enorme. En algunos casos, las NPU pueden ser decenas o incluso más de 100 veces más rápidas que una GPU en tareas de inferencia, manteniendo un consumo similar.

NPU en el mundo real: móviles, portátiles, coches y NAS

La gracia de la NPU no está en la teoría, sino en las aplicaciones reales que ya usas sin darte cuenta. Desde desbloquear el móvil con la cara hasta las correcciones de cámara en videollamadas, la NPU está trabajando en segundo plano.

En smartphones de gama media y alta, fabricantes como Apple, Samsung, Huawei, Google o Qualcomm integran bloques de NPU (o equivalentes con otro nombre) en sus SoC. Se utilizan para funciones como reconocimiento facial, efectos de cámara mejorados, realidad aumentada, traducción en tiempo real, asistentes de voz o detección de objetos en fotos y vídeos.

Apple, por ejemplo, lleva su Apple Neural Engine (ANE) en los iPhone desde el A11 Bionic y en los Mac con chips Apple Silicon (M1, M2, M3…). Este motor neuronal proporciona varios TFLOPS de potencia dedicada a IA y se usa para Face ID, mejoras fotográficas, reconocimiento de texto en imágenes, dictado, realidad aumentada y prácticamente cualquier función de IA en el ecosistema Apple. Además, los desarrolladores pueden acceder a él a través de APIs específicas.

Google, por su parte, integra una TPU adaptada al entorno móvil en sus SoC Google Tensor para los Pixel. Aunque el nombre sea TPU, su función dentro del SoC es parecida a la de una NPU integrada: acelerar tareas de IA en el propio dispositivo (procesado de imágenes, voz, traducción, fotografía computacional…) sin depender siempre de la nube.

En PCs y portátiles, tanto Intel como AMD han empezado a incluir NPU en sus procesadores x86-64. Intel lo hace con sus chips Meteor Lake y posteriores, pensados para portátiles con Windows, mientras que AMD estrenó su solución Ryzen AI en la serie Ryzen 7040. Estas NPU se aprovechan para funciones como desenfoque de fondo en videollamadas, corrección de mirada, encuadre automático y, cada vez más, para ejecutar modelos de IA locales integrados en Windows (por ejemplo, funciones ligadas a Copilot o aplicaciones de terceros).

Además, aparecen competidores como Qualcomm con los Snapdragon X orientados a portátiles ARM para Windows, muy centrados en ofrecer NPU potentes que permitan mover asistentes de IA y modelos de lenguaje en el propio equipo, con gran autonomía.

Los NAS de QNAP son otro buen ejemplo del papel de la NPU en el edge. Algunos modelos incorporan procesadores con NPU integrada para acelerar el motor QNAP AI Core, que da vida a aplicaciones como QuMagie (álbum de fotos inteligente con reconocimiento de imágenes), Qsirch (búsqueda con OCR en imágenes), QVR Face Insight (reconocimiento facial) o QVR Human (conteo de personas en vídeo). Modelos como el TS-AI642, con NPU de 6 TOPS, pueden hacer reconocimiento facial en unas 0,2 segundos por imagen y mejorar el rendimiento de OCR de IA alrededor de un 20% frente a NAS similares sin NPU.

¿Qué es exactamente una TPU y cómo se diferencia de una NPU?

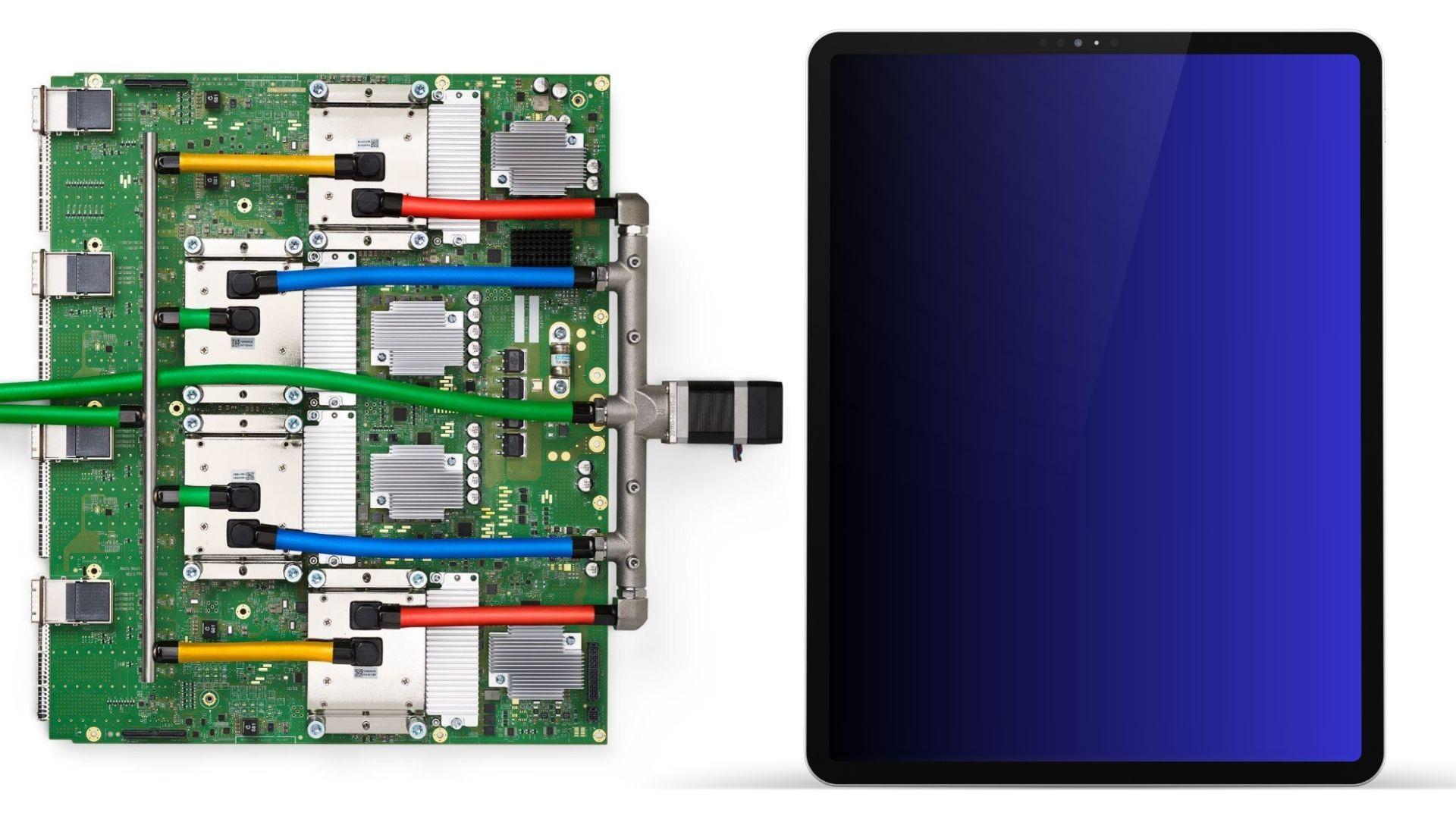

Una TPU, o Tensor Processing Unit, es un acelerador de hardware diseñado por Google para hacer extremadamente rápido el cálculo con tensores y matrices, que son la base matemática de la mayoría de algoritmos de deep learning. Aparecieron inicialmente en 2016 para dar soporte a sus sistemas de búsqueda, recomendaciones y otros servicios internos.

A diferencia de una GPU, que sigue siendo bastante generalista dentro del cómputo masivo en paralelo, la TPU está mucho más especializada en operaciones típicas de machine learning, como multiplicaciones masivas de matrices y vectores, convoluciones y operaciones tensoriales con precisión reducida. El objetivo es maximizar el rendimiento para entrenamiento e inferencia de modelos de IA en data centers.

Las TPU se organizan también en arquitecturas muy paralelas, con grandes matrices sistólicas y memorias internas que permiten pasar los datos de forma eficiente por la red de cómputo. Están optimizadas para trabajar con formatos numéricos adaptados al ML (como bfloat16 y otros tipos de baja precisión), generando enormes tasas de operaciones por segundo con un consumo energético relativamente contenido para el volumen de carga que mueven.

Una diferencia práctica clave es que las TPU están muy ligadas al ecosistema de Google Cloud. Aunque existen tarjetas físicas y sistemas dedicados en los centros de datos de Google, la mayoría de desarrolladores acceden a las TPU como un servicio en la nube, principalmente a través de TensorFlow, pero también con soporte para frameworks como PyTorch o JAX.

En muchos benchmarks internos, Google ha mostrado que una TPU puede lograr entre 15 y 30 veces más rendimiento que CPUs y GPUs de su época para ciertas cargas de inferencia con redes neuronales, lo que ha convertido a las TPU en una pieza estratégica dentro de su infraestructura de IA a gran escala.

NPU vs TPU: diferencias clave de propósito, arquitectura y uso

Aunque tanto NPU como TPU están pensadas para acelerar redes neuronales y deep learning, en la práctica atacan problemas y entornos bastante distintos. Es fácil confundirlas porque comparten muchas operaciones matemáticas, pero merece la pena separar bien sus papeles.

En cuanto al propósito principal, las TPU nacen para impulsar el procesamiento tensorial en tareas de aprendizaje profundo a gran escala, muy especialmente en visión por computador y modelos convolucionales o de transformadores gigantes. Las NPU, en cambio, se diseñan para acelerar el procesamiento de redes neuronales profundas, pero con un enfoque muy fuerte en la inferencia en tiempo real y la eficiencia energética, por lo que son más habituales en dispositivos finales que en grandes data centers.

A nivel de arquitectura física, las TPU de Google suelen implementarse como grandes sistemas en chip (SoC) o módulos completos dentro de racks de servidores, con una cantidad enorme de núcleos de procesamiento paralelo y redes de interconexión específicas para escalar en clusters. Las NPU, por su parte, se integran muchas veces como un bloque dentro de un SoC de móvil, de un procesador de portátil o de un chip de IoT, aunque también pueden existir como aceleradores separados en módulos PCIe o USB.

Si miramos el rendimiento y la eficiencia, una TPU brilla en cargas muy grandes, donde puedes aprovechar cientos o miles de chips repartidos en la nube, ofreciendo una relación rendimiento/consumo espectacular para entrenamiento e inferencia masiva. Las NPU, en cambio, apuntan a la eficiencia por vatio en dispositivos concretos: quizá no lleguen a los números brutos de una TPU de data center, pero consumen tan poco que son ideales para smartphones, cámaras, coches o NAS que tengan que procesar IA de forma continua sin disparar el gasto energético.

En el plano de las aplicaciones, podríamos decir que una TPU es perfecta para: entrenar grandes conjuntos de datos, desarrollar modelos de lenguaje de gran tamaño, desplegar sistemas de recomendación complejos o hacer inferencias masivas en la nube. Una NPU, en cambio, encaja mejor cuando quieres reconocimiento facial en el móvil, asistentes de voz locales, conteo de personas en videovigilancia, análisis rápido de imágenes médicas en un equipo hospitalario o IA en tiempo real en vehículos autónomos.

Otros aceleradores relacionados: DSP y VPU

Además de NPU y TPU, en el ecosistema de IA aparecen otros chips especializados como los DSP (Digital Signal Processor) y las VPU (Vision Processing Unit), que completan el panorama de aceleradores según el tipo de datos con el que trabajes.

Un DSP es un procesador digital de señal diseñado para manejar en tiempo real audio, vídeo y datos de sensores. Su fuerte son las operaciones matemáticas rápidas y repetitivas, como filtrado, compresión, transformadas y procesamiento continuo de señales. Se apoya en instrucciones específicas y arquitecturas optimizadas para que haya muy pocos retardos, lo cual es crítico en comunicaciones, sistemas de audio profesionales, procesado de imagen en ciertas cámaras o equipamiento médico.

En IA, los DSP se usan a menudo para preprocesar señales: limpiar audio antes de mandarlo a una red neuronal, comprimir o transformar vídeo, o preparar datos de sensores que después se pasarán a una NPU o GPU para análisis más complejo. Pueden ejecutar algunos modelos de IA, pero no son tan eficientes como una NPU o TPU para redes profundas grandes.

Una VPU (Vision Processing Unit), por su parte, está pensada específicamente para visión por computador. Procesa imágenes y vídeo de manera muy eficiente, ejecutando tareas como detección de objetos, reconocimiento facial, seguimiento de movimiento o análisis de escenas. Lo hace en tiempo real y con un consumo muy contenido, descargando a la CPU y la GPU de esas tareas.

Las VPU se usan en cámaras inteligentes, drones, vehículos autónomos, sistemas de vigilancia y dispositivos AR/VR, donde necesitas procesar varios streams de vídeo al mismo tiempo, con latencias muy bajas. También son clave cuando quieres ejecutar modelos de visión en el propio dispositivo, sin mandar continuamente las imágenes a la nube por motivos de privacidad o ancho de banda.

GPU vs NPU: ¿no tengo ya suficiente con mi tarjeta gráfica?

Es lógico preguntarse si, teniendo una GPU potente para IA, hace falta una NPU aparte. Al fin y al cabo, las GPU son muy buenas en operaciones de punto flotante, que es precisamente lo que se necesita para entrenar y ejecutar redes neuronales.

La diferencia clave es que la GPU sigue siendo más generalista dentro del cómputo paralelo: puede rendir de maravilla en gráficos, simulaciones físicas, ciencia de datos, IA y más. Una NPU, en cambio, está mucho más restringida al conjunto de operaciones necesarias para la inferencia de redes neuronales, sacrificando versatilidad a cambio de eficiencia y tamaño. Esto permite integrarla en SoC pequeños y optimizarla hasta el extremo para IA.

Un buen ejemplo son los Tensor Cores de NVIDIA, que son unidades especializadas dentro de la GPU pensadas para operaciones de matrices y tensores, muy similares en concepto a los bloques de una NPU. En cierto modo, podríamos decir que una GPU moderna lleva dentro «trozos» que se parecen mucho a una NPU, pero sigue incluyendo mucho más hardware para otras tareas (rasterización, texturizado, gráficos clásicos, etc.).

La tendencia actual es que cada parte del chip haga muy bien su trabajo específico: la CPU para lógica general, la GPU para paralelo masivo y gráficos, la NPU para IA, el DSP para señales, la VPU para visión. Este reparto permite mejorar rendimiento y consumo global, y es la razón por la que vemos cada vez más NPU integradas en procesadores y SoC, en lugar de depender solo de grandes GPU externas.

Todo este ecosistema de procesadores y aceleradores especializados está convergiendo hacia un escenario en el que la IA se ejecuta allá donde aporta más valor: en la nube con TPU para cargas gigantes, en servidores y estaciones de trabajo con GPU, y en el edge con NPU, DSP y VPU integrados en móviles, portátiles, NAS o vehículos. Entender qué hace cada uno te permite elegir mejor hardware, dimensionar tus proyectos y, sobre todo, no pagar de más por potencia que no vas a aprovechar.