- Vera Rubin integra GPU, CPU, DPU, SuperNIC y switches en un sistema de seis chips optimizado para IA agéntica y modelos de escala masiva.

- La plataforma NVL72 ofrece potencia exaescala, memoria HBM4 de altísimo ancho de banda y NVLink 6, reduciendo hasta 7 veces el coste por millón de tokens frente a Blackwell.

- Los requisitos de energía, refrigeración y red obligan a rediseñar los centros de datos, mientras el software (CUDA, compiladores, orquestadores) evoluciona hacia la exaescala.

- La adopción en la nube y la bajada del coste por token abren nuevas oportunidades para Big Data e IA, aumentando la demanda de perfiles capaces de exprimir esta arquitectura.

El anuncio de la arquitectura NVIDIA Vera Rubin en el CES 2026 ha marcado un antes y un después en la computación para inteligencia artificial. Ya no se trata solo de seguir la inercia de la Ley de Moore: el foco pasa a estar en cómo combinar CPU, GPU, redes y almacenamiento en una única plataforma pensada desde cero para la IA a escala extrema.

Para quienes se mueven en Big Data, IA generativa, IA agéntica y computación de alto rendimiento, esta nueva generación de hardware no es simplemente “otra GPU más potente”. Es una reimaginación completa de cómo se diseña un centro de datos moderno, desde el chip hasta la subestación eléctrica, pasando por el software, los modelos de programación y los costes de operación.

Qué es realmente NVIDIA Vera Rubin y por qué rompe con el modelo anterior

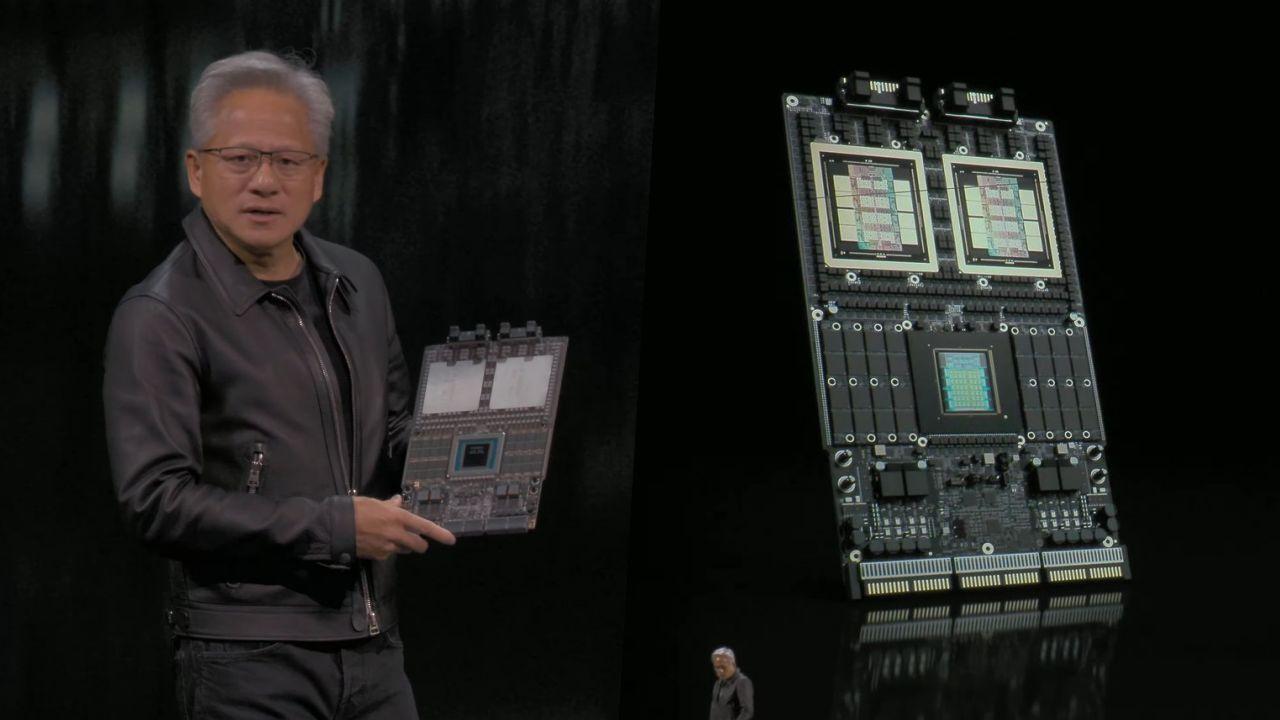

La plataforma NVIDIA Vera Rubin no es un único chip aislado, sino lo que Jensen Huang describe como “un sistema de seis chips trabajando en concierto”. El nombre rinde homenaje a Vera Florence Cooper Rubin, la astrónoma que ayudó a desentrañar el misterio de la materia oscura, una metáfora muy apropiada para un diseño que quiere iluminar el futuro de la IA.

A diferencia de generaciones previas, donde el titular era el tamaño del transistor o la frecuencia de reloj, Rubin se basa en un co-diseño extremo entre hardware y sistema. La plataforma integra de forma estrechísima CPU, GPU, DPU, SuperNICs y switches, de tal manera que se comportan casi como un único “organismo de silicio”, eliminando muchos de los cuellos de botella clásicos entre cómputo, memoria y red.

En el corazón de esta propuesta está el concepto de IA agéntica y razonamiento complejo. Si Blackwell dio el gran empujón a la IA generativa (texto, imagen, vídeo), Rubin está orientada a agentes capaces de planificar, tomar decisiones y ejecutar tareas prolongadas con memoria de largo plazo y acceso a herramientas externas.

Desde la perspectiva de los grandes proveedores de nube y los centros de supercomputación, Vera Rubin representa un salto de escala: potencia de superordenador exaescala concentrada en unos pocos racks, con densidades de energía y requisitos de refrigeración que dejan pequeños a los data centers actuales.

Los 6 pilares hardware de la arquitectura Rubin

El diseño de Rubin se articula alrededor de seis bloques de hardware que forman la espina dorsal de la plataforma y permiten este salto generacional de rendimiento y eficiencia.

En primer lugar está la GPU Rubin, una nueva generación de aceleradora con núcleos Tensor NVFP4 de precisión adaptativa, pensados para exprimir al máximo tanto el entrenamiento como la inferencia en IA moderna. Estos núcleos soportan desde formatos de muy baja precisión (como FP4 o INT4) hasta cómputo de alta precisión (FP32, FP64) para simulaciones científicas.

En segundo lugar entra en juego la CPU Vera, un procesador optimizado para el razonamiento agéntico y cargas masivas orientadas a IA. Se basa en 88 núcleos Arm 9.2 con hasta 172 hilos de ejecución y puede acompañarse de hasta 1,5 TB de memoria LPDDR5X en formato SOCAMM, proporcionando un plano de control extremadamente capaz para coordinar miles de GPUs.

El tercer elemento clave es el switch NVLink 6, la nueva generación de interconexión de NVIDIA. Soporta hasta 5 TB/s de ancho de banda bidireccional entre GPUs, lo que permite que cientos de GPUs funcionen casi como un único procesador lógico, con latencias de acceso a memoria inferiores al medio microsegundo.

En cuarto lugar se encuentra la SuperNIC ConnectX-9, capaz de ofrecer hasta 1,6 Tb/s de ancho de banda por tarjeta. Esta SuperNIC reduce al mínimo la latencia de red y acelera las comunicaciones tanto dentro del centro de datos como hacia el exterior, algo crítico para inferencia en tiempo real y servicios de IA en la nube.

El quinto bloque es la DPU BlueField-4, que actúa como cerebro especializado para gestionar redes, almacenamiento, seguridad y virtualización. Gracias a esta DPU, muchas tareas que tradicionalmente recaían en la CPU (y en menor medida en la GPU) se descargan, liberando recursos de cómputo para lo que realmente importa: entrenar y ejecutar modelos.

Por último, la arquitectura se completa con Spectrum-X Ethernet y Spectrum-6, switches de red específicamente diseñados para IA a gran escala, con óptica de silicio integrada. Esta combinación permite escalar a miles de racks, reduciendo dramáticamente el número de cables y transceptores necesarios, y manteniendo latencias muy bajas incluso en despliegues masivos.

Vera Rubin NVL72: el rack como unidad básica de supercomputación

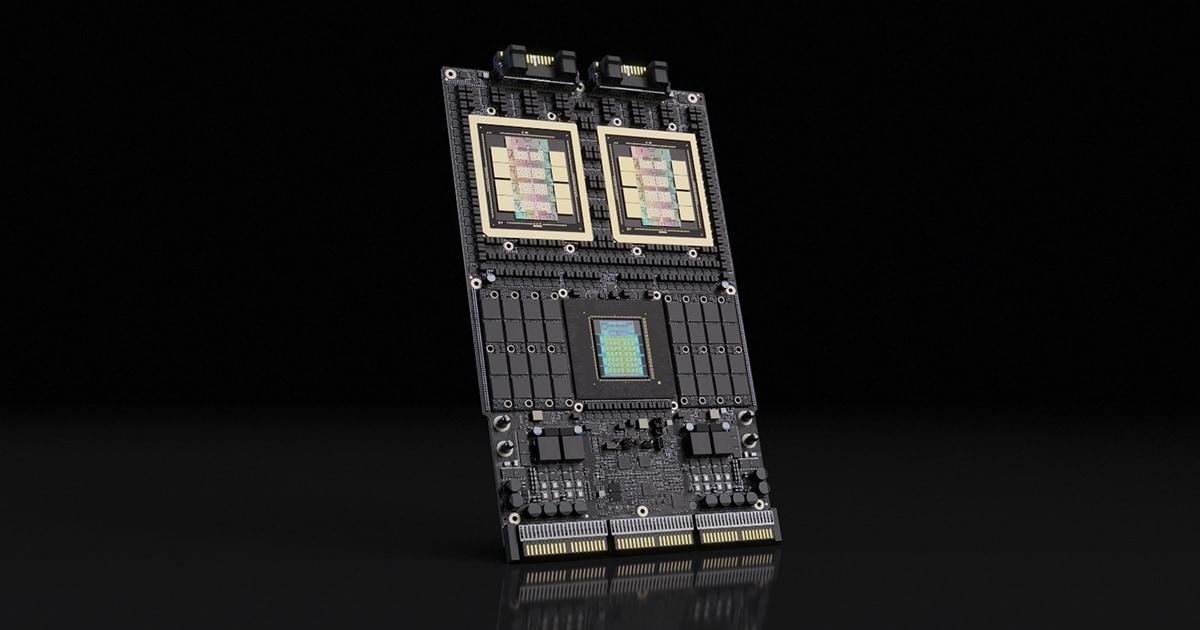

El elemento estrella de la plataforma es el NVIDIA Vera Rubin NVL72, un sistema a escala de bastidor que NVIDIA presenta como la unidad básica de despliegue para nubes como AWS, Azure o Google Cloud. En lugar de pensar en servidores sueltos, se piensa en racks completos como si fueran “superordenadores empaquetados”.

Este bastidor integra 72 GPUs Rubin y 36 CPUs Vera, junto a múltiples SuperNIC ConnectX-9 y DPUs BlueField-4, todo conectado mediante NVLink 6 y con escalado horizontal a través de InfiniBand Quantum-X800 y Ethernet Spectrum-X. El objetivo es proporcionar una plataforma exaescala lista para enchufar en el centro de datos.

Los datos que maneja NVIDIA son apabullantes: un rack NVL72 puede alcanzar del orden de 8 exaflops de potencia de IA en ciertas configuraciones, equivalente al rendimiento combinado de toda la lista TOP500 de superordenadores actuales, pero comprimido en lo que cabe en una sola fila de data center.

Esta densidad tiene un coste: cada rack puede llegar a consumir hasta 600 kW de potencia continua, con chips de hasta 2.000 W de TDP cada uno. Esto obliga a repensar desde la subestación eléctrica hasta el sistema de refrigeración, pasando por los suelos, las tuberías y la propia infraestructura de red.

El diseño de bastidor se basa en la tercera generación de arquitectura MGX NVL72, con bandejas modulares sin cables que facilitan el mantenimiento y la sustitución de módulos. Más de 80 partners del ecosistema MGX están listos para integrar esta plataforma en sus propios chasis y servidores, acelerando la adopción.

Especificaciones técnicas: del salto sobre Blackwell a Rubin Ultra

Si se compara con Blackwell, la generación previa de NVIDIA, Vera Rubin representa un salto de varios órdenes de magnitud en múltiples frentes: cómputo bruto, ancho de banda de memoria, interconexión, consumo y densidad de potencia.

Cada chip Rubin se estima en torno a 500.000 millones de transistores, casi el triple que Blackwell, gracias al uso de nodos de fabricación avanzados de TSMC (N3P y una transición prevista hacia N2). Esta brutal cantidad de transistores permite integrar aproximadamente 20.000 núcleos tensoriales por GPU, con soporte para precisión mixta que va de INT4 a FP64.

En términos de memoria, Rubin da el salto a HBM4, con un ancho de banda de hasta 13 TB/s por chip y capacidades de 288 GB de HBM4 por GPU. Una configuración NVL144 puede agrupar del orden de 75 TB de memoria ultrarrápida, suficiente para alojar modelos de cientos de miles de millones de parámetros en memoria cercana al cómputo.

Para la hoja de ruta de futuro, NVIDIA contempla Rubin Ultra, previsto para la segunda mitad de 2027, con memoria HBM4e y configuraciones NVL576 que alcanzarían los 365 TB de memoria total. Esta evolución obligará a entregar energía a 48 V directamente al chip para mantener la eficiencia y gestionar el consumo descomunal.

En cuanto al rendimiento de IA, las cifras publicadas sitúan a Rubin ofreciendo entrenamiento equivalente con una cuarta parte de las GPUs respecto a Blackwell y una reducción de hasta 7 veces en el coste por millón de tokens de inferencia. A nivel de plataforma, se habla de racks capaces de entregar hasta 50 exaflops en IA en determinadas configuraciones.

Chiplets, energía y refrigeración: la ingeniería que lo hace posible

Al acercarse al límite físico del tamaño de los chips monolíticos, la arquitectura de chiplets 3D se vuelve imprescindible para poder fabricar Rubin de forma rentable. Los dies de cómputo se producen en nodos punteros (N2), mientras que los de E/S y otros bloques auxiliares pueden ir en procesos más maduros como N4.

Esta aproximación requiere técnicas de empaquetado avanzadas, como la tecnología SoIC de TSMC, que permiten decenas de miles de conexiones por milímetro cuadrado entre chiplets, manteniendo integridad de señal a velocidades de varios terabits por segundo. En la práctica, el paquete del chip se convierte en un pequeño “sándwich” tridimensional de silicio.

La entrega de energía es otro de los grandes retos. Con chips de alrededor de 2.000 W de TDP, el clásico esquema de 12 V se vuelve ineficiente: las corrientes serían tan altas que las pérdidas por calor serían inaceptables. Rubin adopta distribución de energía a 48 V directamente al paquete, con convertidores y regulación integrados cerca del propio die.

Esta electrónica de potencia debe operar con eficiencias cercanas al 98 %, algo que ya se ha visto en arquitecturas factorizadas como las de Vicor, pero que a su vez exigen refrigeración líquida e incluso de dos fases para mantenerse dentro de márgenes térmicos razonables.

El flujo de calor a nivel de chip puede superar los 500 W por centímetro cuadrado, acercándose a densidades térmicas similares a las de las cámaras de combustión de un motor de cohete. Se investigan soluciones de microcanales de silicio, con canales de apenas 50 micras, capaces de extraer hasta 1 kW/cm² con pequeños saltos de temperatura.

Todo esto implica que las placas frías y los bloques de refrigeración se fabrican con procesos casi tan complejos como los de los propios chips, con costes que pueden situarse en el rango de 10.000-15.000 dólares por unidad y necesidades de mantenimiento regular para evitar incrustaciones y pérdida de rendimiento.

Demanda energética y rediseño radical de los centros de datos

El despliegue masivo de sistemas Vera Rubin obliga a tirar por la borda muchas de las suposiciones tradicionales de diseño de centros de datos. Un solo rack que consuma 500-600 kW significa que un despliegue de 100 racks puede rozar los 50-60 MW, comparable a la demanda de una ciudad pequeña.

Las instalaciones deben incorporar subestaciones eléctricas dedicadas, típicamente con alimentaciones de media tensión (13,8 kV) y distribución interna a 4.160 V. Los suelos elevados convencionales desaparecen en favor de losas reforzadas capaces de soportar cargas superiores a 2.000 kg/m².

La refrigeración se convierte en un sistema industrial a gran escala. Para evacuar cientos de kilovatios por rack, se recurre a refrigeración líquida directa al chip y, en muchos casos, a sistemas de dos fases donde el fluido hierve al entrar en contacto con las superficies calientes y se condensa posteriormente en intercambiadores.

Las redes de tuberías internas pueden alcanzar diámetros de hasta 12 pulgadas para llevar miles de litros por minuto a cada fila de racks. Se necesitan sistemas de contención de fugas y redundancia capaces de gestionar fallos catastróficos sin poner en riesgo la instalación ni el entorno.

En el plano de la red, cada sistema Vera Rubin puede requerir del orden de 16 puertos de 800 GbE, lo que suma más de 12 Tb/s por sistema. Esto hace imprescindible el uso de interconexión óptica, Ultra Ethernet y switches fotónicos, ya que los cables de cobre no son viables para estas velocidades a distancias de centro de datos.

Una nueva era de software: de la GPU discreta al sistema coherente de 256 GPUs

En el lado del software, Rubin también impone un cambio de paradigma. Los modelos de programación diseñados para GPUs discretas conectadas por PCIe empiezan a quedarse cortos cuando 256 GPUs trabajan como un dispositivo lógico coherente con memoria virtual unificada que puede llegar a decenas de terabytes.

NVIDIA prepara una evolución de CUDA hacia la versión 15.0, donde las APIs se adaptan a la computación exaescala. Cooperative Groups se amplía para coordinar millones de hilos a través de sistemas enteros y la memoria unificada se extiende a asignaciones de escala petabyte con migración automática entre niveles de cómputo y almacenamiento.

Los compiladores dan un salto similar. Se generaliza el uso de representaciones intermedias basadas en grafos, como MLIR, que permiten optimizar desde las operaciones matemáticas de alto nivel hasta las instrucciones concretas de los núcleos tensoriales. Los tiempos de compilación se disparan, pero el código resultante se aproxima al 90 % del rendimiento teórico de la máquina.

Las plataformas de orquestación (Kubernetes y similares) también se ven forzadas a evolucionar. Cuando un solo pod puede necesitar 256 GPUs y 500 kW de potencia, hay que introducir en el programador información de disponibilidad de energía, capacidad de refrigeración, topología de red y hasta estado térmico del centro de datos.

En paralelo, las herramientas de depuración y perfilado se enfrentan a una avalancha de datos: un único sistema Rubin puede generar cientos de gigabytes por segundo de telemetría. El análisis manual es inviable, por lo que se empieza a recurrir a IA para analizar el comportamiento de la infraestructura de IA, cerrando un curioso bucle.

Impacto en Big Data, IA agéntica y LLM de un billón de parámetros

Para estudiantes y profesionales de Big Data, machine learning y sistemas distribuidos, la pregunta práctica es: ¿qué cambia en su día a día con Vera Rubin en el horizonte cercano?

En primer lugar, el propio límite de lo que se puede entrenar. La plataforma está pensada para manejar LLM de hasta un billón de parámetros (o más) con una eficiencia radicalmente superior. Gracias a la capacidad de memoria HBM4 conjunta y a la interconexión de NVLink 6, modelos de esta escala pueden residir en memoria cercana al cómputo en lugar de depender de trucos constantes de paginación.

En segundo lugar, aparece con fuerza la IA con memoria de largo plazo. La combinación de GPUs Rubin con la DPU BlueField-4 permite gestionar grandes cachés KV externas al dispositivo de cómputo de forma transparente. Esto libera a la GPU de tareas de gestión de memoria y permite mantener contextos conversacionales, historiales y bases de conocimiento en pools de almacenamiento escalables.

En tercer lugar, se reduce drásticamente el coste por token. NVIDIA habla de una mejora aproximada de 10 veces en el coste marginal de la inferencia frente a generaciones anteriores, lo que abre la puerta a que startups, universidades y equipos pequeños accedan a capacidades de inferencia antes reservadas a gigantes tecnológicos.

Por último, la propia CPU Vera, optimizada para razonamiento agéntico, facilita el desarrollo de agentes de IA capaces de dividir tareas complejas en subtareas, planificar, llamar a herramientas externas y coordinar sesiones largas de trabajo sin depender exclusivamente del modelo generativo.

Economía, adopción en la nube y oportunidades profesionales

Desde el punto de vista económico, un sistema Vera Rubin puede situarse alrededor de los 10 millones de dólares por unidad. Puede parecer una cifra desorbitada hasta que se compara con la capacidad efectiva frente a generaciones anteriores.

En cómputo bruto, un rack Rubin puede equivaler a miles de GPUs de generaciones como H100 o incluso Blackwell, pero con 4 veces mejor eficiencia de capital y hasta 10 veces mejor eficiencia energética. Construir una capacidad similar con hardware previo podría costar del orden de 40 millones y consumir varios megavatios adicionales.

Los costes operativos, eso sí, son significativos: un sistema con 500 kW de consumo continuo puede costar centenares de miles de dólares al año solo en energía, más refrigeración, mantenimiento e infraestructuras asociadas. Esto obliga a maximizar la utilización (por encima del 70-80 %) para que el modelo de negocio tenga sentido.

Los grandes proveedores de nube ya se están posicionando. Microsoft ha anunciado inversiones de miles de millones de dólares en infraestructura para plataformas de próxima generación, con nuevas regiones diseñadas para densidades de más de 500 kW por rack. AWS y Google Cloud siguen un camino parecido, reservando capacidad para Rubin incluso antes de que lleguen las primeras remesas de producción.

En este contexto, la demanda de ingenieros de datos, arquitectos cloud y especialistas en MLOps que entiendan cómo optimizar pipelines para Rubin se dispara. Conocer en detalle NVLink, la gestión de memoria con BlueField, los nuevos modelos de programación de CUDA y las implicaciones de energía y refrigeración se convierte en un plus enorme en el mercado laboral.

Para la formación avanzada, como los másteres en Big Data e IA, esto supone adaptar constantemente los contenidos para cubrir no solo los algoritmos de hoy, sino también la infraestructura sobre la que correrán los modelos de mañana. Quien entienda cómo se articula un rack NVL72 desde el silicio hasta el orquestador de contenedores tendrá una ventaja clara frente a otros perfiles más centrados únicamente en el código.

La arquitectura NVIDIA Vera Rubin consolida un nuevo techo de capacidad de cálculo, cambia las reglas del juego en términos de coste por token y empuja a la industria a rediseñar data centers, software y modelos de negocio alrededor de la IA. Para desarrolladores, investigadores y empresas, comprender sus piezas clave —GPU Rubin, CPU Vera, NVLink 6, BlueField-4, Spectrum-X y el bastidor NVL72— será fundamental para aprovechar las oportunidades que trae esta nueva generación de supercomputación para inteligencia artificial.