- NVIDIA Ising es una familia abierta de modelos de IA diseñada para calibrar procesadores cuánticos y mejorar la corrección de errores en sistemas híbridos QPU‑GPU.

- Incluye Ising Calibration, un modelo visión‑lenguaje para automatizar la calibración continua, e Ising Decoding, redes neuronales 3D que multiplican velocidad y precisión frente a pyMatching.

- La iniciativa se integra con CUDA‑Q, NVQLink y los microservicios NIM, y ya está siendo adoptada por laboratorios, universidades y empresas cuánticas de primer nivel.

- Al ofrecer modelos, datos y herramientas de código abierto, NVIDIA busca establecer estándares de facto y acelerar un mercado cuántico que podría superar los 11.000 millones de dólares en 2030.

La computación cuántica se ha convertido en uno de los campos más prometedores y, a la vez, más frustrantes de la tecnología actual. Sobre el papel, sus capacidades para resolver problemas de optimización, simulación y criptografía son espectaculares, pero cuando bajamos al laboratorio todo se tuerce: los qubits son inestables, el hardware es extremadamente delicado y cualquier ruido ambiental arruina los cálculos.

En este contexto aparece NVIDIA Ising, una familia de modelos de inteligencia artificial de código abierto que no pretende venderte “un ordenador cuántico”, sino atacar justo donde más duele: la calibración continua de los procesadores cuánticos y la corrección de errores. Es, dicho fino, un intento de convertir el caos del laboratorio en una operación más industrial y repetible, usando IA como sistema nervioso del hardware cuántico.

Qué es NVIDIA Ising y por qué se llama así

Cuando hablamos de NVIDIA Ising nos referimos a un conjunto de modelos, datos y herramientas de IA pensado para operar en sistemas híbridos cuántico-clásicos, donde conviven QPUs (procesadores cuánticos) y GPUs. No es una única red neuronal, sino una familia abierta que los investigadores pueden adaptar a su propio hardware, tanto si trabajan en un gran laboratorio nacional como en una startup cuántica.

El nombre no es casualidad. Hace casi un siglo, el físico Ernst Ising desarrolló el modelo de Ising para estudiar cómo interactúan partículas con espines magnéticos en sistemas complejos. Ese modelo se convirtió en un clásico de la física estadística para entender transiciones de fase y comportamientos colectivos en materiales, precisamente porque simplifica sistemas endiabladamente complicados en una formulación manejable.

La computación cuántica moderna utiliza variaciones de modelos tipo Ising para formular problemas de optimización y simulación física. NVIDIA toma ese concepto y lo recicla como metáfora: igual que el modelo de Ising redujo la complejidad de ciertos sistemas físicos, esta familia de IA quiere reducir la complejidad operativa de mantener vivos y útiles los qubits en máquinas reales.

Desde el punto de vista de integración, NVIDIA Ising está diseñado para encajar como un guante con CUDA‑Q (la plataforma de software de NVIDIA para programación híbrida cuántico-clásica) y con la interconexión NVQLink, que une QPU y GPU con la menor latencia posible. Además, puede desplegarse como parte de los microservicios NVIDIA NIM o ejecutarse de forma local, de manera que cada organización pueda conservar el control total sobre sus datos propietarios.

Otro detalle clave es que Ising se suma a un catálogo de modelos abiertos muy orientados a dominios concretos: Nemotron para IA agente, Cosmos para IA física, Isaac para robótica, Clara/BioNeMo para biomedicina o Alpamayo para vehículos autónomos. La estrategia es clara: montar un ecosistema donde cada vertical técnico tenga su “paquete” de IA listo para enchufar.

El gran cuello de botella de la cuántica: ruido, control y repetición

El discurso mediático sobre computación cuántica suele centrarse en cuántos qubits tiene cada prototipo, pero el problema real está en otra parte: esos qubits son frágiles, ruidosos y se descalibran continuamente. Sin calibración constante y sin una corrección de errores eficaz, hablar de escalabilidad es casi una ilusión.

Los mejores procesadores cuánticos actuales llegan, según datos citados por responsables de NVIDIA, a tasas de un error cada mil operaciones. Para tareas científicas o empresariales de alto valor haría falta acercarse a un error entre un billón de operaciones o incluso menos. La brecha es enorme y no se salva solo sumando qubits.

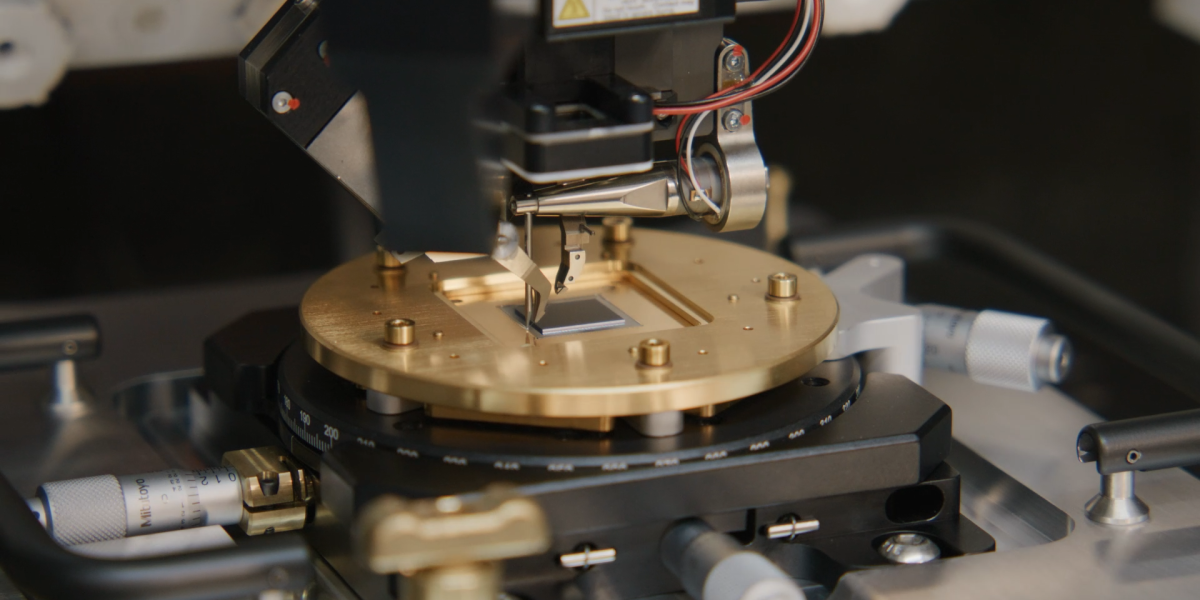

Hasta ahora, el trabajo sucio de mantener una máquina cuántica operativa estaba en manos de equipos de físicos afinando parámetros a mano durante días, o de sistemas automáticos bastante básicos incapaces de seguir el ritmo de arquitecturas cada vez más complejas. Cada vez que se ampliaba el número de qubits, se disparaba la sobrecarga operativa: más tiempo de calibración, más datos de error que procesar, más oportunidades para que algo falle.

NVIDIA describe este cuello de botella con bastante crudeza: la corrección de errores cuánticos implica procesar terabytes de mediciones miles de veces por segundo con decodificadores clásicos muy exigentes. Si esa capa de procesamiento no escala, da igual que tengas un QPU espectacular en la sala de al lado: no podrás explotarlo de forma estable.

Por eso la compañía apuesta por usar IA como “plano de control” o, dicho de forma llana, como semiosistema operativo de las máquinas cuánticas. En lugar de vender un chip cuántico propio, NVIDIA busca ser el puente entre el QPU y la GPU, capturando el valor donde más tiempo y dinero se va ahora mismo: en la operación diaria, no en la foto del prototipo.

Ising Calibration: la IA que sustituye la artesanía de laboratorio

Dentro de la familia, la pieza más llamativa es Ising Calibration, un modelo de tipo visión‑lenguaje (Vision-Language Model, VLM) con del orden de 35.000 millones de parámetros. Su función es interpretar mediciones y resultados experimentales del procesador cuántico y decidir automáticamente qué acciones de calibración tomar.

A nivel práctico, esto significa que los agentes de IA pueden usar Ising Calibration para automatizar un proceso que hasta ahora era casi artesanal: revisar curvas de calibración, identificar desviaciones, ajustar frecuencias, tiempos de puerta, pulsos de control, etc. Donde antes un equipo podía pasarse varios días ajustando un QPU complejo, ahora se aspira a tener un flujo automatizado que reduzca ese esfuerzo a horas.

NVIDIA afirma que este enfoque supera a otros métodos existentes en una batería de seis pruebas centradas en rendimiento de calibración. Más allá de los benchmarks concretos, lo relevante es el cambio de paradigma: la calibración deja de ser un acto puntual y manual para convertirse en un proceso continuo, gobernado por un modelo que puede aprender de los datos de cada sesión de laboratorio.

Ising Calibration ya está en manos de un buen número de actores del sector. Lo utilizan, entre otros, Atom Computing, Academia Sinica, EeroQ, Conductor Quantum, Fermi National Accelerator Laboratory, la Escuela de Ingeniería y Ciencias Aplicadas John A. Paulson de Harvard, Infleqtion, IonQ, IQM Quantum Computers, el Advanced Quantum Testbed del Lawrence Berkeley National Laboratory, Q‑CTRL y el National Physical Laboratory (NPL) del Reino Unido. Es decir, no se queda en un anuncio bonito: se está probando en laboratorios y empresas reales.

Esta adopción temprana envía un mensaje claro: si quieres que un banco de pruebas cuántico funcione como una plataforma estable y no como una demo puntual, necesitas convertir la calibración en algo rutinario, repetible y, en la medida de lo posible, automatizado. Justo lo que promete Ising Calibration.

Ising Decoding: atacar el problema de la corrección de errores

La segunda gran pata de NVIDIA Ising es Ising Decoding, orientada específicamente a la corrección de errores cuánticos. Aquí hablamos de decodificar en tiempo real los “síndromes” de error que producen los códigos de corrección, para decidir qué errores se han producido y cómo compensarlos antes de que el estado cuántico se degrade.

Ising Decoding incluye dos variantes de un mismo modelo de red neuronal convolucional 3D (3D CNN), pensadas para pre‑decodificación: una versión prioriza la velocidad y la otra la precisión, con arquitecturas relativamente compactas (aproximadamente 0,9 millones y 1,8 millones de parámetros). La idea es que el usuario pueda elegir el punto de equilibrio que más le convenga entre latencia y exactitud.

Estos modelos se entregan ya entrenados para trabajar con ruido depolarizante en surface codes de cualquier distancia, que son uno de los esquemas de corrección de errores más relevantes hoy en día. Además, NVIDIA proporciona un marco de entrenamiento basado en PyTorch y CUDA‑Q para que los investigadores puedan ajustar el sistema a otros modelos de ruido específicos de su hardware.

En términos de rendimiento, la compañía habla de una mejora de hasta 2,5 veces en velocidad y 3 veces en precisión respecto a pyMatching, el estándar abierto más usado actualmente para este tipo de tareas. Si esas cifras se confirman de forma amplia fuera de los bancos de pruebas internos, el impacto no es solo técnico: menos latencia y más precisión significan menos cómputo desperdiciado en entender el error, y más ciclos dedicados a ejecutar algoritmos útiles.

Ising Decoding también ha empezado a encontrar hueco en la comunidad. Lo están implementando, entre otros, la Universidad de Cornell, EdenCode, Infleqtion, IQM Quantum Computers, Quantum Elements, Sandia National Laboratories, la Universidad de California en San Diego, UC Santa Barbara, la Universidad de Chicago, la Universidad del Sur de California y la Universidad de Yonsei. Es una lista larga que combina centros académicos de primer nivel y empresas orientadas a producto.

IA como “sistema operativo” de las máquinas cuánticas

Una forma muy gráfica de entender NVIDIA Ising es pensar que la IA hace de plano de control de los sistemas cuánticos. Jensen Huang, CEO de NVIDIA, lo resume señalando que la inteligencia artificial es esencial para que la computación cuántica sea práctica, y que con Ising la IA pasa a ser el equivalente a un sistema operativo para las máquinas cuánticas.

En la práctica, esto significa dejar en manos de modelos especializados dos funciones críticas: la calibración continua de la QPU y la decodificación para corrección de errores. En vez de tratar de construir un QPU perfecto —algo inviable con la tecnología actual— se apuesta por un enfoque de “QPU ruidoso pero bien gestionado”, apoyado en GPUs y en decodificadores neuronales muy optimizados.

La analogía con otras tecnologías de NVIDIA es inevitable: muchos ven Ising como una especie de “DLSS para hardware cuántico”. No mejora el qubit en sí, pero sí la manera en que se controla, se corrige y se exprime, más o menos igual que el DLSS no cambia la GPU física, pero sí la forma en que se generan e interpolan los fotogramas para sacar más partido del hardware disponible.

En este esquema, la interconexión NVQLink juega un papel crucial, proporcionando un enlace de baja latencia entre el controlador cuántico y las GPUs que ejecutan Ising. La corrección de errores tolerante a fallos exige tomar decisiones muy rápidas; si esas decisiones llegan tarde porque los datos tienen que viajar demasiado o procesarse en una CPU saturada, el sistema completo se degrada.

La plataforma CUDA‑Q es la otra mitad del puente. Actúa como capa de software para coordinar el cómputo cuántico y clásico, definiendo flujos de trabajo donde la QPU ejecuta operaciones cuánticas mientras la GPU, a través de modelos como Ising, se encarga de interpretar mediciones, ajustar parámetros y corregir errores prácticamente en tiempo real.

Un movimiento de código abierto con mucha letra pequeña

Uno de los aspectos más interesantes de NVIDIA Ising es que se lanza como familia de modelos abiertos, con licencias permisivas, y acompañado de documentación detallada sobre su procedencia (provenance), métodos de entrenamiento, datos utilizados y herramientas para ajustar y cuantizar los modelos.

En un sector donde cada laboratorio suele guardar sus rutinas de calibración como “receta secreta”, publicar modelos de este calibre con trazabilidad clara es casi una provocación. Obliga, en la práctica, a moverse hacia estándares de facto que pueden inspeccionarse, reproducirse y adaptar a diferentes plataformas cuánticas.

Desde el punto de vista político y de adopción, la jugada tiene sentido. Hacer que los modelos sean realmente abiertos reduce fricciones para que institutos, laboratorios nacionales y universidades los incorporen en sus infraestructuras sin chocar con restricciones excesivas. Al mismo tiempo, refuerza el “stack NVIDIA” como plataforma de referencia en computación cuántica híbrida, porque muchos flujos de trabajo acabarán apoyándose en CUDA‑Q, NVQLink y los microservicios NIM.

Hay que tener en cuenta que estos modelos, datos y frameworks se publican en GitHub, Hugging Face y build.nvidia.com, lo que facilita la integración en pipelines de desarrollo y MLOps ya existentes. No es solo liberar el código, sino colocarlo justo donde los desarrolladores ya están trabajando.

Eso sí, abierto no quiere decir altruista. Al convertir sus herramientas en estándar de facto, NVIDIA se vuelve difícil de evitar en cualquier proyecto que busque escalar hardware cuántico con ayuda de IA. Es una estrategia similar a la que siguió en su día con CUDA en el mundo de las GPUs: abrir lo suficiente para que todo el mundo lo use, pero manteniendo el control de la plataforma central.

Impacto para empresas, investigadores y mercado cuántico

Desde la perspectiva de negocio, NVIDIA Ising llega en un momento clave. Firmas de análisis como Resonance estiman que el mercado de computación cuántica podría superar los 11.000 millones de dólares en 2030, siempre y cuando se resuelvan dos grandes retos de ingeniería: escalabilidad y corrección de errores.

La apuesta de NVIDIA es que la IA es la pieza que faltaba para desbloquear ese crecimiento. Si los modelos Ising consiguen reducir drásticamente el tiempo de calibración y mejorar el rendimiento de la corrección de errores, la cuántica empezará a salir del laboratorio de investigación pura para pisar terreno de aplicaciones más prácticas, al menos en escenarios híbridos con qubits lógicos y algoritmos tolerantes a fallos.

Para empresas de sectores como finanzas, logística, materiales o farmacéutica, esto no significa que vayan a tener un superordenador cuántico en la oficina pasado mañana, pero sí que se acorta el camino hacia servicios cuánticos accesibles a través de la nube o de centros de supercomputación, donde la IA gestione gran parte del mantenimiento invisible.

Profesionales de infraestructura, ciencia de datos y desarrollo de software deberían ir tomando nota de dos tendencias claras: por un lado, la convergencia entre IA y cuántica; por otro, la especialización de modelos abiertos por dominios muy concretos. Igual que la transformación digital ha requerido enfoques muy específicos según la industria, es probable que veamos soluciones de IA‑cuántica adaptadas a patrones de problema muy particulares.

En paralelo, el hecho de que Ising se publique con benchmarks y datos reproducibles facilita comparar resultados de una forma mucho más honesta. En una industria donde el humo y las promesas grandilocuentes han ido muchas veces por delante de la realidad, medir de forma transparente qué decodificador va mejor, en qué condiciones y con qué costes puede ser casi tan disruptivo como las mejoras técnicas en sí.

Lo que ya se empieza a ver es una incipiente carrera por integrar Ising en flujos de trabajo reales: desde institutos nacionales hasta startups que no pueden permitirse equipos enormes de físicos ajustando máquinas a mano. Y, al mismo tiempo, una presión para que otros actores del sector respondan con herramientas equivalentes o compatibles, lo que podría acelerar todavía más la madurez del ecosistema.

La computación cuántica sigue estando lejos de ser una tecnología cotidiana, pero con NVIDIA Ising la conversación se desplaza, por fin, del titular de “miles de qubits” al terreno de la operación estable, la corrección de errores eficiente y la calibración automatizada. Ahí es donde se decidirá qué plataformas sobreviven y quién se queda con la parte más jugosa de la cadena de valor.