- Google divide las TPU v8 en dos chips especializados, 8t para entrenamiento masivo y 8i para inferencia y razonamiento de baja latencia.

- TPU 8t alcanza hasta 121 EFLOPs por superpod y mejora hasta 2,8 veces el coste-rendimiento de entrenamiento frente a la generación previa.

- TPU 8i multiplica por casi 10 el rendimiento EFLOPs por pod, dispara la memoria HBM agregada y reduce drásticamente la latencia de inferencia.

- Al controlar todo el stack de IA, Google evita la ‘Nvidia tax’ y ofrece un rendimiento por dólar muy superior para startups y grandes empresas.

En plena explosión de la inteligencia artificial generativa y los modelos gigantes, se ha abierto una nueva carrera: ya no se trata solo de quién diseña el mejor modelo, sino de quién controla el hardware que lo hace posible. Mientras muchas compañías siguen dependiendo del ecosistema de GPUs de NVIDIA, Google ha decidido ir por libre y reforzar su apuesta por las TPU, sus propios aceleradores de IA, que ya van por la octava generación con las nuevas TPU v8t y v8i.

Estas TPU v8 llegan en un contexto donde las Big Tech estadounidenses están vaciando la chequera para asegurarse décadas de ventaja en cómputo. En este escenario, Google combina dos cartas ganadoras: un stack de IA totalmente vertical (desde la energía del data center hasta el servicio final en la nube) y unos chips cada vez más especializados. El resultado son las TPU v8t y v8i, dos procesadores distintos para dos misiones críticas: entrenamiento masivo y razonamiento/inferencia a gran escala.

El contexto: la guerra del cómputo entre Big Tech y la ‘Nvidia tax’

En los últimos años, el gasto en IA de las grandes tecnológicas se ha disparado hasta cifras mareantes, con una inversión agregada que ronda los cientos de miles de millones de dólares en apenas un par de ejercicios. En ese grupo destacan Meta, Amazon, Microsoft, Apple y Google, que se reparten el trono del sector tecnológico y marcan el ritmo de la carrera de modelos de frontera.

Sorprende que, según estimaciones recientes, sea Amazon la que lidere el gasto directo en IA, seguida muy de cerca por Google, que destina del orden de 185.000 millones de dólares a este frente. Meta también ha anunciado cifras desorbitadas para reforzar su apuesta por modelos de lenguaje y visión, incluso a costa de reestructuraciones internas y recortes de plantilla.

Google, sin embargo, juega con una ventaja estructural: diseña y controla hasta seis capas completas de su stack de IA, desde la infraestructura eléctrica y de refrigeración del centro de datos hasta los modelos Gemini que luego ofrece como servicio. Eso le permite esquivar lo que muchos ya llaman la ‘Nvidia tax’: el margen bruto del 70-80 % que NVIDIA puede aplicar sobre GPUs como H200 o Blackwell y que otros proveedores tienen que pagar sí o sí.

Mientras OpenAI, Anthropic o Meta dependen de estas GPUs, Google paga básicamente costes de fabricación, empaquetado e ingeniería de sus propias TPUs, sin el recargo de terceros. Según datos de generaciones anteriores como TPU v6e, esto se traduce en hasta 4 veces mejor rendimiento por dólar y reducciones de latencia en inferencia de hasta el 96 % usando stacks optimizados como vLLM.

Para startups y empresas que se juegan la vida en su estructura de costes, esta diferencia no es una simple optimización marginal: es una ventaja competitiva sostenida en rendimiento por dólar y en capacidad de escalar sin arruinarse en hardware de terceros.

Qué son las TPU v8t y TPU v8i: dos chips, dos misiones

Con la octava generación de sus Tensor Processing Units, Google ha tomado una decisión que va a contracorriente de otros fabricantes: en lugar de un chip “para todo”, lanza dos variantes altamente especializadas, TPU v8t y TPU v8i. Esta división se gestó ya en 2024, cuando se hizo evidente que las necesidades de entrenamiento y las de inferencia/razonamiento iban a divergir cada vez más.

Por un lado, la TPU v8t (training) se centra en el entrenamiento de modelos de gran escala, incluidos modelos multimodales con billones de parámetros. Por otro, la TPU v8i (inference) está pensada para servir esos modelos en producción, especialmente en escenarios de agentes, reasoning en bucle y millones de consultas diarias con ventanas de contexto enormes.

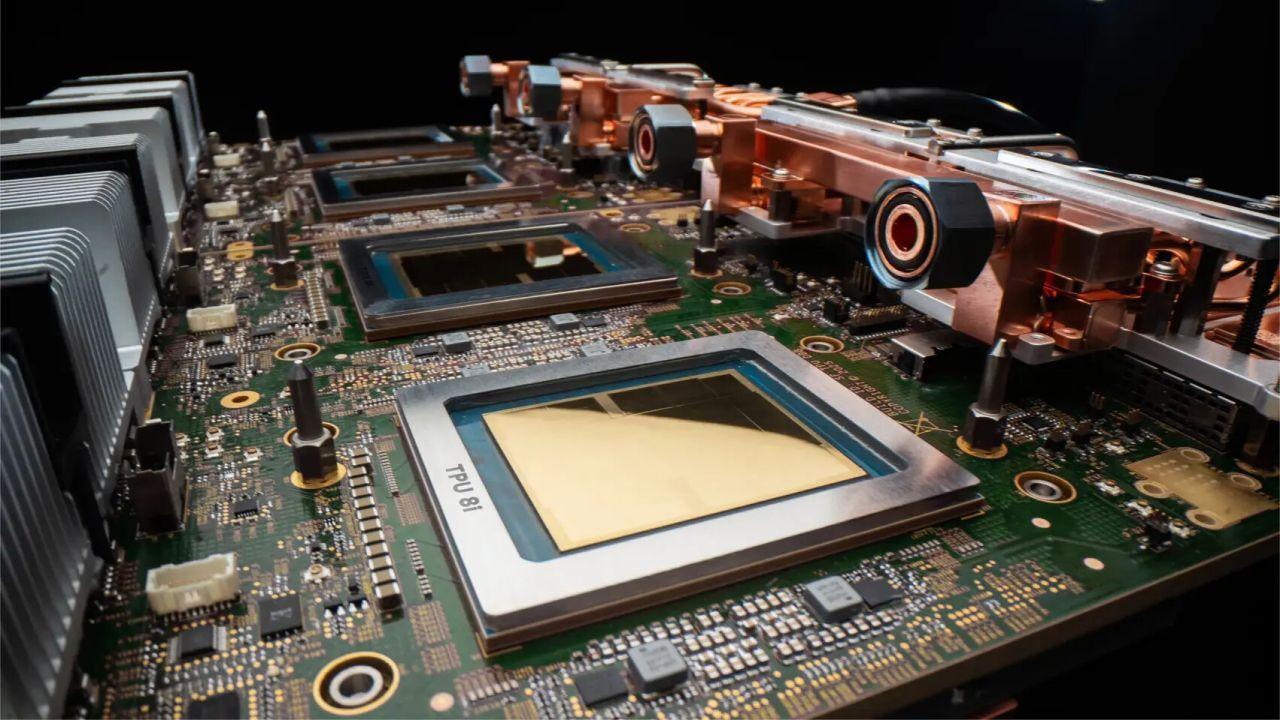

A nivel de cadena de suministro, Google también ha movido ficha. La versión de entrenamiento, con nombre en clave Sunfish (TPU v8t), se fabrica en proceso de 2 nm por TSMC y está diseñada junto a Broadcom, que entrega un paquete casi llave en mano con dos matrices de cómputo, un chiplet de I/O y ocho bancos de memoria HBM3E de alta capacidad. La versión de inferencia, Zebrafish (TPU v8i), corre a cargo de MediaTek, con una arquitectura más sencilla de una sola matriz y seis bancos de HBM, optimizada para latencia, coste y volumen.

Esta estrategia dual también busca reducir la presión sobre recursos muy escasos como el empaquetado avanzado CoWoS y las memorias HBM, actualmente copados por NVIDIA. Al diversificar contratos entre Broadcom, MediaTek y otros posibles socios, Google se asegura capacidad de producción y evita depender en exceso de un único proveedor en plena guerra por los semiconductores.

Según análisis de firmas como TrendForce y SemiAnalysis, el mercado de chips de IA personalizados crecerá en torno a un 45 % en 2026, muy por encima del crecimiento previsto para GPUs estándar. Dentro de ese pastel, las TPU v8 de Google son una pieza clave para sostener futuras generaciones de Gemini y los acuerdos multi-gigavatio que ya ha firmado con empresas como Anthropic.

Especificaciones de TPU 8t: el monstruo de entrenamiento

La TPU 8t es el músculo bruto de la familia. Está diseñada para preentrenar modelos gigantes de IA en tiempos razonables y con una eficiencia de coste mucho mejor que la generación anterior. Cada chip integra 216 GB de memoria HBM para cómputo de entrenamiento y 128 MB de SRAM on-chip (Vmem), además de un ancho de banda de memoria de 6.528 GB/s.

En términos de potencia de cálculo, TPU 8t alcanza hasta 12,6 PFLOPs en formato FP4 por chip, un salto enorme frente a generaciones como TPU v5p. A modo de comparación, aquellas v5p contaban con 95 GB de HBM y 2.765 GB/s de ancho de banda; ahora hablamos de más del doble tanto en capacidad de memoria como en ancho de banda efectivo.

Cuando miramos la escala de despliegue real, los nuevos Superpods de TPU 8t pueden agrupar hasta 9.600 chips por pod, frente a los 9.216 de la generación Ironwood (TPU v7). Eso supone 384 chips adicionales por pod y un cómputo que llega a 121 EFLOPs en FP4/FP8, casi triplicando los 42,5 EFLOPs que lograba un superpod Ironwood un año antes.

El ancho de banda entre chips también se ha disparado: cada TPU 8t disfruta de 19,2 Tb/s de ancho de banda de escala-up y la red se ha reforzado con Virgo, una topología pensada para entrenar modelos de billones de parámetros. La interconexión de centro de datos ha pasado de 100 Gb/s a 400 Gb/s, lo que equivale a un aumento del 300 % en capacidad de red.

A nivel de eficiencia, Google habla de una mejora de entre 170 % y 180 % en coste-rendimiento de entrenamiento (es decir, 2,7-2,8 veces más rendimiento por dólar) y de un +124 % en rendimiento por vatio frente a Ironwood. Todo esto se apoya, además, en TPUDirect Storage, que reduce los “hops” mediados por CPU al cargar datos y baja notablemente las pod-hours necesarias por época de entrenamiento.

Especificaciones de TPU 8i: el cerebro para la inferencia y el razonamiento

Si la 8t es fuerza bruta, la TPU 8i es cerebro y eficiencia. Este chip está orientado a tareas de razonamiento, agentes de IA y cargas de inferencia muy intensivas, donde la latencia importa incluso más que el throughput absoluto. Aquí Google ha priorizado la memoria y la velocidad de acceso por encima de la potencia teórica máxima.

Cada TPU 8i integra 288 GB de VRAM HBM (frente a los 192 GB típicos de generaciones previas), junto con 384 MB de SRAM on-chip, el triple que la generación anterior, y un ancho de banda de memoria que sube hasta 8.601 GB/s, alrededor de un 30 % más que en 8t. A cambio, la potencia bruta se queda en unos 10,1 PFLOPs FP4 por chip, algo menor que en la versión de entrenamiento.

La verdadera magia de TPU 8i se aprecia en los Superpods. Frente a los 256 chips por pod de Ironwood en 2025, la nueva generación permite escalar hasta 1.152 chips por superpod, multiplicando por 4,5 la capacidad. Eso se traduce en 11,6 EFLOPs en FP8 por pod, 9,8 veces más que los 1,2 EFLOPs que ofrecía la generación anterior.

En memoria agregada, cada superpod 8i alcanza cerca de 331,8 TB de HBM, comparados con los 49,2 TB de antes. Y, de nuevo, el ancho de banda entre chips por pod llega a 19,2 TB/s, duplicando los valores previos. Este exceso de memoria por pod encaja de maravilla con modelos de contexto largo y sistemas multimodales que necesitan manejar millones de tokens en una sola conversación.

La topología de red interna, llamada Boardfly y desarrollada en colaboración con el equipo de Google DeepMind, reduce drásticamente el diámetro de la red y, con ello, la latencia de comunicación interna. El resultado son hasta 5 veces menos latencia efectiva en sampling de LLM en tiempo real, algo clave para agentes que necesitan razonar, ejecutar herramientas y responder al usuario casi de inmediato.

Mejoras de red, memoria y eficiencia energética en TPU v8

Más allá del cómputo bruto, las TPU v8t y v8i representan un salto claro en todo lo que tiene que ver con la red de interconexión y la jerarquía de memoria, que al final son los verdaderos cuellos de botella en modelos de frontera.

En red, Google ha pasado de enlaces de 100 Gb/s a 400 Gb/s en el centro de datos, es decir, un incremento del 300 % en ancho de banda en su red de interconexión. La latencia de red en inferencia se ha reducido alrededor de un 56 %, en parte gracias a una disminución equivalente en la distancia de enrutamiento, que baja de 16 saltos lógicos a unos 7 en las rutas críticas.

En memoria, la TPU 8i multiplica por tres la capacidad de SRAM en chip (+200 %), pasando de valores previos a esos 384 MB, lo que permite cachear más contextos, KV-caches y estructuras internas sin tocar HBM. En HBM, la 8i ve un aumento de capacidad del 50 % (de 192 GB a 288 GB), mientras que la 8t sube un 12,5 % (de 192 GB a 216 GB) pero con un enfoque en buen equilibrio entre coste y rendimiento.

En eficiencia, los datos son especialmente llamativos para quien paga la factura eléctrica. TPU 8t ofrece una ganancia de +124 % en rendimiento por vatio en entrenamiento y TPU 8i se apunta un +117 % en rendimiento por vatio en inferencia frente a Ironwood. Es decir, se dobla prácticamente la eficiencia energética mientras se multiplica el rendimiento total.

Este combo de más memoria, más ancho de banda y menos latencia se traduce en algo muy tangible: para un modelo como Gemini 3.1 Pro, desplegado hoy sobre TPU 8i, Google puede ofrecer APIs más baratas (alrededor de un 50 % menos de coste), más rápidas y con un manejo de contexto largo muchísimo mejorado, sin cambiar el modelo base.

Impacto en Gemini 3.1 y en los modelos del mañana

La llegada de TPU 8i y 8t no es un ejercicio académico, sino la base del roadmap real de modelos de Google. Para Gemini 3.1 Pro y sus sucesores inmediatos, la 8i significa servir más peticiones al mismo coste y con menor latencia, además de abrir la puerta a contextos de varios millones de tokens con una calidad estable.

De cara a los modelos de próxima generación, la TPU 8t es la pieza que elimina muchos de los cuellos de botella actuales. Gracias a su red Virgo, a la posibilidad de escalar hasta más de un millón de TPUs en un solo clúster y a los 121 EFLOPs por superpod, Google puede plantearse entrenar sistemas de IA profundamente multimodales con billones de parámetros sin que las horas de pod se disparen a niveles inasumibles.

Esto tiene consecuencias directas para cualquiera que use productos como Gemini Enterprise: sin tocar una línea de código, las mejoras de 8i se heredan automáticamente en el plano de servicio. El “techo” de complejidad y tamaño de modelo que se puede poner en producción sube varios peldaños durante el ciclo 2026-2027.

Ahora bien, también hay limitaciones. La disponibilidad general (GA) de estas TPU v8 está prevista para finales de 2026, y muchos de los benchmarks que se han publicado hasta ahora son números auto-reportados por Google. Harán falta uno o dos trimestres de uso real por parte de clientes tempranos para que aparezcan mediciones independientes y comparativas serias frente a GPU Blackwell, H200, MI300X o Gaudi3.

Amin Vahdat, SVP de Google para IA e infraestructura, ya ha adelantado dos tendencias claras: un resurgimiento de las CPUs de propósito general como capa de orquestación para sandboxes de agentes y ejecución de herramientas, y una especialización aún mayor del hardware de IA. Donde ahora tenemos dos chips (entrenamiento e inferencia), en el futuro podríamos ver más variantes afinadas a tipos de modelo o patrones de uso muy concretos.

TPU v8 frente a NVIDIA y otros competidores en 2026

La realidad del mercado es que NVIDIA sigue dominando con mano de hierro el segmento de aceleradores de IA, con una cuota cercana al 90 % en 2025. Sin embargo, eso no significa que juegue sola. Google produce millones de TPUs Ironwood (v7) y tiene acuerdos que reservan más de un millón de unidades para partners como Anthropic a partir de 2026.

Ironwood ya plantó cara a NVIDIA Blackwell: cada chip ofrece unos 4,6 PFLOPs FP8, ligeramente por encima de los 4,5 PFLOPs FP8 del B200, con 192 GB de HBM3e y un TDP de 600 W. Frente a generaciones previas, Ironwood multiplica por 10 el rendimiento de TPU v5p y por 4 la eficiencia frente a Trillium (TPU v6e), que ya rondaba los 918 TFLOPs por chip.

En inferencia, Google asegura recortes de en torno al 30 % en coste de servicio cuando se usa vLLM sobre TPU frente a despliegues equivalentes en GPU, y las TPU v8 vienen a reforzar aún más esa diferencia estructural. Mientras el resto del sector paga la ‘Nvidia tax’, Google vende capacidad basada en chips que ha diseñado a medida para sus cargas de trabajo.

Eso no significa que el resto se quede quieto. AMD empuja con MI300X, que ofrece un rendimiento cercano al 70 % del de NVIDIA a menor coste; Intel con Gaudi3 apuesta por recortar hasta un 40 % el coste de entrenamiento frente a GPUs Nvidia; AWS juega con Trainium e Inferentia para ofrecer reducciones de coste de hasta el 50 % en inferencia frente a A100. Incluso MediaTek prepara sus propios chips de inferencia económicos en nodos avanzados para 2027.

En este ecosistema, la jugada de Google con TPU v8 le sitúa en un punto particular: no busca vender chips al resto del mundo, sino cerrar el círculo de su propia nube y hacer que entrenar o servir en Google Cloud resulte tan atractivo en coste y latencia que la dependencia de NVIDIA deje de ser asumible para muchos.

Qué supone TPU v8 para tu startup o empresa

Si estás montando una startup de IA o escalando un producto existente, las TPU v8t y 8i no son solo “tecnología bonita de Google”: marcan cuánto te va a costar competir. El punto clave es que, a igualdad de presupuesto, puedes entrenar modelos más grandes o servir más usuarios si aprovechas una arquitectura con mejor rendimiento por dólar.

Para entrenamiento de modelos propios, lo que te interesa es la disponibilidad de TPU 8t, el acceso a la red Virgo y los acuerdos de SLA que te ofrezca Google en cuanto a goodput (no solo EFLOPs teóricos). Lo inteligente es comparar coste por token entrenado frente a alternativas con H200 o Blackwell y valorar cuánto repercute en tu roadmap.

Para inferencia y agentes en producción, merece la pena probar TPU 8i en Vertex AI o a través de stacks como vLLM, midiendo latencia real y coste por millón de tokens frente a tu infraestructura actual. Ahí influyen factores como el tamaño de la ventana de contexto, el tipo de modelo y el tráfico que esperas, pero la gran capacidad de HBM por pod juega a favor de contextos largos y modelos multimodales.

Si consumes servicios tipo Gemini Enterprise, las mejoras de 8i llegarán “de serie”. Tu límite ya no lo marcará tanto el hardware como el diseño de tu producto, la experiencia de usuario y cómo integres razonamiento, herramientas externas y contexto empresarial.

En regiones como España y Latinoamérica, donde el coste de capital es más ajustado, el acceso a TPUs vía Google Cloud (por ejemplo, en regiones como Madrid o Santiago) permite esquivar la compra directa de GPUs on-prem. Las proyecciones apuntan a una adopción de infraestructura no-NVIDIA de en torno al 20 % en LATAM a medio plazo, con ahorros que pueden ir del 50 al 70 % frente a levantar tu propio clúster de GPUs.

Limitaciones reales y puntos a vigilar en TPU v8

Por muy espectacular que sea la ficha técnica de TPU v8, no conviene autoengañarse: hay limitaciones prácticas y costes de fricción que debes tener en cuenta antes de casarte con esta plataforma para varios años.

Lo primero es el calendario: la disponibilidad general de TPU 8t y 8i está prevista para finales de 2026. Es decir, de momento estamos hablando de acceso anticipado, despliegues internos de Google y clientes muy seleccionados con contratos a largo plazo. Si necesitas capacidad mañana mismo, tendrás que mirar a Ironwood, Trillium o a GPUs ya en el mercado.

Lo segundo es la portabilidad. El ecosistema CUDA de NVIDIA lleva más de 15 años madurando, con una cantidad brutal de librerías, ejemplos, herramientas y talento disponible. Migrar a JAX/XLA o PyTorch/XLA no es gratis: hay código que reescribir, kernels que adaptar y equipos que formar. Para contratos multi-anuales, esa fricción pesa en la decisión.

Además, buena parte de los números de rendimiento de Google son auto-reportados y medidos en condiciones de laboratorio muy favorables. Hará falta ver benchmarks independientes en MLPerf y experiencias de early adopters para entender cómo se comportan realmente las TPU v8 bajo cargas mixtas, con pipelines de datos reales y modelos llenos de pequeñas rarezas.

Aun con todo, el mensaje estratégico es claro: la carrera de cómputo de frontera ya no va solo de quién compra más H100, sino de quién controla más capas del stack. Ahora mismo, esa lista corta de compañías con control vertical real se reduce, fundamentalmente, a dos nombres: Google y NVIDIA. Y en ese pulso, las TPU v8 son la apuesta más agresiva que hemos visto de Google hasta la fecha.

En conjunto, las TPU 8t y 8i dibujan un escenario en el que el hardware deja de ser un cuello de botella inevitable y se convierte en una palanca estratégica: más memoria HBM por pod, redes que escalan a cientos de miles o millones de chips, latencias recortadas a la mitad y costes por token que se desploman cuando aprovechas la especialización. Para cualquier empresa hispanohablante que quiera jugar en ligas de IA avanzada, entender bien lo que ofrece Google con TPU v8 puede marcar la diferencia entre escalar con cabeza o quedarse atrapada pagando la ‘Nvidia tax’ durante años.