- Identificar cuellos de botella exige observar el comportamiento real del sistema, no solo porcentajes de uso o benchmarks sintéticos.

- Los puntos críticos pueden estar en hardware, procesos, red, bases de datos o flujo de información, y rara vez son evidentes a primera vista.

- La combinación de monitorización, métricas específicas y análisis de procesos permite localizar causas estructurales y no solo síntomas.

- Una vez detectado el cuello de botella, se pueden aplicar mejoras focalizadas en arquitectura, configuración o diseño del flujo para recuperar rendimiento.

Si alguna vez has notado que tu PC, tu red o incluso los procesos internos de tu empresa van más lentos de lo que deberían, es muy posible que estés sufriendo uno o varios cuellos de botella ocultos que no se ven en un simple gráfico de uso al 100%. No siempre basta con abrir el administrador de tareas o lanzar un benchmark sintético para entender qué está pasando: muchas veces, lo que limita el rendimiento real está en otro punto del sistema.

En el mundo del hardware, de las operaciones empresariales, de las redes y del software, el concepto es el mismo: el rendimiento global solo es tan rápido como su eslabón más lento, aunque ese eslabón no sea tan evidente a primera vista. Por eso, aprender a detectar cuellos de botella sin depender únicamente de benchmarks sintéticos es clave para no tirar el dinero en ampliaciones innecesarias, elegir bien el hardware o rediseñar procesos con cabeza.

Qué es realmente un cuello de botella (y por qué se malinterpreta tanto)

En el entorno del PC se ha popularizado la idea de que un cuello de botella es sinónimo directo de que algo va mal en tu equipo, pero la realidad es bastante más matizada. Un cuello de botella es, simplemente, la situación en la que uno de los componentes o recursos de un sistema limita a los demás porque su capacidad efectiva es inferior a la demanda que recibe. No es necesariamente un fallo ni un error de configuración, sino muchas veces el resultado de un desequilibrio en el diseño o en la elección de componentes.

Esto no pasa solo en hardware doméstico. En operaciones empresariales, intralogística, sistemas TI o bases de datos, aparece el mismo patrón: un único recurso, proceso o decisión se convierte en el punto donde todo se ralentiza. Puede ser un servidor saturado, una tabla SQL mal indexada, una persona que centraliza demasiadas validaciones o un tramo de red con menos capacidad de la necesaria.

La confusión viene porque solemos fijarnos en el sitio visible donde «se atasca» todo, cuando el verdadero cuello de botella puede estar varios pasos antes o después en el flujo. En un juego, parece que es la GPU la que va justa; en realidad, quizá es la CPU la que no alimenta suficientes instrucciones, o el disco lento que tarda en cargar datos. En una empresa, parece cosa del ERP; tal vez el problema esté en cómo se comparte la información entre departamentos.

Por qué los benchmarks sintéticos engañan (y qué mirar en su lugar)

Cuando intentas averiguar si hay un cuello de botella en tu PC o en tu aplicación, tirar de benchmarks sintéticos es la reacción automática de casi todo el mundo. Pruebas de CPU, tests de GPU, benchmarks de disco… te dan una cifra bonita y comparable, pero no describen bien cómo se comporta el sistema en tus tareas reales: tu juego habitual, tu editor de vídeo, tu aplicación de negocio o tu servicio web en producción.

Además, fiarse solo del porcentaje de uso de CPU o GPU es una trampa muy habitual. Ver la gráfica de la GPU al 100% y la CPU al 60% no significa que la gráfica esté «atascando» nada: puede ser justo lo deseable en un juego donde la carga gráfica es la protagonista y el procesador no necesita dar más de sí. Lo contrario también ocurre: CPU al 100% y GPU relajada sin que haya un problema de configuración, simplemente porque la lógica del juego o de la aplicación es muy dependiente del procesador.

En lugar de quedarte con ese dato superficial, lo que funciona mejor es analizar el comportamiento conjunto del sistema en situaciones reales con una monitorización local. En el caso del gaming, indicadores como caídas bruscas de FPS, tiempos de frame irregulares o microtirones en escenas concretas son síntomas mucho más fiables de que hay un componente que no está acompañando al resto. En aplicaciones de negocio, el equivalente son tiempos de respuesta impredecibles, esperas que se disparan en ciertos picos de carga o procesos que se quedan “pensando” sin razón aparente.

Esto mismo se aplica a cualquier entorno donde quieras detectar cuellos de botella sin depender de pruebas artificiales: lo que importa no es lo que tu sistema hace en un benchmark idealizado, sino cómo responde bajo el trabajo real, con sus datos, sus usuarios y sus particularidades. Los benchmarks pueden servir de referencia, pero nunca deberían ser la única fuente de diagnóstico.

Cuellos de botella en un PC: más allá del uso de CPU y GPU

En un equipo de sobremesa o portátil, cuando se habla de cuellos de botella normalmente se señala a la pareja CPU-GPU como los grandes sospechosos. Es cierto que una CPU muy antigua con una tarjeta gráfica muy potente puede limitar claramente el rendimiento en juegos o en render, y también al revés, pero reducirlo todo a ese binomio es simplificar demasiado.

Hay que tener claro que no existe la combinación «perfecta» que nunca genere ningún tipo de cuello de botella. Dependiendo de lo que hagas, el limitante cambiará: en juegos muy dependientes de CPU notarás antes el procesador; en títulos muy pesados gráficamente, será la GPU; en edición de vídeo con muchos clips en 4K y discos lentos, se notará el almacenamiento; en cargas pesadas multitarea, la RAM. Lo importante es reconocer cuándo el componente que limita el sistema está frenando tareas que realmente te importan.

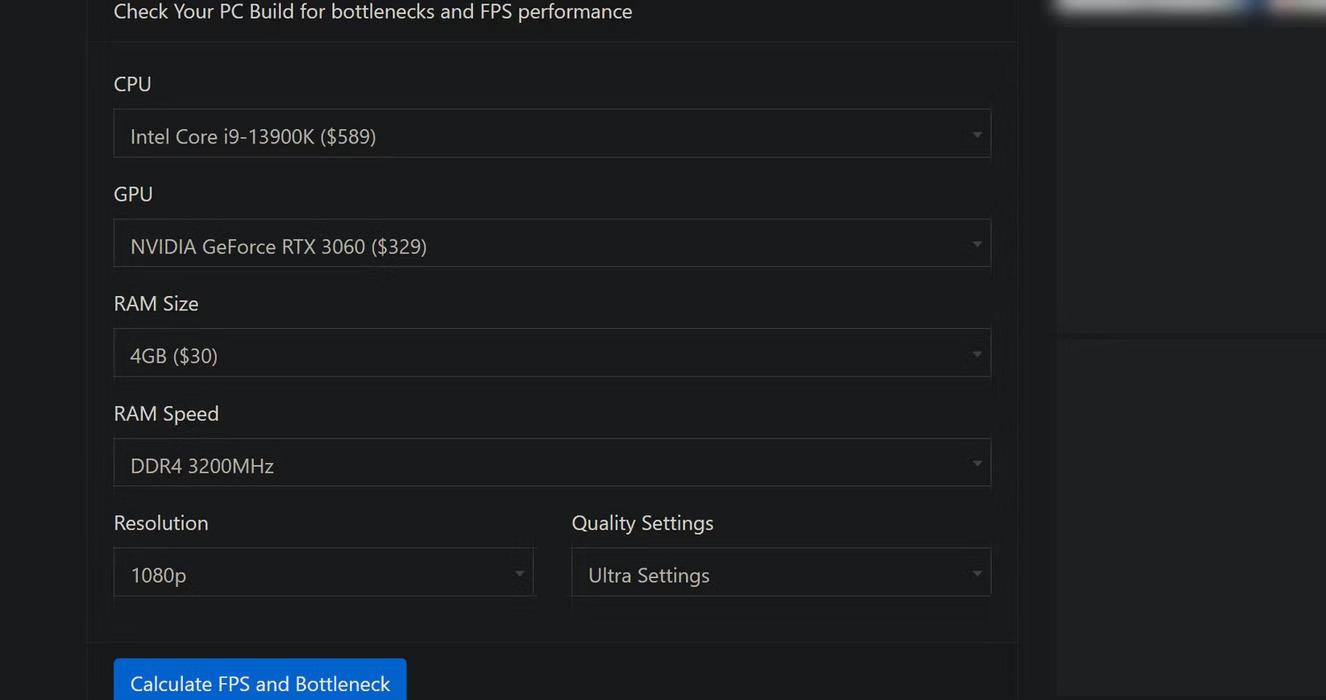

Por eso muchas calculadoras online de cuello de botella, que prometen decirte si tu combinación de CPU y GPU es «equilibrada», son como poco orientativas y poco más. Se basan en medias y supuestos genéricos, pero no tienen en cuenta factores clave como la resolución a la que juegas, la configuración gráfica, el tipo de juegos o el motor concreto de cada título. Tampoco consideran la arquitectura de tu tarjeta, la velocidad de tu RAM o la calidad del disipador si el procesador hace thermal throttling.

Una forma mucho más razonable de evaluar cuellos de botella sin benchmarks sintéticos es monitorizar metrics de frame time y estabilidad de FPS mientras juegas o trabajas. Herramientas como Riva Tuner Statistics Server (RTSS) permiten ver cómo se comporta el tiempo de cada frame: si hay picos frecuentes y tirones, probablemente algo está limitando. Si por el contrario los FPS son estables y la experiencia es fluida, tener la GPU al 99% no es un problema, sino un buen aprovechamiento de recursos.

También hay que recordar que el cuello de botella a veces no está ni en CPU ni en GPU, sino en la RAM o en el dispositivo de almacenamiento. Una cantidad insuficiente de memoria, módulos muy lentos o un disco duro mecánico en lugar de un SSD pueden provocar cargas eternas, stuttering al cambiar de zona en un juego o pequeñas pausas mientras la aplicación tira de disco constantemente.

Elegir hardware equilibrado y evitar la obsesión por el cuello de botella

A la hora de montar o actualizar un PC, el objetivo no debería ser tener todos los componentes siempre al 100%, sino lograr un equilibrio sensato entre lo que haces, lo que necesitas y lo que inviertes. Gastarse más de mil euros en una gráfica de gama muy alta y acompañarla de un procesador de entrada o de memoria muy lenta es una receta casi segura para un sistema desequilibrado.

Del mismo modo, comprar un procesador de gama alta para luego solo jugar a títulos eSports poco exigentes o tareas ofimáticas es desaprovechar claramente el presupuesto. Antes de pensar en cambiar hardware por miedo a un posible cuello de botella, conviene pararse a evaluar qué te está limitando de verdad en el día a día: ¿FPS bajos? ¿Tiempos largos de compilación? ¿Proyectos de edición de vídeo que tardan demasiado en exportar? ¿Apertura de aplicaciones desesperantemente lenta?

Hay que tener presente también que un cierto grado de cuello de botella es totalmente normal e incluso saludable. Un sistema donde la GPU va a tope y la CPU trabaja sobrada puede ser más silencioso, consumir menos y resultar más estable que otro en el que ambos componentes están permanentemente al límite. Forzar siempre el equilibrio perfecto es, en la práctica, casi imposible y tampoco aporta una mejora perceptible en la mayoría de casos.

En la experiencia de uso real, la mayoría de personas no va a notar diferencia entre jugar a 150 FPS estables y 240 FPS, sobre todo si el monitor no acompaña. Perseguir esa mejora marginal gastando grandes cantidades de dinero, solo para eliminar un «cuello de botella teórico», no suele ser la mejor estrategia. Es más útil detectar los cuellos de botella que realmente afectan a tu experiencia y, solo entonces, plantearse una actualización.

Al final, la clave está en entender bien qué hace cada componente en tus tareas concretas y valorar si el rendimiento actual cumple con tus expectativas o si hay un freno real que merece la pena resolver. A partir de ahí, sí tiene sentido pensar en cambios de CPU, más RAM, un SSD más rápido o incluso ajustes de configuración que alivien el componente más exigido.

A la hora de montar o actualizar un PC, valora primero el equilibrio entre tus necesidades y presupuesto antes de buscar eliminar un cuello de botella teórico.

Cuellos de botella en operaciones y procesos empresariales

En el ámbito de la gestión empresarial y la operativa diaria, pasa algo muy parecido a lo que sucede en un PC: no todo problema de funcionamiento se soluciona cambiando de herramienta o implantando un nuevo ERP. Muchas organizaciones, cuando sienten que su operación «no da más de sí», culpan directamente al sistema y miran hacia un reemplazo tecnológico, sin revisar antes la estructura de sus procesos.

Lo habitual es que el cuello de botella no esté en la aplicación en sí, sino en cómo fluye la información, cómo se toman las decisiones y cómo se conectan las distintas áreas. Se refuerza un departamento concreto, se añaden más controles, se ajustan calendarios… pero los retrasos, las urgencias y las acumulaciones vuelven a aparecer una y otra vez en el mismo punto del flujo.

Este tipo de cuellos de botella operativos se manifiestan con señales bastante reconocibles: retrasos constantes en un tramo concreto del proceso aunque el volumen cambie, dependencia exagerada de ciertas personas clave o sobrecarga administrativa con tareas manuales y conciliaciones repetitivas. También es muy típico que las decisiones importantes lleguen siempre tarde, cuando el impacto ya es visible en plazos, costes o calidad.

En muchos casos, el verdadero cuello de botella es la información: datos que no se comparten, que llegan fragmentados o que no están actualizados cuando se necesitan. Producción trabaja con sus propios informes, compras con otros, logística con los suyos y finanzas con una visión distinta. Sin un marco común y en tiempo casi real, es imposible anticipar los problemas: solo se gestionan cuando ya han estallado.

Por eso, antes de plantearse cambiar de ERP o de plataforma, tiene sentido analizar con rigor el proceso de extremo a extremo: dónde se genera la fricción, en qué momentos falta visibilidad y qué partes dependen demasiado de intervención manual. A menudo se descubre que el sistema actual podría dar más de sí si se unificaran criterios, se conectaran mejor los módulos o se revisara el flujo de trabajo entre áreas.

El papel de la arquitectura del sistema y las soluciones integradas

Hay ocasiones en las que, tras hacer ese ejercicio de análisis de procesos y de flujo de información, la conclusión no es «estamos usando mal la herramienta», sino algo más profundo: la arquitectura del sistema ya no permite integrar áreas, automatizar flujos clave ni ofrecer información en tiempo real de forma razonable. En ese punto, el cuello de botella deja de ser solo operativo y pasa a ser estructural.

Si el sistema actual imposibilita una trazabilidad clara, complica la conexión entre operación y finanzas o no escala al ritmo de la empresa, llega un momento en que es la propia plataforma la que está frenando el crecimiento. No se trata solo de comodidad, sino de un límite real a la capacidad de tomar decisiones informadas y a tiempo.

En escenarios así, cobran sentido soluciones integradas que unifiquen información de compras, ventas, producción, almacén y contabilidad en un mismo entorno. Plataformas como Microsoft Dynamics 365 Business Central, por ejemplo, se diseñan para orquestar esos datos en coherencia y reducir la desconexión que a menudo aparece entre módulos aislados o herramientas de distinta procedencia.

Ahora bien, incluso en estos casos, el paso previo siempre debería ser un análisis metódico de dónde está el cuello de botella y qué necesidades reales no cubre la arquitectura actual. Cambiar de sistema sin haber entendido bien la raíz del problema solo traslada la fricción a un entorno nuevo, con el coste añadido de la implantación.

Las consultoras especializadas en optimizar operaciones suelen empezar por ahí: mapear el proceso real (no el que está en los manuales), identificar los puntos de mayor fricción y definir si es más eficiente optimizar lo que ya existe o dar el salto a una arquitectura más integrada. Solo con un diagnóstico bien hecho la decisión tecnológica pasa de ser una reacción impulsiva a formar parte de una estrategia clara.

Cuellos de botella intralogísticos: cuando el flujo físico se atasca

En intralogística, la idea de cuello de botella se ve de forma muy gráfica: la planta es un gran flujo de materiales que debería moverse con ritmo constante y sin interrupciones. Cuando algo se rompe en ese flujo, aparecen esperas, acumulaciones, rutas cruzadas y, en definitiva, caídas importantes de productividad.

Aunque haya robots, sistemas automáticos, AMRs y software en tiempo real, un único punto físico mal dimensionado, un proceso manual mal colocado o un sistema que no habla con otro pueden convertirse en el embudo que lo ralentiza todo. A veces es una simple puerta mal ubicada, a veces una validación que depende de una sola persona y otras, un Excel perdido que decide la secuencia de producción.

Lo curioso es que, igual que en otros entornos, el cuello de botella intralogístico no siempre está donde se detiene el flujo de forma visible. Puede estar en un tramo de transporte con demasiados cruces, en un buffer insuficiente que no absorbe variaciones o en una regla de negocio en el MES que frena la liberación de órdenes.

Para detectarlos sin parar la planta, suele funcionar muy bien una aproximación sencilla pero sistemática: observar el flujo, escuchar a quienes trabajan en él y mapear con detalle los tiempos de ciclo, de espera y de transporte. Herramientas como el mapeo de flujo de valor (VSM) ayudan a visualizar dónde se concentran los desperdicios y las esperas que no aportan valor.

También es útil comparar tiempos reales de paso por cada estación con el takt time objetivo, revisar los registros del sistema MES en busca de zonas con excesivo dwell time y dedicar tiempo a hablar con los operarios: suelen saber mejor que nadie en qué punto se atasca siempre la jornada, aunque no lo llamen con palabras de manual.

Diseñar el flujo para que no aparezcan nuevos cuellos de botella

Identificar un cuello de botella intralogístico es importante, pero la gran diferencia en rendimiento la marcan las plantas que diseñan su flujo para minimizar la aparición de embudos futuros. Muchas veces, el embudo no es un accidente, sino el resultado directo del layout, de la ubicación de los buffers o de la forma en que se han encadenado las estaciones de trabajo.

En las fases de ingeniería y planificación conviene visualizar el recorrido completo del material, no solo los tramos automatizados. Cada punto de espera, cada validación manual y cada paso de información debería tener una razón clara de existir y un lugar lógico en la secuencia. Si se deja al azar, lo más probable es que los problemas aparezcan cuando ya es caro corregirlos.

Las herramientas de simulación 3D o de eventos discretos permiten probar diferentes escenarios (picos de producción, cambios de referencia, turnos adicionales) sin tocar todavía el hardware real. En esas simulaciones es donde suelen aflorar los cuellos de botella que, de otro modo, solo se verían cuando la planta ya está funcionando.

Un diseño robusto también incorpora buffers calculados con criterio, que no son un síntoma de ineficiencia sino un seguro para absorber las variaciones inevitables. Bien dimensionados, evitan que pequeñas interrupciones se conviertan en paradas en cadena. Además, es fundamental pensar desde el inicio en cómo se comunican los sistemas digitales (ERP, MES, WMS) para que los datos fluyan con la misma coherencia que las piezas.

Empresas de intralogística que trabajan con este enfoque suelen dar prioridad a la simplicidad mecánica y a la visibilidad del flujo: cuanto más claro es el movimiento del material y más fácil es ver los atascos, más sencillo es corregirlos a tiempo. Un buen sistema no tiene que correr más, simplemente debe moverse de forma más fluida.

Cuellos de botella en TI, redes y bases de datos

En el terreno de las TI, los cuellos de botella tienen un impacto directo en la experiencia de usuario y en la continuidad del negocio: latencias altas, aplicaciones lentas o servicios que se caen en horas punta suelen ser la punta del iceberg. El problema de fondo acostumbra a estar en recursos infra dimensionados, configuraciones poco optimizadas o cargas mal repartidas.

En un sistema TI típico, los cuellos de botella más frecuentes aparecen en CPU, memoria, disco, red, bases de datos y balanceo de servicios. Una CPU saturada durante largos periodos dispara el tiempo de respuesta de las aplicaciones; una RAM escasa obliga a paginar en disco; un almacenamiento lento hace que accesos a datos masivos tarden demasiado; una red congestionada genera pérdidas de paquetes y latencias; y una base de datos mal indexada convierte consultas sencillas en operaciones eternas.

Para detectarlos sin limitarse a herramientas de benchmark sintético, la clave está en desplegar una monitorización proactiva con métricas relevantes a nivel de sistema y de aplicación, usando herramientas como btop para monitorizar en Linux. Herramientas como Zabbix o Nagios permiten ver cargas de CPU y procesos que consumen recursos en exceso; Elastic Stack o Datadog ayudan a analizar patrones de uso de memoria; Wireshark o PRTG Network Monitor destapan problemas de red; y soluciones como iostat, perfmon o New Relic aportan visibilidad sobre I/O de disco y rendimiento de consultas SQL.

En el contexto concreto de SQL Server o Azure SQL, Microsoft señala cinco áreas críticas donde los cuellos de botella son muy habituales: uso de memoria, uso de CPU, E/S de disco, número de conexiones de usuario y bloqueos por candados. Una memoria insuficiente obliga a leer desde disco en lugar de aprovechar la caché; una CPU al límite indica consultas poco eficientes o necesidad de más capacidad; una E/S de disco muy alta puede reducirse con mejores índices y planes de ejecución; demasiadas conexiones simultáneas degradan el rendimiento; y bloqueos mal gestionados alargan los tiempos de transacción.

Una vez identificados los puntos calientes, entran en juego estrategias como escalar vertical u horizontalmente los recursos, optimizar código y consultas, introducir cachés y aplicar un buen balanceo de carga. A veces la solución es tan simple como pasar de un disco mecánico a un SSD rápido; otras, implica reescribir partes de la lógica de negocio o rediseñar el modo en que la aplicación interactúa con la base de datos.

También en redes empresariales la analogía de la carretera ayuda a visualizar el cuello de botella: si un tramo tiene menos carriles o está en mal estado, todo el tráfico se ralentiza. Ancho de banda insuficiente, routers y switches obsoletos, configuraciones erróneas, dispositivos que acaparan recursos o interferencias Wi-Fi son causas frecuentes de congestión. Con herramientas de monitorización de tráfico se puede localizar el punto exacto donde la red «se estrecha» y aplicar soluciones como aumentar capacidad, actualizar hardware, ajustar QoS o reorganizar la topología.

Detectar cuellos de botella en aplicaciones complejas sin pruebas unitarias

En el desarrollo de software, especialmente en aplicaciones heredadas muy grandes donde nadie pensó en pruebas unitarias ni métricas desde el principio, encontrar dónde se atasca el rendimiento puede parecer una misión imposible. Reescribir el sistema no es realista y los benchmarks sintéticos no reflejan lo que ocurre en producción.

En estos casos, la mejor aproximación es instrumentar progresivamente la aplicación con mediciones de tiempos y consumo de recursos en puntos clave. Si sabes que una consulta con Entity Framework tarda demasiado o que cierto cálculo dispara el uso de CPU y RAM, puedes introducir registros temporales de duración, usar perfiles de rendimiento o recurrir a herramientas de APM (Application Performance Monitoring) que muestren qué métodos y qué consultas se llevan más tiempo en cada petición.

La idea es pasar de «el programa va lento» a saber con precisión qué parte del flujo, qué método o qué consulta concreta está provocando la espera. A partir de ahí, se abren opciones como refactorizar esa sección, mover parte del cálculo a SQL (por ejemplo, usando vistas en lugar de consultas muy complejas desde EF), cachear resultados costosos o paralelizar ciertas operaciones si el entorno lo permite.

Incluso sin una batería completa de tests automatizados, es posible construir de forma gradual un conjunto de métricas y pruebas de rendimiento focalizadas en los puntos más problemáticos. No hace falta medirlo todo desde el primer día: basta con empezar por las rutas de código que afectan directamente a la experiencia de usuario o al tiempo de respuesta de las operaciones críticas.

Con el tiempo, ese esfuerzo de instrumentación y medición va dibujando un mapa bastante fiel de dónde están realmente los cuellos de botella en la aplicación, más allá de las sospechas iniciales o de lo que indiquen las simples cifras de CPU y RAM en el servidor.

Al final, tanto en un PC doméstico como en operaciones empresariales, intralogística, redes, bases de datos o aplicaciones heredadas, la clave para detectar cuellos de botella sin depender solo de benchmarks sintéticos es observar el comportamiento real del sistema, medir lo que de verdad importa y relacionar los síntomas visibles con las causas estructurales que los provocan. Cuando se hace ese ejercicio con método y datos, las decisiones de mejora dejan de ser un acto de fe y se convierten en cambios concretos que devuelven fluidez al flujo, ya sea de frames, de datos, de piezas o de información.