- La telemetría local permite monitorizar PC e infraestructura en tiempo real manteniendo todos los datos dentro de tu red.

- Existen potentes soluciones open source y comerciales on-premise para crear dashboards avanzados y alertas inteligentes.

- Combinar monitorización con y sin agente ofrece el equilibrio ideal entre detalle de métricas y facilidad de despliegue.

- Una buena estrategia de telemetría local mejora rendimiento, seguridad, cumplimiento y puede apoyarse en hardware más sostenible.

Si te mola ver cómo va tu ordenador casi como si fuera un coche de Fórmula 1, con sus relojes y gráficas por todas partes, lo que necesitas es un dashboard de telemetría local para PC totalmente bajo tu control. Nada de mandar datos al nube porque sí, nada de depender de servicios externos que un día cambian las condiciones o cierran. Hablamos de montar tu propio panel, con métricas en tiempo real de CPU, RAM, disco, red, temperatura y mucho más, todo quedándose en tu máquina o en tu red local y pudiendo detectar si un antivirus está afectando al rendimiento del PC.

Este enfoque no es solo cosa de frikis del hardware: cada vez más usuarios domésticos, gamers, pequeñas empresas y equipos IT quieren monitorizar sus PCs y servidores con el mismo nivel de detalle que una gran empresa, pero manteniendo la telemetría en local. Vamos a ver qué es exactamente la telemetría local, qué se puede vigilar, qué herramientas existen (open source y comerciales), cómo plantear las alertas inteligentes y qué implicaciones tiene a nivel de privacidad y seguridad.

Qué es un dashboard de telemetría local para PC y por qué interesa

Cuando hablamos de telemetría en tiempo real nos referimos a la recogida, procesamiento y visualización de métricas del sistema en cuestión de segundos: carga de CPU, uso de memoria, espacio de disco, latencia de red, errores de aplicaciones, temperaturas, procesos activos… Un dashboard es la pantalla donde todo eso se organiza en gráficos, tablas e indicadores para que puedas ver de un vistazo qué está pasando.

La clave de que sea local es que tanto los datos como el servidor que los gestiona residen en tu propio PC o en tu LAN. Nada de enviar métricas a un SaaS externo si no quieres: instalas los agentes o sondas en tus equipos, montas el servidor de monitorización en una máquina que controles (puede ser un PC con Windows, Linux, macOS, un NAS o un pequeño servidor) y accedes al dashboard desde el navegador o desde una app de escritorio.

Este modelo se utiliza desde hace años en entornos profesionales para mantenimiento preventivo, respuesta rápida a incidentes y cumplimiento normativo. A una escala más humilde, en casa o en una pequeña oficina, la lógica es la misma: quieres saber si tu PC-servidor está a punto de petar por falta de disco, si se está calentando de más o si un servicio crítico se ha caído sin que nadie se haya enterado todavía.

Frente a los servicios en la nube, donde tus métricas viajan a servidores de terceros, se almacenan allí y se visualizan desde su interfaz, con un dashboard local todo el ciclo de vida de la métrica se queda bajo tu infraestructura. Esto reduce la superficie de ataque, evita dependencias externas y encaja muy bien con entornos que tienen requisitos fuertes de privacidad. En PCs con Windows es muy recomendable combinarlo con buenas prácticas de endurecimiento de la telemetría del sistema operativo para limitar lo que sale hacia fuera.

Incluso en el mundo gaming se nota esta necesidad. Usuarios de consola como PS5 comentan que, mientras en PC existen herramientas tipo SIM Hub, ellos recurren a apps como SIM Dashboard para reutilizar móviles o tablets antiguos como pantallas auxiliares. En PC podemos ir más allá y montar dashboards de telemetría muy completos que aprovechan datos avanzados del sistema y del hardware, no solo lo básico del HUD del propio juego.

Qué puedes vigilar con un dashboard de telemetría local

Un buen dashboard de telemetría local no se limita al típico gráfico de CPU. Lo interesante es tener una visión estructurada y en tiempo real de los recursos críticos del equipo y, si quieres, de otros dispositivos de la red y, si es necesario, saber cómo activar la caché de escritura en discos externos. En un PC que hace de servidor casero, por ejemplo, lo mínimo razonable sería poder ver de un vistazo:

- Uso de CPU por núcleo y a nivel global, con medias y picos.

- Memoria RAM total, en uso, disponible y buffers/caché.

- Espacio de disco por volumen, porcentaje de ocupación y tasa de lectura/escritura.

- Tráfico de red por interfaz, velocidad de subida y bajada, errores y paquetes descartados.

- Temperaturas de CPU, GPU, discos y placa base (si el hardware las expone correctamente).

- Procesos más pesados en CPU, memoria o disco, para cazar de un vistazo cualquier proceso loco.

- Estado de servicios clave como servidor web, base de datos, compartición de archivos, VPN, etc.

En un entorno más grande (red corporativa, CPD, laboratorio), el mismo concepto se amplía a routers, switches, cortafuegos, máquinas virtuales, contenedores, bases de datos, APIs y aplicaciones de negocio y mecanismos para priorizar el tráfico de aplicaciones. El objetivo es el mismo: métricas frecuentes, paneles claros y alertas inteligentes cuando algo se dispara por encima o por debajo de lo normal.

Un dashboard realmente útil combina la vista de “radar” en tiempo real con una perspectiva histórica de horas, días o meses. Eso te permite detectar tendencias, cuello de botella recurrentes, degradación de hardware (discos que empiezan a dar errores, por ejemplo) o necesidades futuras de capacidad. Sin esa parte histórica es fácil vivir apagando fuegos sin saber por qué se repiten.

En el ámbito doméstico, incluso con un solo PC puedes sacarle mucho partido: desde saber si un juego está limitado por CPU o GPU, hasta comprobar si un disco SSD se está quedando sin vida útil de un SSD. En una pyme, el mismo dashboard te puede permitir controlar servidores, cabinas de almacenamiento y enlaces de red sin soltar ni un dato crítico fuera de la oficina.

De un solo PC a toda la infraestructura: plataformas de monitorización en tiempo real

Cuando pasas de vigilar un único PC a controlar servidores, redes y aplicaciones completas, ya entras en el terreno de las plataformas de monitorización de infraestructura IT. Muchas de ellas permiten desplegar todo en local (on-premise), de forma que las métricas se guardan en tu propio CPD o en tus servidores físicos.

Estas plataformas detectan saturaciones de CPU, RAM o disco antes de que tiren abajo un servicio, identifican cuellos de botella en la red, descubren nodos de Kubernetes con problemas, vigilan tasas de error de microservicios o rendimiento de bases de datos. Además facilitan el cumplimiento normativo al registrar accesos, cambios y eventos sobre datos sensibles.

Desde el punto de vista económico, cada minuto de caída de un servicio puede significar pérdidas considerables. Por eso muchas empresas optan por soluciones de código abierto o comerciales que ofrezcan dashboards en tiempo real, alertas avanzadas y reporting detallado, pero con la posibilidad de mantener toda la telemetría de forma local cuando las políticas de la organización así lo exigen.

El abanico va desde un pequeño PC con Windows reconvertido en servidor casero, hasta plataformas on-premise para monitorizar redes completas, granjas de servidores, clústeres de contenedores o entornos híbridos que combinan local y nube. La filosofía, en cualquier escala, sigue siendo la misma: que el dashboard trabaje por ti 24/7 y te avise solo cuando hay algo que merece tu atención.

Ecosistema open source para montar dashboards de telemetría local

El mundo open source lleva años siendo la columna vertebral del monitoraje profesional. Su gran ventaja es doble: costo de licencia cero y flexibilidad total para desplegarlo todo en tu propia infraestructura. No estás obligado a subir nada a la nube si no quieres, y puedes adaptar las herramientas a tu entorno con total libertad.

Entre las soluciones más relevantes para montar dashboards de telemetría local (desde un único PC hasta cientos de servidores) destacan varios nombres clave que se complementan muy bien entre sí.

Prometheus: el motor de métricas de series temporales

Prometheus es un sistema de monitorización orientado a métricas numéricas en forma de series temporales etiquetadas. Su fuerte es recoger datos a intervalos cortos (por ejemplo, cada 10 o 30 segundos), almacenarlos de forma eficiente y permitir consultas muy potentes mediante su lenguaje PromQL.

Brilla especialmente en entornos modernos con contenedores, Kubernetes y servicios dinámicos, donde los “targets” aparecen y desaparecen constantemente y necesitas descubrimiento automático. A través de exporters puede recolectar datos de hardware, sistemas operativos, bases de datos, servicios web y un largo etcétera, manteniendo todo dentro de tu red interna sin exponer endpoints hacia fuera.

Su componente Alertmanager se encarga de la parte de avisos: defines reglas como “si el uso de disco en un volumen supera el 90 % durante 10 minutos, mándame un correo o dispara un aviso en el chat interno”, y Prometheus gestiona cuándo se dispara, a quién le llega y cómo se agrupan las notificaciones. Toda la arquitectura puede residir en tus servidores locales.

Grafana: el estándar de facto en dashboards

Grafana se ha convertido prácticamente en el estándar a la hora de visualizar métricas y construir dashboards personalizados. Se conecta a Prometheus y a muchas otras fuentes de datos (bases de datos de series temporales, SQL, servicios cloud, logs, etc.) y te permite crear paneles con todo tipo de gráficos: líneas, barras, histogramas, mapas de calor, mapas geográficos, indicadores de estado, etc.

Para un dashboard de telemetría local lo habitual es usar Prometheus como recolector de métricas y Grafana como capa de visualización y alertas. Lo despliegas en un servidor de tu red, le das acceso a tus fuentes internas y listo. Desde ahí puedes crear paneles para un solo PC o para toda la infraestructura, con variables, filtros y vistas adaptadas a cada equipo o servicio.

Grafana también permite configurar sus propias alertas basadas en consultas, enviando correos, mensajes a herramientas de mensajería interna o integrándose con sistemas de tickets, de nuevo sin necesidad de sacar datos a servicios de terceros si no quieres.

Zabbix: monitorización integral con muchos extras de serie

Zabbix es una plataforma open source de nivel empresarial que integra monitorización de red, servidores, aplicaciones, servicios en la nube y máquinas virtuales en un solo paquete. Funciona con un servidor central que recibe datos de agentes instalados en los equipos o mediante protocolos como SNMP, IPMI o chequeos simples TCP/HTTP.

Su interfaz web, que puedes alojar completamente en tu infraestructura, incluye un buen surtido de dashboards, mapas y plantillas predefinidas para un montón de dispositivos y servicios habituales. Además, ofrece un sistema de notificaciones flexible (correo, SMS, webhooks, etc.), políticas de escalado, integración con LDAP/AD y reporting de rendimiento y capacidad.

Si quieres un sistema que traiga mucha funcionalidad preparada desde el primer minuto y que escale desde un par de PCs hasta miles de hosts, Zabbix es una de las apuestas más sólidas en el terreno de la telemetría local avanzada.

Nagios e Icinga: veteranos muy maleables

Nagios es uno de los pioneros en monitorización de infraestructura. Su enfoque se basa en un núcleo relativamente pequeño que coordina una gran cantidad de plugins que chequean el estado de sistemas, servicios, protocolos de red y aplicaciones. La versión comercial (Nagios XI) facilita bastante la vida con asistentes gráficos, pero la versión libre sigue siendo muy popular por su ecosistema.

Icinga nació como una bifurcación de Nagios y ha evolucionado hacia una plataforma propia con interfaz web más moderna, módulos específicos para entornos como VMware vSphere y buen soporte para procesos de negocio. Mantiene compatibilidad con la mayoría de plugins de Nagios, por lo que hereda un catálogo enorme de chequeos listos para usar.

En ambos casos, la arquitectura está pensada para instalar el servidor de monitorización en máquinas que controlas tú y acceder a los dashboards vía web interna. Son soluciones muy configurables, ideales para quien quiere toquetear a fondo la lógica de alertas y personalización.

Netdata: obsesión por el tiempo real

Netdata está orientado a ofrecer telemetría extremadamente detallada segundo a segundo en cada sistema donde se instala. El agente corre en PCs, servidores o dispositivos Linux y expone un panel web con métricas al instante de CPU, memoria, E/S de disco, tráfico de red, procesos, contenedores y muchas más.

Es ideal para situaciones en las que necesitas reaccionar muy rápido ante cualquier anomalía: un pico de CPU, una subida repentina de latencia en disco, una interfaz de red saturada, etc. Su enfoque está menos centrado en el histórico profundo y más en la visibilidad inmediata, aunque también guarda datos suficientes para análisis a corto y medio plazo.

Para un PC que uses como servidor doméstico es muy práctico: puedes entrar al dashboard desde otro equipo de la red y ver al momento qué está pasando sin tener que conectar teclado, ratón y monitor o tirar de escritorio remoto continuamente.

Otros proyectos open source a tener en el radar

El panorama de herramientas libres se completa con muchas otras opciones que pueden encajar según tu caso de uso concreto. Entre ellas destacan:

- Riemann, orientado al procesamiento de eventos de baja latencia en sistemas distribuidos.

- Sensu, que se presenta como una plataforma de monitorización full-stack para servicios, aplicaciones y servidores.

- Cacti (a menudo mal escrito como “Cactus”), especializado en gráficas de red basadas en RRDtool.

- LibreNMS, Observium Community o Pandora FMS, centradas en monitorización de red con descubrimiento automático, SNMP y gestión avanzada de alertas.

- Herramientas como LogRhythm NetMon Freemium, Advanced IP Scanner o AppNeta PathTest, más enfocadas a análisis de tráfico, escaneo de IPs o pruebas de capacidad de red.

Una estrategia muy habitual consiste en combinar varias de estas piezas para que toda tu telemetría crítica nunca salga de tu infraestructura salvo que tú decidas conectarla con servicios externos. Por ejemplo, puedes usar Prometheus + Grafana para métricas de servidores, y LibreNMS para la parte de red pura y dura.

Soluciones comerciales on-premise: potencia y soporte sin soltar datos

Además del ecosistema libre, existe una buena lista de herramientas comerciales que ofrecen monitorización avanzada con despliegue local. Apuntan a organizaciones que quieren soporte profesional, SLAs, formación y muchas funcionalidades listas desde el minuto uno, pero que al mismo tiempo necesitan mantener los datos “en casa”.

Entre los nombres más conocidos que permiten operar en modo on-premise (o con esquemas híbridos) encontramos Paessler PRTG, ManageEngine OpManager, SolarWinds (Network Performance Monitor, Server & Application Monitor), WhatsUp Gold, OP5 Monitor o LogicMonitor (este último algo más centrado en SaaS). Suelen ofrecer dashboards personalizables, descubrimiento automático de dispositivos, mapas de red L2/L3 y sistemas de alertas muy trabajados.

PRTG, por ejemplo, es conocido por su instalación relativamente sencilla, su autodescubrimiento de la red y un editor de mapas drag-and-drop con el que puedes montar pantallas de estado para mostrarlas en un monitor de pared. OpManager, por su parte, se enfoca en la supervisión de infraestructura (servidores físicos y virtuales, dispositivos de red) con paneles claros y buena capacidad de informes.

En el caso de Zabbix, Nagios u OP5 Monitor, además de la versión open source o comunitaria, suele haber opciones de soporte de nivel empresarial, formación oficial y consultoría. Esto cobra sentido cuando vas a montar un sistema grande y quieres garantías contractuales y tiempos de respuesta definidos.

Telemetría con agente y sin agente: pros, contras y encaje en local

Un punto de diseño importante a la hora de montar tu dashboard de telemetría local es decidir hasta qué punto vas a usar agentes instalados en cada máquina o tirar de monitorización sin agente. Ambas estrategias tienen sus ventajas y lo normal es combinarlas.

La monitorización con agente implica instalar un pequeño software en cada PC o servidor, que se encarga de recopilar métricas detalladas y enviarlas al servidor central. Esto te permite ver procesos concretos, métricas específicas de una aplicación, contadores finos del sistema operativo o sensores de hardware que no están disponibles desde fuera.

La monitorización sin agente se basa en protocolos como SNMP, WMI, IPMI o incluso consultas HTTP/SSH para interrogar remotamente a los dispositivos. Es muy útil cuando no es práctico instalar nada en cada equipo, por ejemplo en switches, routers, impresoras, ciertos dispositivos IoT o sistemas embebidos.

Para un PC-servidor casero o una pequeña oficina, lo habitual es que un agente ligero sea más que suficiente para CPU, memoria, disco, red y procesos. En una empresa con cientos de nodos, la combinación de ambos enfoques suele ser lo más sensato: agentes donde necesitas detalle y SNMP/WMI/IPMI donde solo requieres estado y rendimiento básicos.

Telemetría técnica vs. monitorización de empleados y pantallas

Conviene separar muy bien la telemetría técnica de un PC (recursos, rendimiento, estado de servicios) de lo que sería monitorización de actividad de usuarios. En muchas organizaciones se usan herramientas que graban la pantalla, toman capturas periódicas o registran qué aplicaciones se utilizan, con fines de gestión, seguridad o cumplimiento.

Ese tipo de software también suele ofrecer dashboards, pero ya no se centran en CPU y memoria, sino en comportamiento humano y uso de aplicaciones: qué ventana está activa, cuánto tiempo se pasa en cada programa, qué URLs se visitan, etc. Técnicamente es telemetría, pero entra en un terreno mucho más sensible a nivel de privacidad.

Si decides usar soluciones de este tipo, entran en juego cuestiones como la transparencia con la plantilla, el impacto en la cultura de equipo, la percepción de vigilancia y las implicaciones legales según el país y la normativa laboral o de protección de datos. Es fundamental explicar claramente qué se monitoriza, durante cuánto tiempo se guardan los datos, con qué fines y quién tiene acceso.

Desde el punto de vista técnico, lo recomendable es que estos sistemas también permitan desplegar el servidor y el almacenamiento de grabaciones en tu propia red, de forma que las capturas de pantalla, logs y demás no salgan a un cloud ajeno sin control. Así puedes alinear objetivos de seguridad, cumplimiento y privacidad con tu política general de telemetría local.

Alertas inteligentes y dashboards proactivos: que el sistema vigile por ti

Un dashboard de telemetría que solo sirve para “ir mirando de vez en cuando” se queda muy corto. El salto de calidad llega cuando combinas visualización con monitores y alertas bien diseñadas que se disparan solo cuando algo se sale de lo normal. La idea es que el sistema haga de centinela y tú no tengas que estar pegado a la pantalla todo el día.

Herramientas como Datadog (en su vertiente más cloud), Prometheus, Zabbix o muchas de las soluciones comerciales mencionadas permiten definir monitores de métricas con umbrales estáticos, detección de cambios bruscos o algoritmos de anomalías. Puedes vigilar espacio en disco, latencias, tasas de error, número de peticiones o cualquier métrica que tenga sentido en tu entorno.

Para cada alerta se suele configurar la métrica concreta, las condiciones exactas (mayor que, menor que, durante cuánto tiempo), el mensaje que se enviará y los canales por los que va a saltar: correo, mensajería interna, integración con un sistema de tickets, SMS, etc. En organizaciones grandes también se define quién puede editar cada monitor, quién debe ser notificado si se cambia y qué políticas de escalado se aplican.

En muchos despliegues avanzados se crean monitores automáticos de línea base que se activan en cuanto instalas un agente en un servidor nuevo: CPU, memoria, discos, procesos clave, nodos de Kubernetes, tasas de error de servicios APM, etc. Esto acelera mucho el tener una cobertura mínima sin tener que afinar todo a mano desde cero.

Dashboards preconfigurados y anotaciones: el enfoque de plataformas tipo Bleemeo

Una queja bastante común sobre las plataformas de monitorización es que te dejan ante un lienzo en blanco y te fuerzan a ser casi diseñador de cuadros de mando. Algunos proveedores intentan aliviar esto con dashboards automáticos generados al instalar el agente, como es el caso de Bleemeo y su agente Glouton.

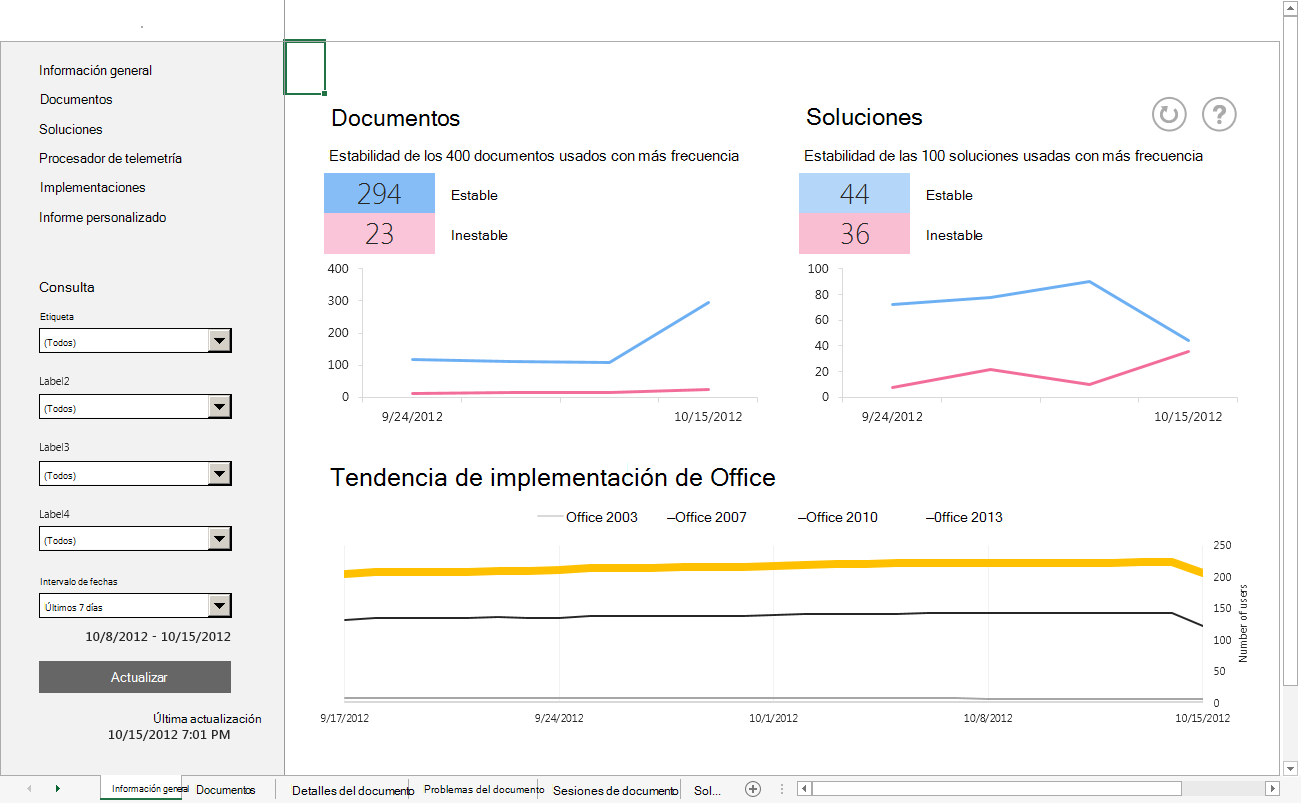

En este tipo de enfoque, nada más conectarse el agente a un servidor, se crea un panel completo con pestañas para Sistema, CPU, Memoria, Disco, Red, Procesos y Servicios. Eso significa que tienes un dashboard útil desde el minuto uno, algo que durante un incidente vale oro porque no pierdes tiempo definiendo gráficas a mano.

Plataformas de este estilo suelen recoger métricas cada pocos segundos (por ejemplo, cada 10), lo que proporciona una imagen casi en tiempo real de lo que está ocurriendo. Además, suelen ofrecer retenciones largas de datos, del orden de varios meses o más de un año, permitiendo combinar vista de incidente reciente con análisis de tendencias a largo plazo en el mismo entorno.

Otro detalle interesante es el uso de anotaciones en los gráficos para marcar despliegues, cambios de configuración, mantenimientos o hitos en un incidente. Cuando vuelves a revisar un dashboard días o semanas después, es mucho más fácil interpretar por qué una métrica cambió en un momento concreto si ves la marca de “deploy”, “cambio de firmware” o “mantenimiento programado”.

Telemetría local, hardware sostenible y certificaciones

Más allá del software, hay un aspecto que cada vez pesa más: el del impacto ambiental y la sostenibilidad del hardware que usamos para montar nuestros sistemas de monitorización. Existen productos certificados por estándares como Global Recycled Standard (GRS) que garantizan un porcentaje significativo de material reciclado en su fabricación.

Los productos con certificación GRS contienen al menos un 50 % de material reciclado verificado de forma independiente en cada etapa de la cadena de suministro, desde el origen hasta el producto final. Además, deben cumplir requisitos sociales, ambientales y químicos específicos. Cuando compras un equipo con este sello, estás apoyando el uso de contenido reciclado en la cadena de suministro y contribuyendo a reducir residuos.

En algunos programas de sostenibilidad, para que un producto se considere, por ejemplo, “Climate Pledge Friendly”, se exige precisamente ese mínimo del 50 % de material certificado GRS. Las auditorías son realizadas por organismos de certificación independientes; uno de los más conocidos es Intertek, que asigna a cada certificación un número único (por ejemplo, un código como TE-00066022) para poder verificarla y trazarla.

Si vas a invertir en servidores, carcasas, periféricos o accesorios para tu laboratorio de telemetría local, puede tener sentido mirar estas certificaciones. No afecta a cómo corre Prometheus o Grafana, pero sí marca diferencia en la huella ecológica de tu proyecto y en la responsabilidad social de la infraestructura que montas.

Visto en conjunto, montar un dashboard de telemetría local para PC hoy en día te permite controlar a fondo el rendimiento y la seguridad de tus equipos, reducir tiempos de caída y planificar capacidad con datos reales, al tiempo que proteges mejor la privacidad de tus métricas y, si quieres hilar fino, eliges hardware con certificaciones que fomentan el uso de materiales reciclados. Con las herramientas open source y comerciales que existen, más que una cuestión técnica suele ser cuestión de sentarse, definir qué necesitas ver en tu panel y dedicar unas cuantas tardes a dejarlo fino hasta que tu sistema se convierta en ese “centro de mando” que vigila por ti las 24 horas.