- Un servidor bien dimensionado y ubicado permite centralizar datos, aplicaciones y servicios clave de la empresa con seguridad y alto rendimiento.

- La correcta elección de hardware, sistema operativo, red y ubicación física condiciona la estabilidad y escalabilidad de toda la infraestructura.

- La seguridad exige actualizaciones constantes, firewalls, cifrado, copias de seguridad y una estricta gestión de usuarios y permisos.

- Virtualización, nube híbrida, edge computing y automatización con IA son tendencias que mejoran flexibilidad, eficiencia y resiliencia de los servidores.

Si te estás peleando con la idea de montar o configurar un servidor y no sabes por dónde empezar, este artículo pretende ser tu colección de manuales de servidores y tutoriales para configurar todo el entorno con cabeza: desde el hardware y el sistema operativo hasta los servicios web, la seguridad y el mantenimiento diario.

Vamos a reunir y reorganizar de forma clara una gran cantidad de guías técnicas, buenas prácticas y conceptos que se usan en empresas, centros de datos y entornos académicos, pero explicados en un tono cercano y orientados especialmente a pymes y administradores que quieren hacerlo bien sin volverse locos.

Qué es un servidor y por qué es tan importante en una pyme

En la práctica, un servidor es un ordenador especializado en ofrecer servicios a otros equipos de la red: comparte archivos, ejecuta aplicaciones, aloja una web corporativa, gestiona el correo, bases de datos y mucho más.

Gracias a este rol centralizado, toda la información de la empresa se almacena y organiza en un único punto controlado, lo que facilita el acceso, la protección de los datos y la aplicación de políticas de seguridad coherentes.

Un buen servidor permite que tus empleados puedan colaborar en tiempo real desde cualquier lugar, trabajar sobre los mismos documentos y acceder a las aplicaciones críticas sin depender de que “ese archivo” esté en el portátil de alguien.

Además, la arquitectura basada en servidores está pensada para crecer: si tu negocio despega, puedes aumentar capacidad de CPU, memoria o almacenamiento o incluso virtualizar nuevos servidores sin tener que rehacerlo todo desde cero.

Por último, tener un servidor bien dimensionado te da capacidad de implantar copias de seguridad, alta disponibilidad y recuperación ante desastres, algo clave para que un fallo de hardware no deje a tu empresa en fuera de juego.

Servidor propio, hosting y cloud: opciones reales sobre la mesa

Cuando hablamos de servidores hoy en día no solo pensamos en una caja física en la oficina; existen servidores dedicados, VPS, hosting compartido y servicios en la nube ofrecidos por proveedores especializados.

Empresas veteranas del sector, algunas con décadas de experiencia en registro de dominios y alojamiento, ofrecen desde simples planes de hosting hasta máquinas dedicadas y plataformas VPS en centros de datos distribuidos por Europa.

La aparición de la nube ha impulsado el uso de servidores virtuales sobre infraestructura física compartida, de forma que puedes contratar recursos “a la carta” sin comprar hardware ni montar un CPD propio.

En escenarios híbridos es muy habitual combinar un servidor local para datos sensibles y servicios internos con recursos en nube pública para picos de carga o aplicaciones menos críticas, manteniendo así un buen equilibrio entre control, coste y flexibilidad.

Para una pyme, la decisión suele oscilar entre tener un servidor propio en la oficina, colocarlo en un centro de datos o directamente consumir todo como servicio en la nube, cada opción con sus pros y contras de coste, seguridad y mantenimiento.

Hardware del servidor: el corazón de toda la infraestructura

El primer paso antes de hablar de sistemas operativos y servicios es decidir el hardware que dará soporte al servidor, porque de ello depende el rendimiento y la estabilidad del sistema.

El procesador o CPU actúa como el “cerebro” del equipo: cuantos más núcleos y mejor frecuencia efectiva, más peticiones simultáneas y procesos complejos podrá manejar sin quedarse corto.

La memoria RAM es crítica en servidores que ejecutan múltiples aplicaciones o máquinas virtuales, ya que una cantidad generosa de RAM evita cuellos de botella cuando crecen las bases de datos, el número de conexiones o el uso de cachés.

En el almacenamiento, hoy manda el SSD: ofrece tiempos de acceso muy reducidos y altas tasas de lectura y escritura, ideal para bases de datos, aplicaciones web y sistemas que requieren respuesta rápida, aunque sigue siendo habitual combinar SSD para sistema y HDD para datos masivos.

También es importante elegir el formato físico: puedes optar por un servidor en torre, parecido a un PC, o por equipos de tipo rack preparados para armarios de servidores, más adecuados si vas a crecer o ubicarlo en un centro de datos.

Elegir el sistema operativo del servidor

El sistema operativo es la capa que conecta el hardware con las aplicaciones y define gran parte de la experiencia de administración, la seguridad disponible y el ecosistema de herramientas.

En el mundo Microsoft, Windows Server destaca por su entorno gráfico familiar, integración con Active Directory y multitud de utilidades orientadas a empresas, aunque conlleva costes de licencia y suele ser algo menos flexible que Linux en ciertos casos.

En el lado de GNU/Linux, distribuciones como Debian, Ubuntu Server, AlmaLinux o CentOS son gratuitas, muy estables y con un enorme ecosistema de paquetes, pero exigen mayor soltura con la terminal y comprensión de la estructura interna del sistema.

La elección suele depender del presupuesto, la experiencia del equipo y las aplicaciones que quieras montar; algunos programas empresariales solo existen para Windows, mientras que muchos servicios web modernos se despliegan pensando en Linux.

En términos de seguridad, tanto Windows Server como Linux pueden configurarse de forma muy robusta, aunque en el mundo Linux existe una comunidad muy activa que detecta y corrige vulnerabilidades con rapidez y mantiene una documentación extensa y actualizada.

Fundamentos de redes para servidores

Para que un servidor resulte útil, tiene que hablar con el resto del mundo: necesitas entender algunos conceptos básicos de redes como TCP/IP, direcciones IP y DNS para que los servicios sean accesibles y seguros.

El modelo TCP/IP, dividido en capas, define cómo se encapsulan y transportan los datos; protocolos como TCP y UDP resuelven el envío fiable o rápido de la información según el servicio (web, correo, streaming, etc.).

Las direcciones IPv4 siguen siendo la base de muchas redes: se representan en formato CIDR con máscaras de 32 bits y reservan rangos para redes privadas, direcciones de loopback y otros usos especiales.

En servidores Linux modernos la configuración de red suele realizarse mediante NetworkManager y herramientas como iproute2 (comando ip), que permiten gestionar interfaces, rutas, VLANs y parámetros avanzados sin recurrir a utilidades antiguas.

La creación de VLANs, por ejemplo, permite segmentar lógicamente la red para aislar servicios, mejorar la seguridad y gestionar mejor el tráfico entre departamentos o zonas de la infraestructura.

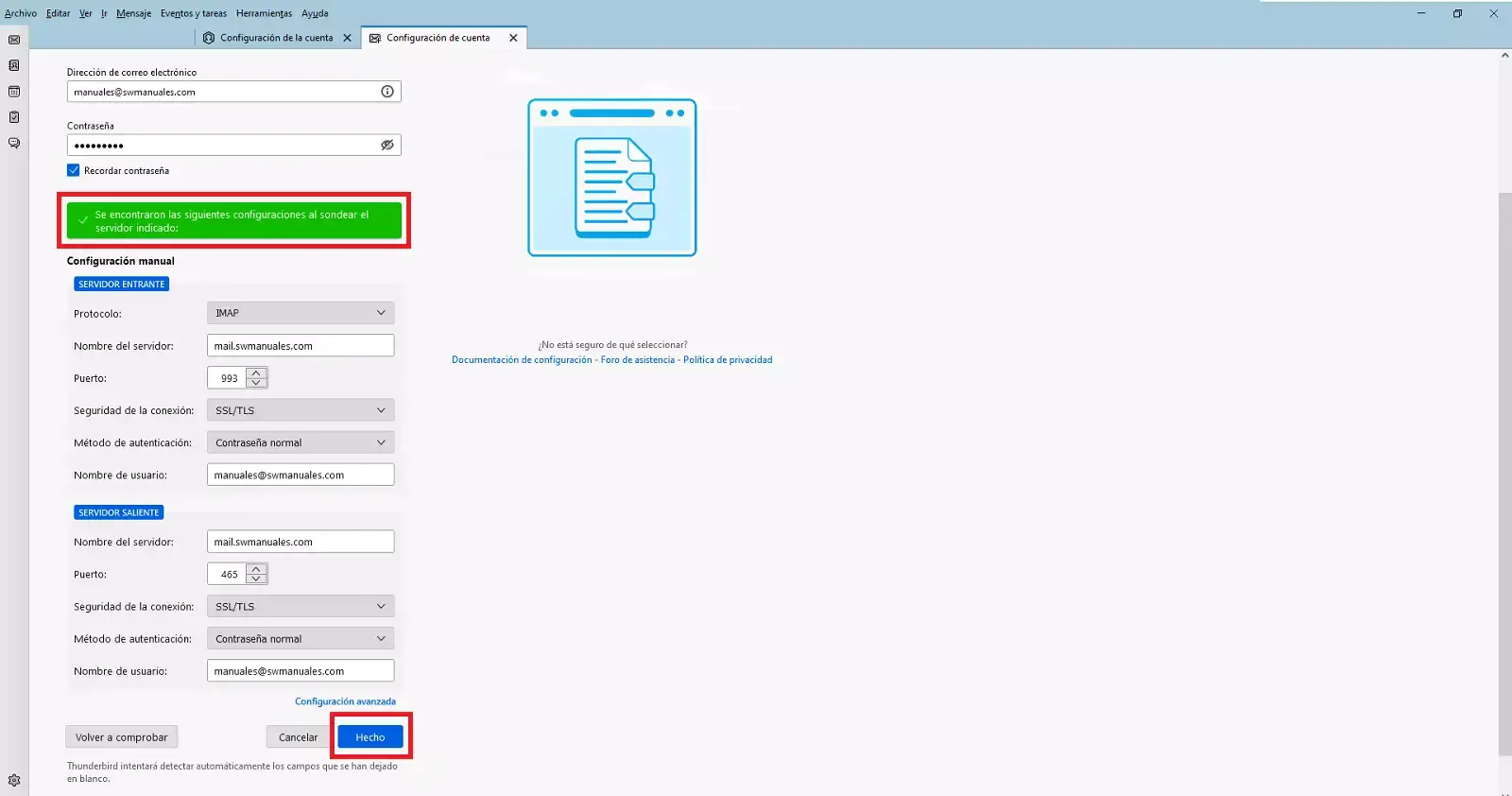

Configurar un servidor web con IIS y Web Deploy

En entornos Windows Server es muy habitual desplegar sitios y aplicaciones mediante Internet Information Services (IIS) junto con la herramienta Web Deploy para automatizar publicaciones desde equipos de desarrollo.

Al trabajar con Web Deploy, puedes elegir entre usar el servicio Remote Agent, el controlador de implementación web (Web Deployment Handler) o realizar despliegues sin conexión importando paquetes manualmente en IIS.

El uso del controlador de implementación web es más complejo de configurar, pero permite que usuarios sin permisos de administrador puedan publicar sitios concretos, algo muy útil en entornos de hosting o en equipos grandes de desarrollo.

La configuración típica exige crear una cuenta de dominio específica para las publicaciones, instalar IIS 7.5 o superior con el servicio de administración web y la autenticación básica, desplegar Web Deploy 2.x y abrir el puerto 8172/TCP en los firewalls.

También tendrás que crear un sitio en IIS, asociarlo a una carpeta física, asignar permisos a la identidad del grupo de aplicaciones mediante el grupo IIS_IUSRS y conceder privilegios de publicación al usuario de dominio no administrador.

Instalación de componentes necesarios en Windows Server

En una instalación de servidor limpia (por ejemplo, Windows Server 2016), lo recomendable es ejecutar primero Windows Update para asegurarte de que el sistema base está completamente parcheado antes de añadir roles y características.

Después puedes usar el Instalador de plataforma web de Microsoft para cargar, en un solo proceso, la configuración recomendada de IIS, la herramienta Web Deploy, el servicio de administración, el módulo de autenticación básica y los framework necesarios como .NET y ASP.NET MVC.

Si en algún momento instalas .NET Framework antes que IIS, es imprescindible registrar la versión adecuada de ASP.NET con la utilidad aspnet_regiis tanto en la ruta de 32 como de 64 bits para que el servidor web pueda procesar aplicaciones y no devuelva errores 404 al acceder a contenido dinámico.

Una vez completadas estas instalaciones, conviene volver a pasar por Windows Update para aplicar parches y actualizaciones de seguridad adicionales que afecten a los nuevos componentes recién añadidos al sistema.

Con todo esto realizado, tu servidor Windows estará listo para empezar a crear sitios en IIS, recibir despliegues remotos y hospedar aplicaciones ASP.NET modernas con seguridad y buen rendimiento.

Creación y permisos de sitios web en IIS

Para que Web Deploy pueda hacer su trabajo, es necesario que el sitio de destino exista: debes crear una carpeta local para los archivos (por ejemplo, C:\DemoSite) y después añadir un nuevo sitio en IIS apuntando a esa ruta.

Al definir el sitio elegirás un nombre, un puerto HTTP y, si lo necesitas, un nombre de host asociado a registros DNS, además de configurar los enlaces adicionales para que el servidor responda en la IP adecuada.

En la parte de grupos de aplicaciones, se recomienda que cada sitio tenga su application pool propio asociado a .NET CLR 4.0 (o la versión que corresponda), lo que mejora el aislamiento y la estabilidad del entorno.

En cuanto a permisos de archivos, lo más práctico es conceder a la cuenta de grupo local IIS_IUSRS permisos de lectura y ejecución sobre la carpeta de contenido, de forma que la identidad interna del grupo de aplicaciones pueda servir los archivos sin problemas.

Por último, desde el propio Administrador de IIS puedes abrir el asistente de configuración de publicación para otorgar al usuario de dominio sin privilegios de administrador los permisos necesarios para desplegar cambios en ese sitio concreto.

Firewalls y acceso remoto al servidor

Si el servidor tiene Firewall de Windows activo (o un firewall de terceros), hay que recordar que el servicio de administración web de IIS escucha en el puerto 8172/TCP, por lo que deberás crear una regla de entrada que permita este tráfico.

En general, todo tráfico saliente está permitido por defecto, pero la clave está en asegurar que el tráfico entrante hacia el puerto de administración esté limitado a las IP de confianza o segmentos de red desde los que realmente vayas a desplegar.

En despliegues más avanzados, combinar las reglas de firewall con una estrategia de lista blanca de direcciones y servicios puede reducir de forma importante la superficie de ataque frente a malware, ransomware y botnets.

Para otros servicios como SSH, RDP, HTTP, HTTPS, DNS o bases de datos, deberás abrir únicamente los puertos estrictamente necesarios, preferiblemente segmentando la red en VLANs y usando zonas diferenciadas en el cortafuegos.

En el caso de firewalls de terceros o dispositivos perimetrales dedicados, será imprescindible revisar la documentación del fabricante para crear reglas específicas que repliquen este comportamiento de seguridad granular.

Costes, inversión inicial y mantenimiento continuo

Montar un servidor no solo implica comprar la máquina: hay que tener en cuenta hardware, licencias de software, mano de obra de instalación y el mantenimiento periódico que garantice que todo siga funcionando bien.

En la parte de hardware entran tanto el propio servidor como sistemas de alimentación ininterrumpida (SAI/UPS), almacenamiento adicional y, si lo tienes en tus instalaciones, elementos de refrigeración y seguridad física.

El coste de software dependerá de si eliges sistemas operativos comerciales con licencia o distribuciones de código abierto; a esto hay que sumar posibles licencias de bases de datos, paneles de control o aplicaciones de negocio.

Es frecuente contar con un técnico o proveedor externo para la puesta en marcha inicial, endurecimiento de la seguridad y documentación del entorno, especialmente si en la empresa no existe un administrador con experiencia.

A partir de ahí, el presupuesto anual debe contemplar tareas de mantenimiento preventivo, actualizaciones, copias de seguridad, monitorización y soporte ante incidencias, porque un servidor abandonado se convierte en un riesgo a medio plazo.

Seguridad en servidores: riesgos y buenas prácticas

Los servidores suelen ser el objetivo preferente de atacantes porque concentran datos sensibles, credenciales y servicios críticos que, si se comprometen, pueden paralizar por completo un negocio.

Entre los riesgos habituales están los ataques remotos que explotan vulnerabilidades del sistema operativo o de las aplicaciones, el malware que cifra o roba datos y los errores de configuración que dejan servicios expuestos sin necesitarlo.

Otra fuente habitual de problemas son las contraseñas débiles, la falta de segmentación de red y el exceso de privilegios en cuentas de usuario que no deberían tener tanto poder en el sistema.

Como contramedidas básicas, es obligatorio mantener todo el software actualizado con parches de seguridad, usar contraseñas robustas, activar cortafuegos, restringir el acceso remoto y realizar copias de seguridad periódicas verificadas.

En entornos más exigentes se añaden medidas como cifrado de datos en reposo y en tránsito, autenticación multifactor, sistemas de detección de intrusos, registros exhaustivos y auditorías regulares de permisos y configuraciones.

Ubicación física del servidor y condiciones ambientales

Otra decisión clave es dónde instalar el servidor: puedes dejarlo en un despacho de la empresa, alojarlo en un centro de datos profesional con energía y conectividad redundante o externalizarlo por completo en la nube.

Tenerlo en local te da más control y menor latencia dentro de la red interna, pero exige cuidar el espacio, la refrigeración, la seguridad física y la alimentación estable, algo que muchas oficinas estándar no ofrecen de serie.

Si optas por un centro de datos, disfrutas de infraestructura eléctrica redundante, vigilancia, control de acceso y climatización diseñada para hardware crítico, a cambio de una cuota mensual y un acceso físico más limitado.

En soluciones completamente en la nube el proveedor se ocupa del hardware y del CPD, mientras tú te centras en la parte lógica, aunque aceptas cierta dependencia del proveedor y menos capacidad de personalizar el entorno físico.

En todos los casos, hay que vigilar la temperatura, la humedad, la calidad de la corriente eléctrica y la protección frente a accesos no autorizados o desastres, ya que cualquier fallo físico puede detener el servicio por completo.

Conectividad, ancho de banda y latencia

Un servidor conectado a una línea mediocre se convierte en un cuello de botella: necesitas una conexión de banda ancha con suficiente subida para soportar las peticiones de usuarios, copias de seguridad remotas y accesos externos.

En muchos casos se recomienda contratar enlaces con garantía de ancho de banda y baja latencia, especialmente si vas a servir aplicaciones en tiempo real, videollamadas o servicios críticos para clientes.

Cuando el servidor es realmente importante para el negocio, conviene disponer de conectividad redundante mediante dos proveedores o rutas diferentes, de forma que una caída de red no tumbe todos los servicios.

Además del ancho de banda bruto, es vital medir la latencia, es decir, el tiempo que tarda un paquete en ir y volver entre el cliente y el servidor, ya que una latencia elevada penaliza la experiencia de usuario en aplicaciones interactivas.

En despliegues IoT o de edge computing, muchas decisiones de arquitectura se toman precisamente para acercar el procesamiento a donde se generan los datos y así reducir al mínimo esa latencia.

Virtualización y edge computing: multiplicar y acercar los servidores

La virtualización permite dividir un servidor físico en múltiples máquinas virtuales independientes con sus propios sistemas operativos, lo que facilita consolidar cargas, optimizar recursos y aislar servicios entre sí.

Gracias a los hipervisores modernos, es posible mover una máquina virtual de un host a otro casi sin interrupción, lo que contribuye a alta disponibilidad, balanceo de carga y tareas de mantenimiento sin cortes prolongados.

El edge computing, por su parte, desplaza parte del procesamiento desde la nube central hacia puntos cercanos al usuario o a los dispositivos, como nodos regionales o pasarelas IoT, reduciendo la latencia y la carga de la red principal.

Este enfoque resulta crucial para aplicaciones que requieren respuesta en tiempo real, como sensores industriales, videojuegos en la nube, realidad virtual o vehículos conectados, donde unos milisegundos marcan la diferencia.

En muchos diseños modernos se combinan nube central, edge computing y servidores locales, buscando el equilibrio óptimo entre rendimiento, coste, latencia y privacidad de los datos según cada carga de trabajo.

Automatización, IA y tendencias futuras en servidores

El futuro de la administración de servidores se dirige a sistemas cada vez más automatizados, inteligentes y capaces de anticiparse a los problemas gracias a técnicas de aprendizaje automático y analítica avanzada.

Los algoritmos de machine learning pueden analizar logs y métricas de rendimiento para detectar anomalías, predecir fallos de hardware y recomendar ajustes de configuración antes de que aparezcan errores visibles para el usuario.

La IA también es capaz de optimizar el uso de recursos, redistribuyendo cargas, ajustando dinámicamente CPU, RAM o almacenamiento asignado a cada servicio y reduciendo así costes operativos en plataformas de nube híbrida o multi-nube.

La automatización va más allá de los scripts: infraestructuras inmutables, despliegue continuo y arquitecturas serverless donde solo se ejecuta código bajo demanda permiten gestionar entornos enormes sin necesidad de tocar servidor por servidor.

Incluso tecnologías emergentes como la computación cuántica se perfilan en el horizonte como una posible revolución para determinados tipos de cálculo y optimización, aunque de momento siguen en etapas muy tempranas para el uso diario en producción.

Formación, manuales técnicos y talleres de administración

Para gestionar servidores con solvencia a medio y largo plazo es importante apoyarse en manuales técnicos bien mantenidos y en continua actualización, elaborados por administradores con experiencia real en producción.

Muchos de estos recursos se ofrecen bajo licencias abiertas como Creative Commons, permitiendo su reutilización mientras se respeta la autoría y se comparten las adaptaciones, algo muy útil para centros educativos y equipos de TI internos.

En el ámbito de GNU/Linux existen colecciones de documentación que cubren desde primeros pasos en la terminal y estructura de directorios hasta tareas avanzadas de administración, migración de distribuciones y recuperación ante fallos.

Es habitual encontrar talleres prácticos sobre gestión de paquetes, creación y mantenimiento de usuarios y grupos, permisos de archivos, atributos avanzados (chattr), ACLs (getfacl, setfacl) y uso de sudo para delegar privilegios de forma controlada.

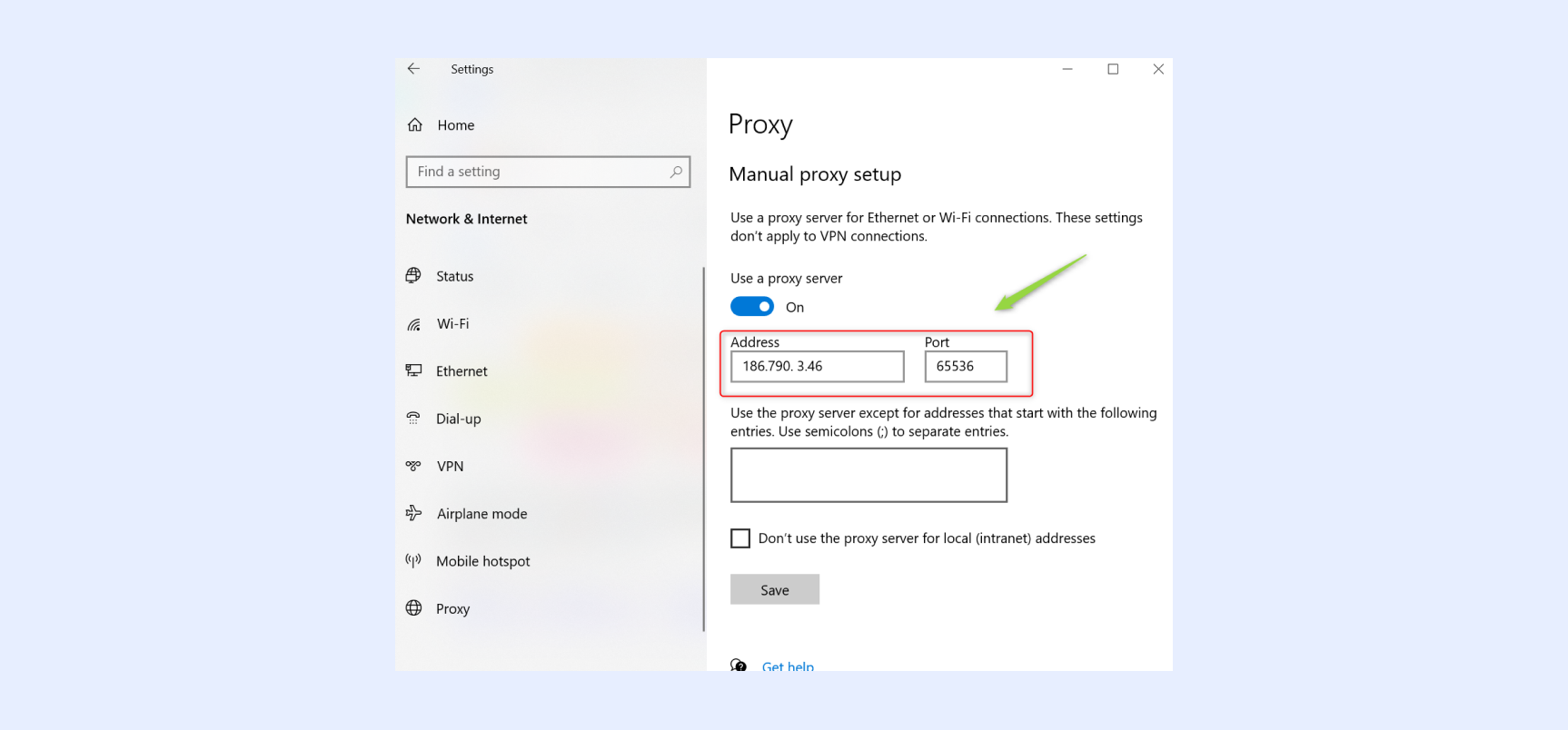

Otros bloques se centran en redes y conectividad: desde introducciones a TCP/IP e IPv4, pasando por configuración de VLANs, ARP, firewalls dinámicos con zonas, DHCP, DNS con BIND o DNSMasq, FTP seguro con vsftpd o pure-ftpd y proxies de filtrado de contenido como Squid.

Servicios clave: web, bases de datos, logging y acceso remoto

La mayoría de proyectos de infraestructura giran en torno a unos pocos servicios esenciales: el servidor web, el motor de bases de datos y los sistemas de registro y monitorización que permiten detectar problemas a tiempo.

Configurar un servidor web robusto (HTTP/HTTPS) implica cuidar certificados, cifrado TLS, cabeceras de seguridad y autenticación en zonas administrativas, así como establecer límites de recursos y aislamiento entre aplicaciones.

En bases de datos hay que prestar atención a la integridad de los datos, las copias de seguridad, la replicación y el control de accesos, asegurando que cada aplicación tiene solo los permisos estrictamente necesarios.

Los sistemas de logging centralizado y supervisión continua recopilan eventos y métricas para analizar rendimiento, investigar incidentes y cumplir normativas, convirtiéndose en una pieza clave de cualquier entorno profesional.

En cuanto al acceso remoto para administración, servicios seguros como SSH y túneles cifrados, combinados con VPNs y autenticación multifactor, son la base para gestionar servidores sin exponer innecesariamente los puertos de gestión.

En conjunto, todo este ecosistema de hardware, sistema operativo, red, seguridad, automatización y documentación hace posible que un servidor bien configurado se convierta en la columna vertebral silenciosa pero fiable de tu infraestructura, soportando desde la web corporativa y el correo hasta aplicaciones complejas, mientras reduces riesgos y mantienes el control sobre tus datos y servicios críticos.