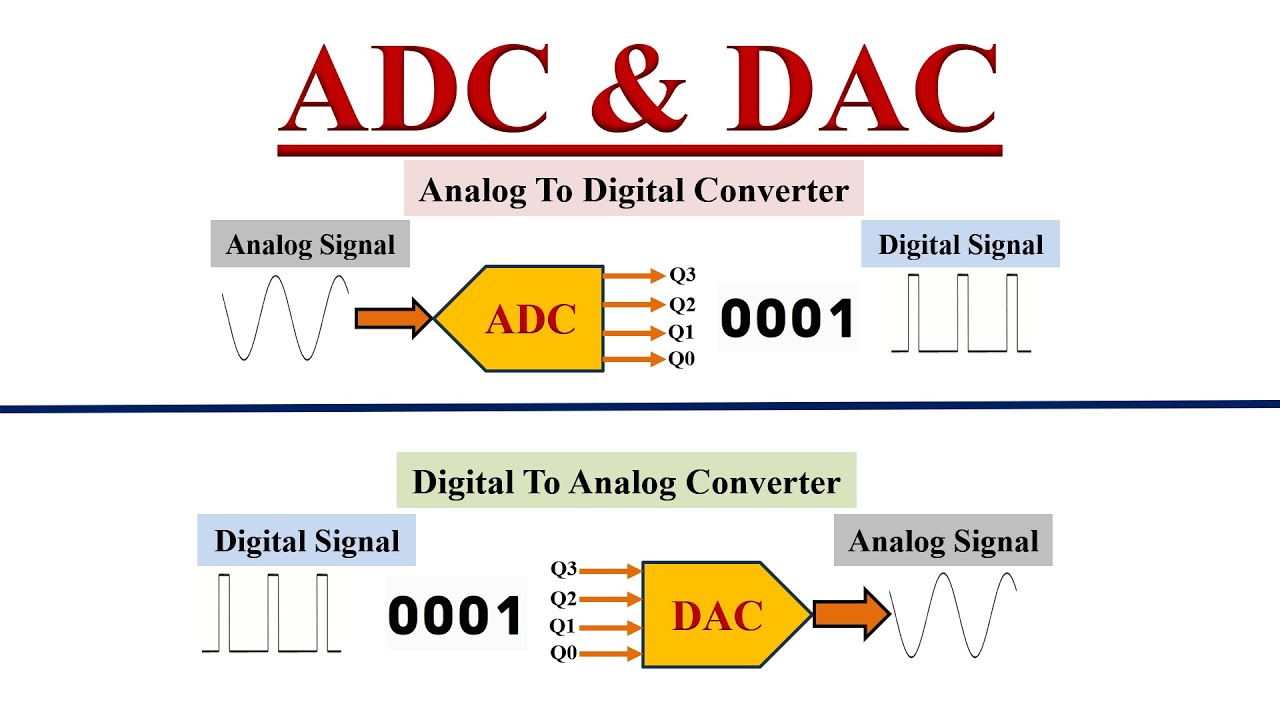

- El RAMDAC era un chip que convertía los datos digitales de la tarjeta gráfica en señal analógica para monitores VGA, usando memoria asociada para gestionar paletas de colores.

- Con la llegada de SVGA y la mejora en la integración de semiconductores, el RAMDAC pasó de ser un chip independiente a integrarse dentro del propio controlador de vídeo y después en la GPU.

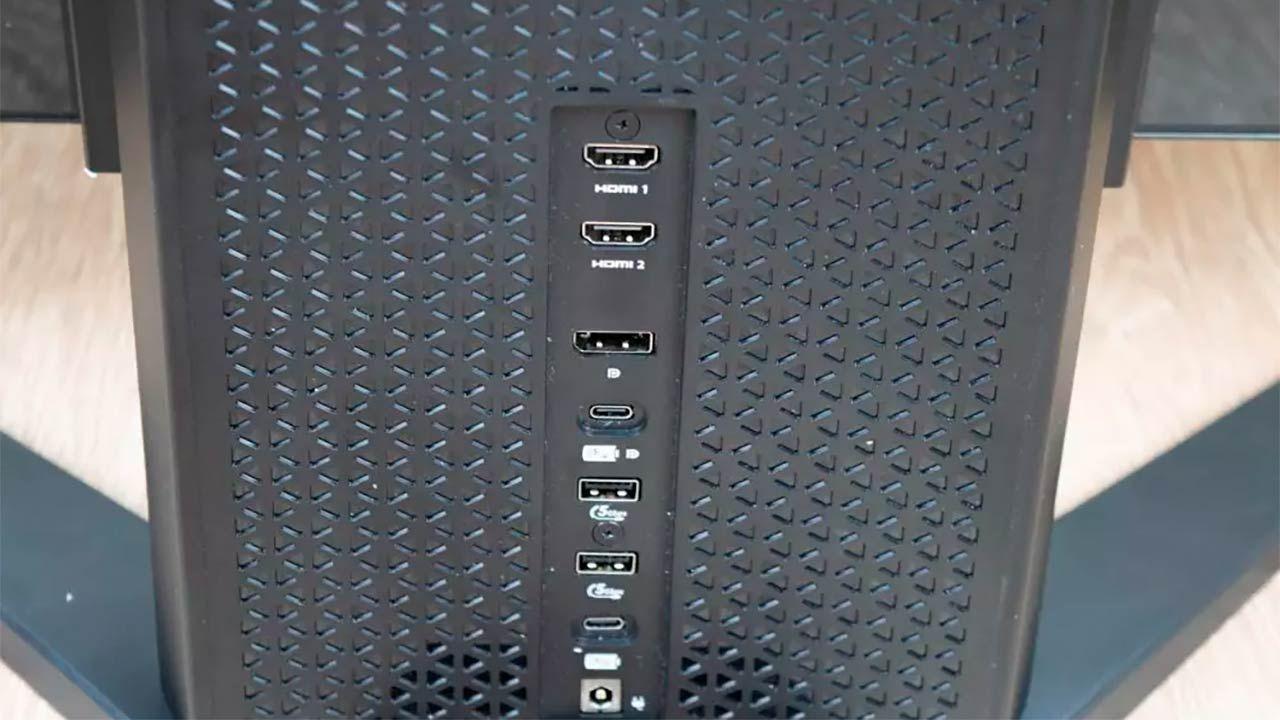

- La transición a pantallas digitales y conectores como DVI, HDMI y DisplayPort ha hecho que la conversión digital‑analógica sea casi innecesaria, relegando al RAMDAC a un papel residual.

- En las GPUs modernas, la salida de vídeo es mayoritariamente digital, y la mención a “RAMDAC integrado” suele ser un vestigio histórico más que un componente relevante para el rendimiento.

Si alguna vez has mirado la información de tu tarjeta gráfica en Windows y has visto algo como “RAMDAC integrado”, es normal que te quedes con cara de póker. Más aún si tienes una gráfica moderna tipo RTX 3060 y piensas que ese tipo de tecnología ya ni se usa. La realidad es que el término sigue apareciendo por pura inercia histórica, aunque en la práctica su función ha cambiado mucho.

Para entender por qué las tarjetas gráficas actuales casi no usan el RAMDAC tal y como se concebía antes, hay que hacer un pequeño viaje al pasado, ver qué era exactamente este componente, cómo encajaba en las viejas tarjetas VGA, y qué ha pasado con la llegada de las salidas digitales como HDMI o DisplayPort. Tranquilo, lo vamos a desgranar con calma y en lenguaje llano, sin necesidad de ser ingeniero electrónico.

Qué es exactamente un RAMDAC

El término RAMDAC viene de “Random Access Memory Digital to Analog Converter”, es decir, un convertidor digital‑analógico con memoria de acceso aleatorio asociada. Era un chip específico que se encargaba de convertir los datos digitales generados por la tarjeta gráfica en una señal analógica que pudiera entender el monitor, sobre todo en la era de los conectores VGA.

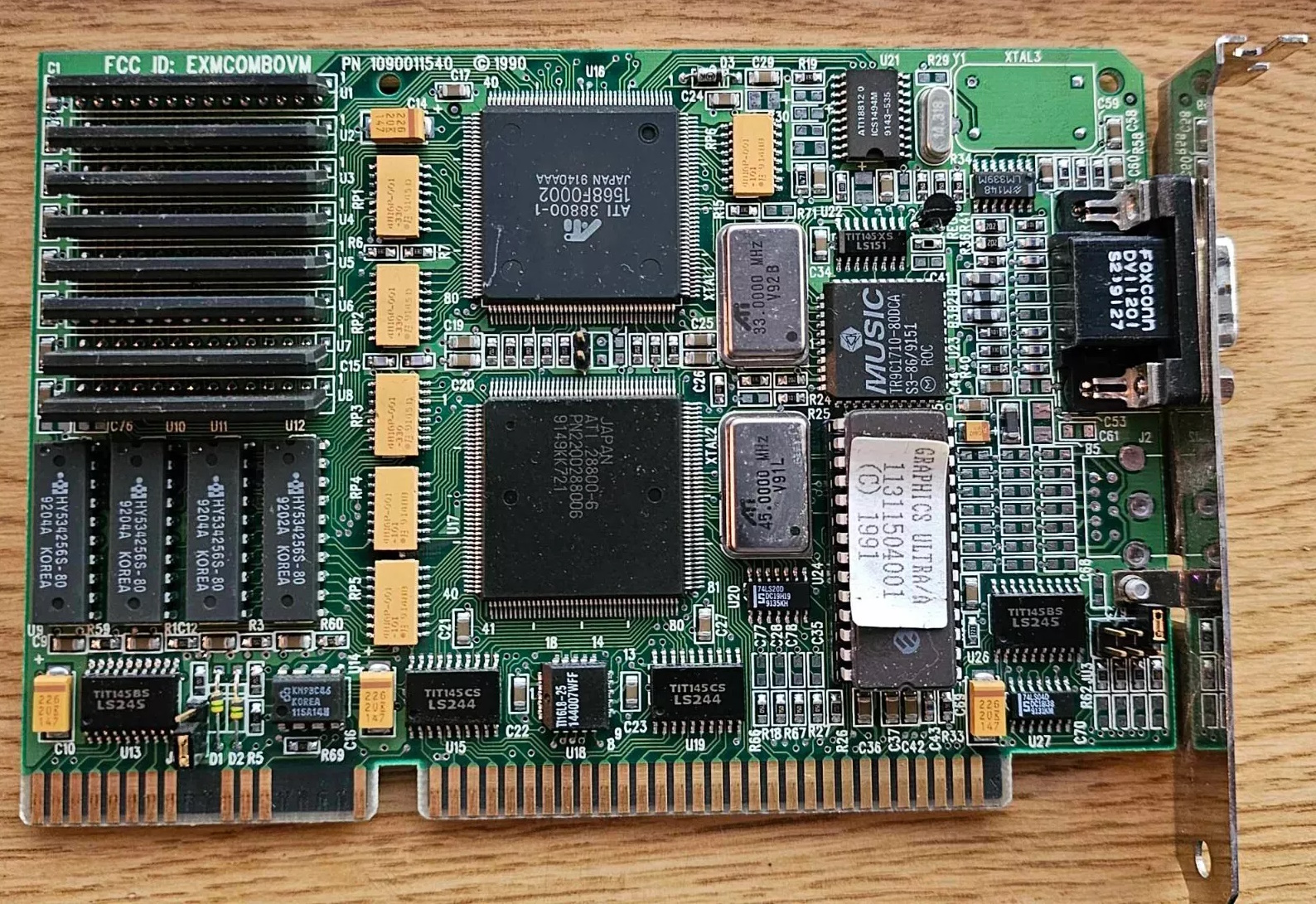

En los años 80 y 90, cuando IBM popularizó el estándar VGA (Video Graphics Array) en 1987, el RAMDAC era un componente independiente y muy visible en la placa de vídeo. La tarjeta VGA original de IBM utilizaba un chip INMOS G171 RAMDAC, que permitía mostrar simultáneamente 256 colores en pantalla a partir de una paleta de 262.144 colores posibles y manejaba tasas de hasta unos 30 megapíxeles por segundo, cifras que en aquella época eran un salto enorme.

Este chip combinaba una pequeña memoria RAM para la tabla de colores (CLUT o Color Look-Up Table) con tres conversores digital‑analógico, uno para cada canal de color (rojo, verde y azul). La GPU de entonces no trabajaba como las actuales; en muchos modos, lo que se almacenaba en memoria de vídeo eran índices a esa tabla de colores, y el RAMDAC se encargaba de traducir esos índices en valores analógicos reales de tensión para cada color.

Los fabricantes de PCs compatibles copiaron masivamente el diseño de la VGA de IBM, y con él copiaron también el uso de un RAMDAC como chip separado. De ahí que durante años se hablara de RAMDAC como si fuera sinónimo de “salida de vídeo” o incluso de “tarjeta gráfica”, aunque en realidad era solo una pieza más del conjunto.

Evolución del RAMDAC: de chip separado a parte de la GPU

Con la llegada de los controladores SVGA (Super VGA) en los 90, el RAMDAC empezó a ganar nuevas funciones y modos de operación. Una de las mejoras clave fue el soporte de “color directo”: en lugar de usar siempre la tabla de colores (CLUT), el controlador podía enviar directamente los valores de color de cada píxel a las entradas de los DAC, lo que permitía trabajar con modos de más bits por píxel y colores más precisos, acercándose a lo que hoy llamamos “true color”.

En esa misma época surgieron innovaciones curiosas como el CEGDAC de Edsun, un tipo de RAMDAC que integraba de serie funciones como el antialiasing por hardware para líneas vectoriales. Esto permitía que las primitivas gráficas (como líneas y bordes) se vieran más suaves sin necesidad de que la CPU o la GPU hicieran cálculos extra de suavizado, algo muy valorado en aplicaciones de diseño y CAD.

A principios de los años 90 la industria de semiconductores pegó un salto considerable, y eso permitió que cada vez se pudieran integrar más componentes en un solo chip. En las tarjetas SVGA de nueva generación, el RAMDAC dejó de ser un chip externo y se integró directamente en el chip de vídeo principal. Con esto se reducía el número de componentes, el consumo, las interferencias y, sobre todo, el coste de fabricación de las tarjetas.

Esta integración marcó el final del mercado de RAMDAC “sueltos” para el mundo PC doméstico. Todavía se siguen fabricando dispositivos similares para usos muy específicos o industriales, pero ya no tienen el protagonismo que tuvieron en la época dorada de la VGA. En los PCs modernos, el RAMDAC (entendido como función de conversión digital‑analógica) está integrado en el silicio de la propia GPU o del chipset.

Hoy en día, tanto en tarjetas dedicadas como en soluciones integradas en placa base o CPU, las funciones de salida de vídeo, gestión de memoria gráfica y conversión de señal están concentradas en muy pocos chips. Lo que antes eran varios componentes separados hoy es, en muchos casos, un único “SoC” gráfico o un par de chips bastante compactos.

Por qué el RAMDAC ha caído en desuso en las tarjetas modernas

El motivo principal por el que el RAMDAC clásico ha perdido protagonismo es el cambio de paradigma en los dispositivos de visualización. Durante décadas, los monitores eran CRT analógicos que necesitaban una señal de vídeo analógica (como la que proporcionaba el conector VGA). Ahí el RAMDAC era imprescindible: sin él, la señal binaria de la tarjeta gráfica no se podía traducir en variaciones de tensión que pintaran la imagen en el tubo.

Sin embargo, con el auge de las pantallas planas digitales (TFT, LCD y tecnologías posteriores), la necesidad de conversión digital‑analógica empezó a difuminarse. Estos paneles funcionan de manera nativa con información digital, por lo que tiene mucho más sentido enviar una señal digital directa y evitar pasos intermedios que pueden introducir ruido o pérdida de calidad.

La llegada de estándares como DVI, HDMI o DisplayPort ha consolidado este enfoque puramente digital. En estos conectores la información de color viaja ya en forma binaria, codificada según el protocolo correspondiente, y es el propio monitor el que se encarga de interpretarla y, si hace falta, convertirla internamente a los niveles eléctricos que requieren los píxeles del panel.

En este escenario, la parte DAC del RAMDAC se vuelve cada vez más prescindible. Muchas tarjetas modernas incluyen, como mucho, un pequeño DAC integrado para mantener compatibilidad VGA mediante adaptadores o puertos heredados, pero es una función residual y en claro retroceso. De hecho, en generaciones recientes de GPUs de NVIDIA y AMD ya ni se incluye salida VGA nativa.

Además, los modos gráficos basados en CLUT y paletas de colores se usan muy poco en sistemas actuales. Casi todo funciona en “true color” de 24 o 32 bits, donde cada píxel ya lleva la información completa de sus componentes de color. El propósito original del RAMDAC como gestor de tablas de colores ha quedado relegado a aplicaciones muy de nicho o a compatibilidad con software antiguo.

Cómo encaja el RAMDAC dentro de una tarjeta gráfica

Para entender mejor qué papel jugaba el RAMDAC y por qué ahora casi no se le presta atención, conviene ver a grandes rasgos cómo es una tarjeta gráfica por dentro y qué hace cada parte. Piensa en la gráfica como un pequeño ordenador especializado en dibujar imágenes a toda pastilla.

El corazón del sistema es la GPU (Graphics Processing Unit), un chip enorme (en términos de número de transistores) diseñado para realizar operaciones matemáticas en paralelo. A diferencia de una CPU, que suele tener pocos núcleos muy potentes y con frecuencias altas, una GPU integra miles de núcleos más simples que trabajan a frecuencias más bajas, pero en número tan grande que pueden procesar millones de vértices y píxeles simultáneamente.

Alrededor de la GPU tenemos la memoria gráfica (GRAM o VRAM), que son los chips donde se almacenan texturas, buffers de imagen, datos intermedios y, en general, todo lo que la GPU necesita tener “a mano” mientras renderiza. Su capacidad y ancho de banda no determinan por sí solos el rendimiento, pero si se quedan cortos pueden convertirse en un cuello de botella y limitar la potencia de la GPU.

En las tarjetas clásicas, después del proceso de renderizado, los datos de la imagen final pasaban por el RAMDAC, que se encargaba de traducir esos valores digitales en señales analógicas continuas para el monitor VGA. Dependiendo de la calidad y frecuencia máxima del RAMDAC, se podía trabajar con ciertas resoluciones y tasas de refresco determinadas; de ahí que muchos fabricantes presumieran de tener RAMDAC de más MHz.

Actualmente, en lugar de un RAMDAC visible y publicitado, las gráficas modernas integran en el propio chip de salida la lógica necesaria para formatear la señal según HDMI, DisplayPort, DVI, etc. Cuando se necesita conversión a analógico (cada vez más raro), se integra un pequeño DAC interno en ese mismo bloque, casi transparente para el usuario.

En paralelo, encontramos otros elementos como los sistemas de refrigeración (disipadores y ventiladores), imprescindibles porque las GPUs manejan cargas de trabajo muy intensas, sobre todo en juegos y edición de vídeo. Todo esto convierte a la gráfica en el componente más exigente térmicamente del PC doméstico en muchas situaciones.

Funcionamiento general de la GPU y relación con la salida de vídeo

Cuando ejecutas un juego, abres un programa de edición de vídeo o simplemente escribes un documento, la CPU calcula qué se tiene que mostrar en pantalla de forma lógica (geometría, posiciones, interfaz) y pasa esa información a la GPU para que haga el trabajo pesado del renderizado. Este proceso suele dividirse, simplificando mucho, en dos grandes fases.

La primera es el procesamiento de vértices. Aquí la GPU recibe los vértices de los modelos 3D y se encarga de aplicarles transformaciones (traslaciones, rotaciones, escalados) y de proyectarlos en la pantalla 2D. También determina qué partes de esos modelos serán visibles y cuáles quedarán tapadas, optimizando para no calcular lo que no se va a ver.

La segunda fase es el procesamiento de píxeles o fragmentos, que es donde realmente se genera el color de cada punto de la imagen. En este paso se aplican texturas, luces, sombras, efectos de postprocesado, transparencia y un sinfín de técnicas que dan lugar a los gráficos que ves en el monitor. Es la parte más exigente en términos de potencia porque se trabaja a resolución completa y con muchos efectos simultáneos.

Una vez que la GPU tiene listo el fotograma final en memoria, entra en juego la etapa de salida de vídeo. En las gráficas modernas, esta etapa se encarga de leer el “framebuffer” y convertirlo al formato requerido por el conector que se esté usando: HDMI, DisplayPort, DVI, etc. Si la salida es completamente digital, el proceso se limita a codificar los datos en el protocolo adecuado y enviarlos a través del cable al monitor.

Si existiera una salida analógica (por ejemplo, VGA), en ese punto sería donde entraría un DAC, que transformaría los valores de cada componente de color en una señal eléctrica continua. De esta forma, el papel clásico del RAMDAC queda reducido a un posible bloque interno más dentro del sistema de salida, en lugar de ser una pieza protagonista como antaño.

Tarjeta gráfica integrada, dedicada y el papel del RAMDAC en cada caso

Hoy en día distinguimos entre tarjetas gráficas integradas y dedicadas. Las integradas forman parte del propio procesador o del chipset de la placa base; comparten recursos con el sistema y están pensadas para tareas diarias como navegar, ofimática o consumo de contenido. Las dedicadas se instalan aparte, suelen ser más grandes y potentes, y están orientadas a juegos, edición de vídeo, 3D y cargas intensivas.

En ambos tipos, la lógica de salida de vídeo está integrada en el propio silicio principal. En una iGPU dentro de la CPU, las salidas de vídeo de la placa (HDMI, DisplayPort, etc.) están conectadas a esa lógica; en una GPU dedicada, los puertos del backplate se conectan a los controladores internos de la gráfica. No hay un RAMDAC “suelto” visible como antes, sino bloques funcionales que se encargan de las distintas salidas.

Esto explica también que, cuando entras en herramientas de diagnóstico de Windows como dxdiag o “Información del sistema”, aún pueda aparecer la mención a “DAC tipo: Integrado”. Es un campo heredado de épocas donde se detallaba qué tipo de RAMDAC tenía la tarjeta, y que hoy muchas veces se rellena con un valor genérico que no refleja un componente físico separado.

En la práctica, tanto si usas los gráficos integrados de tu procesador como si tienes una RTX 3060 o una Radeon de última generación, el camino de la señal hasta el monitor es casi siempre digital de extremo a extremo. Solo en equipos muy antiguos, o en casos de compatibilidad con proyectores y monitores viejos, entra en juego algún tipo de conversión a analógico.

Esto también ha hecho que los fabricantes centren su marketing en otros aspectos: cantidad y tipo de VRAM, tecnologías como Ray Tracing o DLSS, número de núcleos CUDA o stream processors, refrigeración, etc. El RAMDAC dejó hace mucho de ser un argumento de venta y se convirtió en un detalle técnico más dentro del bloque de salidas.

Relación entre RAMDAC, conectores de vídeo y calidad de imagen

En la era VGA, la calidad de la imagen dependía mucho del RAMDAC y del cable analógico. Un DAC de mala calidad o un cable largo y mal apantallado podían provocar desenfoques, colores lavados o interferencias. Por eso algunos modelos de tarjetas profesionales o de gama alta destacaban por ofrecer RAMDACs de mayor precisión y frecuencia.

Con el salto a DVI, HDMI y DisplayPort, la situación cambió radicalmente. Al ser una señal digital, o llega bien o no llega; no hay un degradado progresivo tan acusado como en analógico. Ahora la calidad percibida depende más de la resolución y la tasa de refresco que soporte tanto la tarjeta como el monitor, además del panel en sí, que de un componente concreto como el RAMDAC.

Las salidas actuales permiten trabajar con resoluciones muy altas (4K, 5K e incluso más) y tasas de refresco elevadas (120, 144, 240 Hz o superiores) siempre que el estándar lo soporte y el cable sea adecuado. Estas capacidades vienen definidas por la versión de HDMI o DisplayPort implementada, por la potencia de la GPU y por el ancho de banda disponible, no por un chip RAMDAC como tal.

En equipos antiguos donde todavía se usa VGA, la presencia de un DAC interno de cierta calidad sigue siendo relevante, pero cada vez es menos frecuente encontrar esta salida en tarjetas nuevas. Muchos usuarios recurren directamente a adaptadores activos que convierten de HDMI o DisplayPort a VGA cuando no queda más remedio, asumiendo que la conversión ya no se hace en la gráfica, sino en el propio adaptador.

En resumen, el papel que jugaba el RAMDAC en la calidad de imagen ha sido absorbido por un conjunto de factores distintos: estándar de salida, capacidad del monitor, calidad del panel y, por supuesto, potencia de la GPU para mover los fotogramas a la resolución y frecuencia deseadas.

Mirando el recorrido del RAMDAC, se ve claramente cómo ha pasado de ser una pieza estrella en las primeras tarjetas VGA a convertirse en una función casi invisible integrada en las salidas de vídeo de las GPUs actuales. La transición de monitores CRT analógicos a pantallas digitales, el abandono de los modos basados en paletas de colores y la integración masiva de componentes en un solo chip han dejado al RAMDAC tradicional prácticamente sin papel en las tarjetas modernas. Aun así, su huella sigue presente en interfaces heredadas, en campos de diagnóstico del sistema y en el propio diseño histórico de las tarjetas gráficas, recordándonos que buena parte de la evolución del vídeo en PC se construyó sobre la base de esos pequeños convertidores digital‑analógico con memoria integrada.