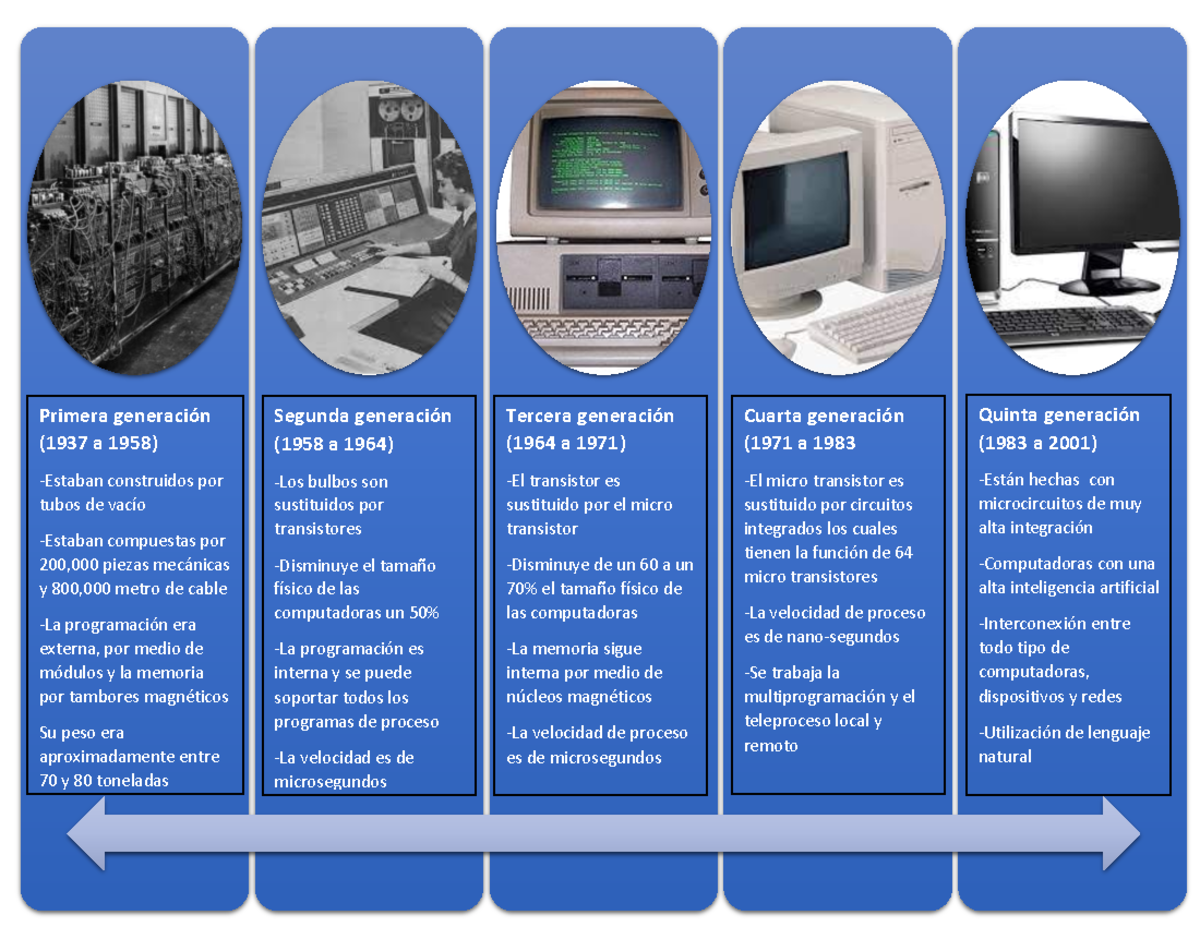

- Las generaciones de computadoras se definen por hitos tecnológicos en hardware, software y formas de uso.

- De la primera a la cuarta generación se pasa de válvulas a transistores, circuitos integrados y microprocesadores, reduciendo tamaño y coste.

- La quinta generación está marcada por Internet, la conectividad global y el auge de la inteligencia artificial.

- La posible sexta generación gira en torno a computación cuántica, hardware neuromórfico y sistemas más inteligentes y eficientes.

Si te has preguntado alguna vez cuáles son las generaciones de computadoras y cómo han ido cambiando desde los primeros monstruos llenos de cables hasta los portátiles ultrafinos y los móviles actuales, estás en el lugar adecuado. La historia de la informática no es solo una lista de fechas y máquinas raras: es la historia de cómo hemos pasado de ocupar salas enteras con equipos carísimos a llevar un ordenador completo en el bolsillo.

A lo largo de este recorrido verás que cada generación se define por un salto tecnológico clave: válvulas, transistores, circuitos integrados, microprocesadores, redes e inteligencia artificial. También veremos una posible sexta generación, asociada a la computación cuántica y a sistemas todavía más inteligentes. Vamos a desgranarlo con calma, pero con un lenguaje cercano, para que entiendas no solo el qué, sino el por qué de cada etapa.

¿Qué son las generaciones de computadoras?

Cuando hablamos de generaciones de computadoras nos referimos a grandes etapas en la evolución tecnológica del hardware y el software, no a modelos concretos o marcas específicas. Cada una de estas fases viene marcada por un cambio profundo en los componentes electrónicos, la forma de programar, el tamaño, el consumo y los usos posibles.

De forma general, se suele hablar de cinco generaciones claramente definidas y una sexta en desarrollo o en fase especulativa. Desde los primeros aparatos de cálculo electrónicos de los años cuarenta hasta los dispositivos actuales basados en redes, movilidad e inteligencia artificial, las diferencias son abismales.

En cada generación se pueden identificar una serie de rasgos clave: tipo de componente principal (tubos de vacío, transistores, chips, microprocesadores), lenguaje de programación utilizado (desde lenguaje máquina a lenguajes de alto nivel), medios de entrada y salida, potencia de cálculo, tamaño físico y contexto de uso (militar, científico, empresarial, doméstico, móvil…).

Con esta idea en mente, vamos a recorrer una por una las generaciones de computadoras, desde la primera hasta la quinta, y después veremos qué se está gestando para esa famosa sexta generación de la que tanto se habla.

Primera generación de computadoras: tubos al vacío

La primera generación de computadoras abarca, aproximadamente, desde principios de la década de 1940 hasta mediados de los años cincuenta. Es la época en la que nacen las primeras máquinas de cálculo automáticas de propósito general, impulsadas en gran medida por necesidades militares y científicas durante y después de la Segunda Guerra Mundial.

Estas computadoras se construían con tubos o válvulas de vacío como componentes electrónicos básicos. Eran elementos grandes, frágiles, que consumían mucha energía y generaban un calor brutal. Cada equipo podía incorporar decenas de miles de válvulas, de modo que fallos, recalentamientos y averías eran el pan de cada día.

Las máquinas de esta generación se programaban directamente en lenguaje máquina, mediante códigos binarios y secuencias numéricas. Para introducir las instrucciones y los datos se utilizaban tarjetas perforadas o cintas de papel perforadas, y la salida solía imprimirse en papel. Cada programa se orientaba a una única tarea; si se quería resolver otro problema, había que reconfigurar físicamente la máquina o cambiar todo el lote de tarjetas.

El tamaño también impresiona: estos sistemas podían ocupar salas enteras, pesar decenas de toneladas y consumir varios kilovatios. A pesar de ello, su potencia de cálculo, comparada con la de un dispositivo actual, era ridícula. Aun así, supusieron un salto gigantesco respecto a las calculadoras electromecánicas previas.

Entre los modelos más emblemáticos encontramos el ENIAC (Electronic Numerical Integrator and Computer), presentado en 1946 en la Universidad de Pensilvania. Utilizaba unas 18 000 válvulas de vacío, pesaba más de 27 toneladas, ocupaba un sótano completo y, aun así, podía realizar unas 5 000 sumas por segundo, una cifra impresionante para su época.

El ENIAC se diseñó originalmente para cálculos balísticos y aplicaciones militares, aunque también se utilizó para proyectos científicos, como el diseño de la bomba de hidrógeno. No era un producto comercial al uso, sino un enorme prototipo experimental. Sin embargo, allanó el camino para máquinas posteriores.

Sucesores directos fueron el EDVAC (Electronic Discrete Variable Automatic Computer), que incorporó el concepto de programa almacenado en memoria (una idea clave que define a las computadoras modernas), y otras máquinas como la Z3 alemana, a menudo citada como el primer ordenador programable digital. En el ámbito comercial, la UNIVAC I se considera la primera computadora producida en serie para clientes, y en 1952 incluso se utilizó para pronosticar el resultado de las elecciones presidenciales en Estados Unidos.

En resumen, la primera generación se caracteriza por equipos enormes, carísimos, poco fiables, programados en lenguaje máquina y basados en válvulas de vacío. Eran, sobre todo, máquinas de investigación y cálculo de alto nivel, muy lejos de la informática cotidiana que conocemos hoy.

Segunda generación de computadoras: transistores

La segunda generación se sitúa, grosso modo, entre mediados de los años cincuenta y principios de los sesenta. El cambio que lo revoluciona todo es la sustitución de las válvulas de vacío por transistores, un invento de los laboratorios Bell de finales de los cuarenta que tarda unos años en implantarse masivamente.

El transistor es mucho más pequeño, más fiable y consume bastante menos energía que una válvula de vacío, además de generar menos calor y fallar con menor frecuencia. Gracias a ello, las computadoras de segunda generación se vuelven más compactas, rápidas y eficientes, aunque todavía siguen siendo equipos grandes si los comparamos con los estándares actuales.

En esta etapa empiezan a aparecer lenguajes de programación simbólicos y de alto nivel. Se pasa del lenguaje máquina puro al lenguaje ensamblador, donde las instrucciones se representan con mnemónicos más fáciles de recordar, y se desarrollan lenguajes complejos pensados para tareas concretas. Nacen así lenguajes clásicos como FORTRAN (en IBM, hacia 1957) y COBOL, orientados respectivamente a la computación científica y al procesamiento de datos de negocio.

La forma de interactuar con los equipos todavía se basa en buena medida en tarjetas perforadas y listados impresos, pero las capacidades aumentan: se amplía la memoria, se introducen dispositivos como impresoras y se avanza en tecnologías de almacenamiento, como los tambores y núcleos magnéticos, precursores de los discos magnéticos.

Durante estos años se sientan también las bases de conceptos esenciales como la microprogramación, que simplifica el diseño interno de las CPU permitiendo describir su funcionamiento mediante pequeños programas a bajo nivel. Además, algunos modelos de IBM se convierten en auténticos éxitos comerciales, como la IBM 1401, de la que se venden miles de unidades, marcando la entrada de la informática en muchas empresas.

Otro hito de este periodo es que ciertas máquinas se diseñan ya pensando en aplicaciones comerciales, científicas y administrativas más generalizadas, no solo en proyectos militares o de investigación puntera. Aun así, siguen siendo equipos caros, reservados a grandes organizaciones, universidades, gobiernos y grandes empresas.

Las características más destacadas de la segunda generación pueden resumirse en: uso de transistores, menor tamaño y consumo, más velocidad y fiabilidad, primeros lenguajes de alto nivel y evolución del almacenamiento magnético. Todo ello prepara el terreno para el siguiente salto, que será todavía más radical.

Tercera generación de computadoras: circuitos integrados

La tercera generación se extiende, aproximadamente, desde principios-mediados de los años sesenta hasta comienzos de los setenta. La gran novedad es la aparición del circuito integrado (chip), que permite colocar muchos transistores y otros componentes en una pequeña pastilla de silicio.

Con los circuitos integrados, la miniaturización da un salto enorme: se aumenta la capacidad de procesamiento y se reducen los costes y el tamaño de los equipos. Además, la fiabilidad mejora todavía más y el consumo eléctrico baja en comparación con las generaciones anteriores, haciendo posible que más empresas e instituciones se planteen adquirir sistemas informáticos.

En este periodo también se consolidan las memorias de núcleo magnético o de ferrita, formadas por pequeños anillos ferromagnéticos capaces de almacenar bits mediante su magnetización. Estas memorias son más rápidas y fiables que los tambores magnéticos, y constituyen la base de la memoria principal en muchos sistemas de la época.

La forma de interactuar con el ordenador cambia de manera notable: se empiezan a utilizar teclados y monitores, y se popularizan los sistemas operativos, que permiten ejecutar varios programas y gestionar recursos como la memoria y el tiempo de CPU. Aparecen conceptos como la multiprogramación, el teleproceso y las terminales remotas.

Durante esta generación se desarrollan nuevos lenguajes de programación, como BASIC, que facilita la enseñanza de la informática y la programación a estudiantes y usuarios sin una formación técnica profunda. La informática comienza a extenderse a ámbitos como la educación, la medicina o la industria, no solo a la ciencia y la defensa.

Algunos modelos destacados de esta época son las PDP-8 y PDP-11 de DEC, consideradas minicomputadoras relativamente asequibles, con buena capacidad de procesamiento y muy utilizadas en laboratorios, universidades y entornos industriales. Gracias a la potencia de estas máquinas, se lograron hazañas como el cálculo del número pi con cientos de miles de decimales, algo impensable unas décadas antes.

Entre las características típicas de la tercera generación podemos mencionar: menor consumo energético, mayor fiabilidad y flexibilidad, aparición del teleproceso, multiprogramación, renovación de periféricos y proliferación de las minicomputadoras. La experiencia de uso se hace más rica y amigable, allanando el terreno para el salto a la informática personal.

Cuarta generación de computadoras: microprocesadores y PC

La cuarta generación arranca a principios de los años setenta y, en cierto modo, sus efectos se prolongan hasta hoy. El gran protagonista es el microprocesador, un circuito integrado que contiene la unidad central de proceso y otros componentes esenciales del ordenador en un solo chip.

El primer microprocesador comercialmente relevante fue el Intel 4004, lanzado en 1971. Aunque se diseñó inicialmente para una calculadora, su arquitectura de 4 bits, con unos 2 300 transistores y capacidad para realizar decenas de miles de operaciones por segundo, supuso una revolución. Demostraba que lo que antes ocupaba una placa llena de chips o incluso un armario entero podía concentrarse en un componente diminuto.

Gracias a los microprocesadores y a las tecnologías de integración a gran escala (LSI) y a muy gran escala (VLSI), se puede reducir drásticamente el tamaño de las computadoras, abaratar costes y aumentar su potencia. Esto es lo que hace posible el nacimiento del concepto de ordenador personal o PC: máquinas pensadas para ser usadas por individuos, no solo por grandes organizaciones.

En esta etapa aparecen las primeras PC comerciales de marcas como IBM y Apple. El Apple II, el IBM PC, los primeros Macintosh y otros sistemas compatibles se popularizan en oficinas, hogares y centros educativos. La informática deja de ser patrimonio exclusivo de expertos y comienza a formar parte de la vida cotidiana.

Al mismo tiempo, evoluciona el ecosistema de software: se consolidan sistemas operativos más amigables, interfaces gráficas de usuario (GUI), el ratón, y se extiende el uso de discos duros, memoria RAM y ROM modernas. Surgen lenguajes de programación como C y, algo más adelante, Java y Python, que amplían las posibilidades de desarrollo de aplicaciones.

Durante esta generación también se desarrollan y popularizan medios de almacenamiento y conexión como el CD-ROM, el USB, las redes locales y, más adelante, Internet, la wifi y el Bluetooth. La capacidad de conectar ordenadores entre sí dará lugar a un cambio de paradigma: ya no importa solo la potencia de una máquina aislada, sino la red a la que se conecta.

La cuarta generación, en resumen, se identifica con el auge del microprocesador, la miniaturización masiva, el nacimiento de los ordenadores personales y las primeras grandes redes de comunicación. Es aquí donde la informática empieza realmente a parecerse a lo que hoy entendemos por “usar un ordenador” en el día a día.

Quinta generación de computadoras: redes, movilidad e inteligencia artificial

La quinta generación se asocia con el periodo que va desde los años ochenta hasta la actualidad, aunque las fronteras no son nítidas. Lo que caracteriza esta etapa es la combinación de varios fenómenos: consolidación de las redes informáticas, explosión de Internet, popularización de los dispositivos portátiles y avance de la inteligencia artificial.

En los años ochenta y noventa se consolidan proyectos clave como la World Wide Web, que abre Internet al público general y al comercio. A partir de ahí se desencadena una transformación global: correo electrónico, páginas web, servicios en la nube, redes sociales, plataformas de vídeo, comercio electrónico… el ordenador se convierte en una herramienta imprescindible de trabajo, ocio y comunicación para millones de personas.

Paralelamente, la miniaturización continúa, y aparecen las computadoras portátiles o laptops, que permiten llevar el ordenador de un lado a otro con relativa comodidad. Más adelante, con la convergencia entre telefonía y computación, surgen los smartphones, auténticos ordenadores de bolsillo con capacidad de conexión permanente a Internet.

Esta etapa también está marcada por el foco en la conectividad global: redes cableadas, wifi, datos móviles, Bluetooth y un sinfín de protocolos interconectan ordenadores, servidores, sensores y dispositivos de todo tipo. Es el caldo de cultivo del llamado Internet de las cosas (IoT), donde no solo las personas, sino también los objetos y máquinas se comunican entre sí.

En el terreno del software y el hardware de alto rendimiento, la quinta generación se asocia con el avance de la inteligencia artificial y el aprendizaje automático. Se desarrollan sistemas capaces de reconocer voz, interpretar imágenes, traducir textos, recomendar contenidos o tomar decisiones complejas a partir de grandes volúmenes de datos. Tecnologías como las GPUs de alto rendimiento, las arquitecturas paralelas y los grandes centros de datos juegan un papel central, junto con el papel de algunas compañías de CPUs chinas.

Históricamente, ya en los años ochenta, Japón impulsó un ambicioso proyecto conocido como FGCS (Fifth Generation Computer Systems), con la idea de crear computadoras basadas intensivamente en inteligencia artificial, tanto en hardware como en software. Aunque el proyecto no dio los frutos esperados, sirvió para impulsar la investigación en esta área.

Otro hito representativo de este periodo fue la aparición de máquinas como NeXTstation en los años noventa, concebidas para lo que se denominó “computación interpersonal”, y posteriormente el lanzamiento del primer iMac de Apple, que unificaba en un solo cuerpo el hardware y el monitor, con un diseño llamativo y orientado al gran público. Estos equipos ayudaron a popularizar la idea de ordenadores con diseño cuidado, interfaces más visuales y conexión directa a la red.

La quinta generación, por tanto, se define por ordenadores mucho más pequeños, rápidos y potentes, ubicuos y conectados, con un papel central de las redes y la inteligencia artificial. Vivimos inmersos en ella: trabajamos, estudiamos, jugamos y nos comunicamos a través de dispositivos que son el resultado de todos estos avances acumulados.

Sexta generación de computadoras: computación cuántica y futuro

Cuando se habla de sexta generación de computadoras entramos en un terreno que, en buena parte, todavía es especulativo y está en fase de investigación. No existe un consenso absoluto sobre cuándo empieza ni qué tecnologías concretas la definen, pero sí hay varias líneas claras de desarrollo.

Una de las más prometedoras es la computación cuántica, que se basa en principios de la mecánica cuántica para procesar información mediante cúbits en lugar de bits clásicos. En teoría, esto permitiría resolver en tiempos razonables ciertos problemas que para un ordenador convencional serían prácticamente imposibles, como algunos algoritmos de criptografía, optimización o simulación de sistemas complejos.

Otra línea clave es el avance en arquitecturas inspiradas en el cerebro, como los circuitos de aprendizaje neuronal y los chips neuromórficos. El objetivo es construir sistemas capaces de aprender y adaptarse con una eficiencia energética muy superior, acercando el funcionamiento del hardware al de las redes neuronales biológicas.

La tecnología de superconductores también juega un papel interesante, ya que permite reducir el consumo eléctrico y el calor generado por los componentes, lo que facilitaría la construcción de equipos mucho más potentes sin los límites térmicos actuales. Combinada con nuevas formas de memoria y comunicación óptica, podría abrir la puerta a centros de datos radicalmente más eficientes.

Junto con esto, disciplinas como la nanotecnología, la robótica avanzada, la realidad virtual y aumentada y el Internet de las cosas a gran escala seguramente dejarán su huella en la próxima generación de sistemas de cómputo. Es probable que veamos ordenadores cada vez más integrados en el entorno, en forma de dispositivos casi invisibles pero presentes en todas partes.

No hay todavía un “modelo icónico” de sexta generación como en el caso del ENIAC, el IBM PC o el iPhone. Lo que sí podemos anticipar es que las futuras computadoras serán más inteligentes, más eficientes y estarán aún más fusionadas con nuestra vida diaria. La frontera entre ordenador, red, objeto físico y usuario será cada vez más difusa.

Mirando en perspectiva todas estas etapas, se ve claramente un patrón: equipos cada vez más pequeños, baratos, potentes, conectados y sencillos de usar. Desde los gigantes de válvulas hasta los proyectos cuánticos y de inteligencia artificial, cada generación ha ido ampliando tanto las capacidades técnicas como el impacto de la informática en la sociedad. Viendo el ritmo actual de innovación, da la sensación de que lo más revolucionario todavía está por llegar.